Matriz (matemática)

Na matemática, uma matriz (plural: matrizes) é um arranjo retangular de números ou outros objetos matemáticos com elementos ou entradas organizados em linhas e colunas, satisfazendo geralmente certas propriedades de adição e multiplicação.

Por exemplo, denota uma matriz com duas linhas e três colunas. Isto é frequentemente referido como uma "matriz dois por três", uma matriz 2 × 3, ou uma matriz de dimensão 2 × 3.

Na álgebra linear, as matrizes são usadas como aplicações lineares. Na geometria, as matrizes são usadas para transformações geométricas (por exemplo, rotações) e mudanças de coordenadas. Na análise numérica, muitos problemas computacionais são resolvidos reduzindo-os a uma computação matricial, e isto envolve frequentemente computar com matrizes de enormes dimensões. As matrizes são usadas na maioria das áreas da matemática e em campos científicos, quer diretamente, quer através do seu uso na geometria e na análise numérica.

As matrizes quadradas, matrizes com o mesmo número de linhas e colunas, desempenham um papel fundamental na teoria das matrizes. O determinante de uma matriz quadrada é um número associado à matriz, o qual é fundamental para o estudo de uma matriz quadrada; por exemplo, uma matriz quadrada é inversível se e somente se tiver um determinante não-nulo e os autovalores de uma matriz quadrada são as raízes do seu polinômio característico, .

A teoria das matrizes é o ramo da matemática que se foca no estudo das matrizes. Foi inicialmente um sub-ramo da álgebra linear, mas rapidamente cresceu para incluir assuntos relacionados com a teoria dos grafos, álgebra, combinatória e estatística.

História

As matrizes têm uma longa história de aplicação na resolução de equações lineares, mas eram conhecidas como arranjos (arrays) até ao século XIX. O texto chinês Os Nove Capítulos da Arte Matemática, escrito entre os séculos X e II a.C., é o primeiro exemplo do uso de métodos de arranjo para resolver equações simultâneas,[1] incluindo o conceito de determinantes. Em 1545, o matemático italiano Gerolamo Cardano introduziu o método na Europa quando publicou a Ars Magna.[2] O matemático japonês Seki Kowa usou os mesmos métodos de arranjo para resolver equações simultâneas em 1683.[3] O matemático holandês Jan de Witt representou transformações usando arranjos no seu livro de 1659, Elementos das Curvas (1659).[4] Entre 1700 e 1710, Gottfried Wilhelm Leibniz publicitou o uso de arranjos para registar informações ou soluções e experimentou mais de 50 sistemas diferentes de arranjos.[2] Cramer apresentou a sua regra em 1750.[5][6]

Este uso do termo matriz na matemática (uma palavra inglesa para "útero" no século XIX, do latim, bem como uma palavra de jargão na impressão, na biologia e na geologia[7]) foi cunhado por James Joseph Sylvester em 1850,[8] que compreendeu uma matriz como um objeto que dá origem a vários determinantes hoje chamados de menores, ou seja, determinantes de matrizes menores que derivam da original através da remoção de colunas e linhas. Num artigo de 1851, Sylvester explica:[9]

Defini em artigos anteriores uma "Matriz" como um arranjo retangular de termos, a partir do qual diferentes sistemas de determinantes podem ser engendrados a partir do útero de um pai comum.

Arthur Cayley publicou um tratado sobre transformações geométricas utilizando matrizes que não eram versões rodadas dos coeficientes a serem investigados, como havia sido feito anteriormente. Em vez disso, ele definiu operações como adição, subtração, multiplicação e divisão como transformações dessas matrizes e mostrou que as propriedades associativa e distributiva se mantinham. Cayley investigou e demonstrou a propriedade não comutativa da multiplicação de matrizes, bem como a propriedade comutativa da adição de matrizes.[2] A teoria inicial das matrizes havia limitado o uso de arranjos quase exclusivamente aos determinantes e as operações matriciais abstratas de Cayley foram revolucionárias. Ele foi fundamental na proposta de um conceito de matriz independente de sistemas de equações. Em 1858, Cayley publicou o seu A memoir on the theory of matrices[10][11] no qual propôs e demonstrou o teorema de Cayley-Hamilton.[2]

O matemático inglês Cuthbert Edmund Cullis foi o primeiro a usar a notação moderna de colchetes para matrizes em 1913 e demonstrou simultaneamente o primeiro uso significativo da notação A = [ai,j] para representar uma matriz, onde ai,j refere-se à i-ésima linha e à j-ésima coluna.[2]

O estudo moderno dos determinantes surgiu de várias fontes.[12] Problemas teórico-numéricos levaram Gauss a relacionar coeficientes de formas quadráticas, ou seja, expressões como x2 + xy − 2y2, e aplicações lineares em três dimensões a matrizes. Eisenstein desenvolveu ainda mais essas noções, incluindo a observação de que, na linguagem moderna, os produtos de matrizes são não comutativos. Cauchy foi o primeiro a provar afirmações gerais sobre determinantes, usando como definição do determinante de uma matriz A = [ai,j] o seguinte: substituir as potências ajk por aj,k no polinômio onde denota o produto dos termos indicados. Ele também mostrou, em 1829, que os autovalores de matrizes simétricas são reais.[13] Jacobi estudou "determinantes funcionais" — mais tarde chamados de determinantes jacobianos por Sylvester — que podem ser usados para descrever transformações geométricas num nível local (ou infinitesimal), ver acima. A obra Vorlesungen über die Theorie der Determinanten de Kronecker[14] e Zur Determinantentheorie de Weierstrass,[15] ambas publicadas em 1903, trataram os determinantes pela primeira vez de forma axiomática, em oposição a abordagens anteriores mais concretas, como a mencionada fórmula de Cauchy. Nessa altura, os determinantes estavam firmemente estabelecidos.[16][12]

Muitos teoremas foram primeiro estabelecidos apenas para matrizes pequenas; por exemplo, o teorema de Cayley-Hamilton foi provado para matrizes 2 × 2 por Cayley na memória supramencionada, e por Hamilton para matrizes 4 × 4. Frobenius, a trabalhar em formas bilineares, generalizou o teorema para todas as dimensões (1898). Também no final do século XIX, a eliminação de Gauss-Jordan (generalizando um caso especial agora conhecido como eliminação de Gauss) foi estabelecida por Wilhelm Jordan. No início do século XX, as matrizes alcançaram um papel central na álgebra linear,[17] parcialmente devido ao seu uso na classificação dos sistemas de números hipercomplexos do século anterior.[18]

A criação da mecânica matricial por Heisenberg, Born e Jordan levou ao estudo de matrizes com infinitas linhas e colunas.[19] Mais tarde, von Neumann realizou a formulação matemática da mecânica quântica, desenvolvendo ainda mais as noções da análise funcional, tais como operadores lineares em espaços de Hilbert, os quais, grosso modo, correspondem ao espaço euclidiano, mas com uma infinidade de direções independentes.[20]

Outros usos históricos da palavra "matriz" na matemática

A palavra foi usada de formas invulgares por pelo menos dois autores de importância histórica.

Bertrand Russell e Alfred North Whitehead no seu Principia Mathematica (1910–1913) usam a palavra "matriz" no contexto do seu axioma da redutibilidade. Eles propuseram este axioma como um meio para reduzir qualquer função a uma de tipo inferior, sucessivamente, de modo a que no "fundo" (ordem 0) a função seja idêntica à sua extensão:[21]

Demos o nome de matriz a qualquer função, de quantas variáveis forem, que não envolva quaisquer variáveis aparentes. Então, qualquer função possível além de uma matriz deriva de uma matriz usando a generalização, isto é, ao considerar a proposição de que a função em questão é verdadeira com todos os valores possíveis ou com algum valor de um dos argumentos, permanecendo o outro argumento ou argumentos indeterminados.

Por exemplo, uma função Φ(x, y) de duas variáveis x e y pode ser reduzida a uma coleção de funções de uma única variável, tal como y, "considerando" a função para todos os valores possíveis de "indivíduos" ai substituídos no lugar de uma variável x. E então a coleção resultante de funções da única variável y, ou seja, ∀ai: Φ(ai, y), pode ser reduzida a uma "matriz" de valores "considerando" a função para todos os valores possíveis de "indivíduos" bj substituídos no lugar da variável y:

Alfred Tarski na sua Introdução à Lógica de 1941 usou a palavra "matriz" como sinônimo da noção de tabela de verdade, tal como usada na lógica matemática.[22]

Definição

Uma matriz é um arranjo retangular de números (ou outros objetos matemáticos), chamados de "entradas" da matriz. As matrizes estão sujeitas a operações padrão, tais como a adição e a multiplicação.[23] Mais comumente, uma matriz sobre um corpo é um arranjo retangular de elementos de .[24][25] Uma matriz real e uma matriz complexa são matrizes cujas entradas são, respetivamente, números reais ou números complexos. Tipos mais gerais de entradas são discutidos abaixo. Por exemplo, esta é uma matriz real:

Os números (ou outros objetos) na matriz são chamados de suas entradas ou elementos. As linhas horizontais e verticais de entradas numa matriz são chamadas respetivamente de linhas e colunas.[26]

Tamanho

O tamanho de uma matriz é definido pelo número de linhas e colunas que ela contém. Não há limite para o número de linhas e colunas que uma matriz (no sentido usual) pode ter, desde que sejam inteiros positivos. Uma matriz com m linhas e n colunas é chamada de matriz m × n,[26] ou matriz m-por-n,[27] onde m e n são chamadas as suas dimensões.[28] Por exemplo, a matriz acima é uma matriz 3 × 2.

Matrizes com uma única linha são chamadas de matrizes linha ou vetores linha, e aquelas com uma única coluna são chamadas de matrizes coluna ou vetores coluna. Uma matriz com o mesmo número de linhas e colunas é chamada de matriz quadrada.[29] Uma matriz com um número infinito de linhas ou colunas (ou ambos) é chamada de matriz infinita. Em alguns contextos, tais como programas de computação algébrica, é útil considerar uma matriz sem linhas ou sem colunas, chamada de matriz vazia.[30]

| Nome | Tamanho | Exemplo | Descrição |

|---|---|---|---|

| Matriz linha | Uma matriz com uma linha e mais de uma coluna, por vezes usada para representar um vetor | ||

| Matriz coluna | Uma matriz com uma coluna e mais de uma linha, por vezes usada para representar um vetor | ||

| Matriz quadrada | Uma matriz com o mesmo número de linhas e colunas, por vezes usada para representar uma transformação linear de um espaço vetorial nele próprio, tal como uma reflexão, rotação ou cisalhamento. |

Matrizes com uma única linha são chamadas de matrizes linha ou vetores linha, e aquelas com uma única coluna são chamadas de matrizes coluna ou vetores coluna. Uma matriz com o mesmo número de linhas e colunas é chamada de matriz quadrada.[29] Uma matriz com um número infinito de linhas ou colunas (ou ambos) é chamada de matriz infinita. Em alguns contextos, tais como programas de computação algébrica, é útil considerar uma matriz sem linhas ou sem colunas, chamada de matriz vazia.[30]

| Nome | Tamanho | Exemplo | Descrição |

|---|---|---|---|

| Matriz linha | Uma matriz com uma linha e mais de uma coluna, por vezes usada para representar um vetor | ||

| Matriz coluna | Uma matriz com uma coluna e mais de uma linha, por vezes usada para representar um vetor | ||

| Matriz quadrada | Uma matriz com o mesmo número de linhas e colunas, por vezes usada para representar uma transformação linear de um espaço vetorial nele próprio, tal como uma reflexão, rotação ou cisalhamento. |

Notação

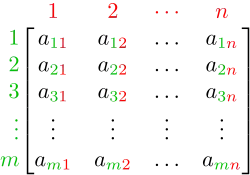

Os detalhes da notação simbólica de matrizes variam amplamente, com algumas tendências predominantes. As matrizes são comumente escritas entre colchetes ou parênteses,[31] de modo que uma matriz m × n é representada como Isto pode ser abreviado escrevendo apenas um único termo genérico, possivelmente com índices, como em ou no caso em que .

As matrizes são geralmente simbolizadas usando letras maiúsculas (como nos exemplos acima),[32] enquanto as letras minúsculas correspondentes, com dois índices subscritos (por exemplo, , ou ), representam as entradas.[33] Além de usar letras maiúsculas para simbolizar matrizes, muitos autores usam um estilo tipográfico especial, comumente redondo em negrito (não itálico), para distinguir ainda mais as matrizes de outros objetos matemáticos. Uma notação alternativa envolve o uso de um sublinhado duplo com o nome da variável, com ou sem estilo negrito, como em .[34]

A entrada na i-ésima linha e j-ésima coluna de uma matriz A é por vezes referida como a entrada ou da matriz, e comumente denotada por ou .[35] Notações alternativas para essa entrada são e . Por exemplo, a entrada da seguinte matriz é 5 (também denotada por , , ou ):

Por vezes, as entradas de uma matriz podem ser definidas por uma fórmula, tal como . Por exemplo, cada uma das entradas da seguinte matriz é determinada pela fórmula . Neste caso, a própria matriz é por vezes definida por essa fórmula, entre colchetes ou parênteses duplos. Por exemplo, a matriz acima é definida como ou . Se o tamanho da matriz for m × n, a fórmula supramencionada é válida para qualquer e qualquer . Isto pode ser especificado separadamente ou indicado usando m × n como um subscrito. Por exemplo, a matriz acima é de 3 × 4, e pode ser definida como ou .

Algumas linguagens de programação utilizam arranjos (arrays) duplamente subscritos (ou arranjos de arranjos) para representar uma matriz de m × n. Algumas linguagens de programação começam a numeração dos índices do arranjo no zero, caso em que as entradas de uma matriz m × n são indexadas por e .[36] Este artigo segue a convenção mais comum na escrita matemática, onde a enumeração começa a partir do 1.

O conjunto de todas as matrizes reais m × n é frequentemente denotado por , ou . O conjunto de todas as matrizes m × n sobre um outro corpo, ou sobre um anel R, é similarmente denotado por , ou . Se m = n, como no caso de matrizes quadradas, não se repete a dimensão: , ou .[37] Frequentemente, , ou , é usado no lugar de .[38]

Operações básicas

Diversas operações básicas podem ser aplicadas a matrizes. Algumas, como a transposição e a submatriz, não dependem da natureza das entradas. Outras, como a adição de matrizes, a multiplicação por escalar, a multiplicação de matrizes e as operações elementares em linha, envolvem operações nas entradas da matriz e, portanto, exigem que as entradas sejam números ou pertençam a um corpo ou a um anel.[39]

Nesta seção, supõe-se que as entradas da matriz pertençam a um anel fixo, que tipicamente é um corpo de números.

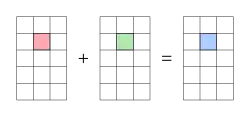

Adição

A adição e subtração de matrizes exigem matrizes de um tamanho consistente, e são calculadas entrada por entrada. A soma e a diferença de duas matrizes m × n são:[40]

Por exemplo,

Propriedades familiares dos números estendem-se a estas operações com matrizes: por exemplo, a adição é comutativa, ou seja, a soma matricial não depende da ordem das parcelas: .[41]

Multiplicação por escalar

O produto de um número (também chamado de escalar neste contexto) e uma matriz é computado multiplicando cada entrada de por :[42]

Esta operação é chamada de multiplicação por escalar, mas o seu resultado não é denominado "produto escalar" para evitar confusão, uma vez que "produto escalar" é frequentemente usado como sinônimo de "produto interno".[43] Por exemplo:

A subtração de matrizes é consistente com a composição da adição de matrizes com a multiplicação por escalar por :[44]

Matriz transposta

A transposta de uma matriz m × n é a matriz n × m (também denotada por ou ) formada pela transformação de linhas em colunas e vice-versa: Por exemplo:

A transposta é compatível com a adição e a multiplicação por escalar, como expresso por e . Finalmente, .[45]

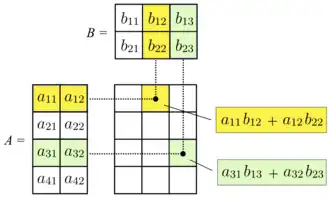

Multiplicação de matrizes

A multiplicação de duas matrizes corresponde à composição das transformações lineares representadas por cada matriz. Ela é definida se e somente se o número de colunas da matriz da esquerda for igual ao número de linhas da matriz da direita. Se é uma matriz m × n e é uma matriz n × p, então o seu produto matricial é a matriz m × p cujas entradas são dadas pelo produto escalar da linha correspondente de e da coluna correspondente de :[46] onde e .[47] Por exemplo, a entrada sublinhada 2340 no produto é calculada como :

A multiplicação de matrizes satisfaz as regras (associatividade), e , bem como (distributividade à esquerda e à direita), sempre que o tamanho das matrizes for tal que os vários produtos estejam definidos.[48] O produto pode estar definido sem que esteja definido, nomeadamente se e forem matrizes m × n e n × k, respetivamente, e . Mesmo que ambos os produtos estejam definidos, eles não precisam necessariamente de ser iguais, isto é:[49]

Noutras palavras, a multiplicação de matrizes não é comutativa, num contraste acentuado com os números (racionais, reais ou complexos), cujo produto é independente da ordem dos fatores.[46] Um exemplo de duas matrizes que não comutam entre si é: enquanto que

Além da multiplicação ordinária de matrizes recém-descrita, existem também outras operações em matrizes usadas com menos frequência que podem ser consideradas formas de multiplicação, tais como o produto de Hadamard e o produto de Kronecker.[50] Elas surgem na resolução de equações matriciais, como a equação de Sylvester.[51]

Operações elementares em linha

Existem três tipos de operações elementares em linha:[52][53]

- adição de linhas, ou seja, somar uma linha a outra;

- multiplicação de linha, ou seja, multiplicar todas as entradas de uma linha por uma constante não-nula;

- troca de linhas, ou seja, permutar duas linhas de uma matriz.

Estas operações são usadas de várias formas, incluindo a resolução de sistemas de equações lineares e a determinação de matrizes inversas usando a eliminação de Gauss e a eliminação de Gauss-Jordan, respetivamente.[54]

Submatriz

Uma submatriz de uma matriz é uma matriz obtida através da exclusão de qualquer coleção de linhas ou colunas, ou ambas.[55][56][57] Por exemplo, a partir da seguinte matriz 3 × 4, podemos construir uma submatriz 2 × 3 removendo a linha 3 e a coluna 2:

Os menores e cofatores de uma matriz são encontrados computando o determinante de certas submatrizes.[57][58]

Uma submatriz principal é uma submatriz quadrada obtida através da remoção de certas linhas e colunas. A definição varia de autor para autor. Segundo alguns autores, uma submatriz principal é uma submatriz na qual o conjunto de índices de linhas que restam é o mesmo que o conjunto de índices de colunas que restam.[59][60] Outros autores definem uma submatriz principal como aquela em que as primeiras linhas e colunas, para algum número , são as que restam;[61] este tipo de submatriz também tem sido chamado de submatriz principal líder.[62]

Equações lineares

As matrizes podem ser usadas para escrever e trabalhar de forma compacta com múltiplas equações lineares, isto é, sistemas de equações lineares. Por exemplo, se A é uma matriz m × n, x designa um vetor coluna (isto é, uma matriz n × 1) de n variáveis x1, x2, ..., xn, e b é um vetor coluna m × 1, então a equação matricial é equivalente ao sistema de equações lineares[63]

Usando matrizes, isto pode ser resolvido de forma mais compacta do que seria possível escrevendo todas as equações separadamente. Se n = m e as equações forem independentes, então isto pode ser feito escrevendo[64] onde A−1 é a matriz inversa de A. Se A não tiver inversa, as soluções — se existirem — podem ser encontradas usando a sua inversa generalizada.[65]

Transformações lineares

As matrizes e a multiplicação de matrizes revelam as suas características essenciais quando relacionadas com transformações lineares, também conhecidas como aplicações lineares. Uma matriz real m × n A dá origem a uma transformação linear mapeando cada vetor x em para o produto (matricial) Ax, que é um vetor em . Inversamente, cada transformação linear surge de uma única matriz m × n A: explicitamente, a entrada (i, j) de A é a i-ésima coordenada de f (ej}), onde ej = (0, ..., 0, 1, 0, ..., 0) é o vetor unitário com 1 na j-ésima posição e 0 nas restantes. Diz-se que a matriz A representa a aplicação linear f, e A é chamada a matriz de transformação de f.[66]

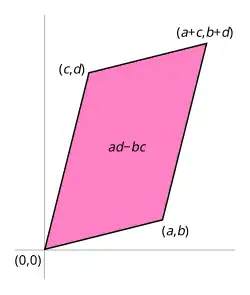

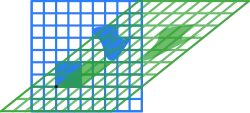

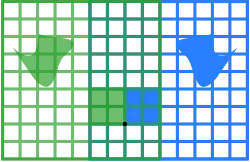

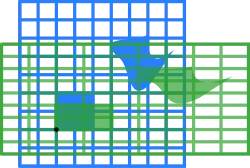

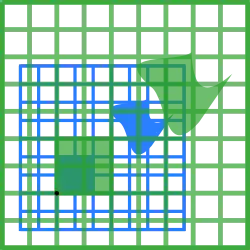

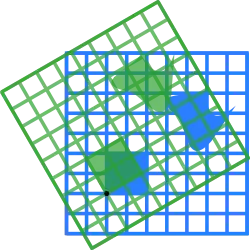

Por exemplo, a matriz 2 × 2 pode ser vista como a transformação do quadrado unitário num paralelogramo com vértices em (0, 0), (a, b), (a + c, b + d) e (c, d). O paralelogramo retratado à direita é obtido multiplicando A sucessivamente por cada um dos vetores coluna , , e . Estes vetores definem os vértices do quadrado unitário.[67] A tabela seguinte mostra várias matrizes reais 2 × 2 com as aplicações lineares associadas de . O original a azul é mapeado para a grade e formas a verde. A origem (0, 0) está marcada com um ponto preto.

| Cisalhamento horizontal[68] com m = 1.25. |

Reflexão[69] através do eixo vertical | Compressão[70] com r = 3/2 |

Escala[71] por um fator de 3/2 |

Rotação[70] por /6 = 30° |

|

|

|

|

|

Sob a correspondência biunívoca entre matrizes e aplicações lineares, a multiplicação de matrizes corresponde à composição de aplicações:[72] se uma matriz k × m B representa outra aplicação linear , então a composição g ∘ f é representada por BA uma vez que[73]

A última igualdade resulta da associatividade da multiplicação de matrizes supramencionada.

O posto (ou característica) de uma matriz A é o número máximo de vetores linha linearmente independentes da matriz, que é o mesmo que o número máximo de vetores coluna linearmente independentes.[74] Equivalentemente, é a dimensão da imagem da aplicação linear representada por A.[75] O teorema do núcleo e da imagem afirma que a dimensão do núcleo de uma matriz mais o seu posto é igual ao número de colunas da matriz.[76]

Matriz quadrada

Uma matriz quadrada é uma matriz com o mesmo número de linhas e colunas. Uma matriz n × n é conhecida como uma matriz quadrada de ordem n. Quaisquer duas matrizes quadradas da mesma ordem podem ser somadas e multiplicadas. As entradas formam a diagonal principal de uma matriz quadrada. Elas situam-se na linha imaginária que vai do canto superior esquerdo ao canto inferior direito da matriz.[77]

Matrizes quadradas de uma dada dimensão formam um anel não comutativo, que é um dos exemplos mais comuns de um anel não comutativo.[78]

Tipos principais

Nome Exemplo com n = 3 Matriz diagonal Matriz triangular inferior Matriz triangular superior

Matriz diagonal e triangular

Se todas as entradas de A abaixo da diagonal principal forem zero, A é chamada de matriz triangular superior. Similarmente, se todas as entradas de A acima da diagonal principal forem zero, A é chamada de matriz triangular inferior.[79] Se todas as entradas fora da diagonal principal forem zero, A é chamada de matriz diagonal.[80]

Matriz identidade

A matriz identidade In de tamanho n é a matriz n × n na qual todos os elementos na diagonal principal são iguais a 1 e todos os outros elementos são iguais a 0,[81] por exemplo, É uma matriz quadrada de ordem n, e também um tipo especial de matriz diagonal. Chama-se matriz identidade porque a multiplicação por ela deixa uma matriz inalterada:[81] para qualquer matriz m × n A.

Um múltiplo escalar de uma matriz identidade é chamado de matriz escalar.[82]

Matriz simétrica ou antissimétrica

Uma matriz quadrada A que é igual à sua transposta, isto é, A = AT, é uma matriz simétrica. Se, em vez disso, A for igual ao negativo da sua transposta, isto é, A = −AT, então A é uma matriz antissimétrica. Nas matrizes complexas, a simetria é frequentemente substituída pelo conceito de matrizes hermitianas, que satisfazem A∗ = A, onde a estrela ou asterisco denota a transposta conjugada da matriz, isto é, a transposta do complexo conjugado de A.[83]

Pelo teorema espetral, matrizes reais simétricas e matrizes complexas hermitianas têm uma base própria (eigenbasis); isto é, todo vetor é exprimível como uma combinação linear de autovetores. Em ambos os casos, todos os autovalores são reais.[84] Este teorema pode ser generalizado para situações de dimensão infinita relacionadas a matrizes com infinitas linhas e colunas.[85]

Matriz inversível e a sua inversa

Uma matriz quadrada A é chamada de inversível ou não singular se existir uma matriz B tal que[86][87] onde In é a matriz identidade de n × n com 1 em cada entrada na diagonal principal e 0 nas restantes. Se B existir, é única e é chamada de matriz inversa de A, denotada por A−1.[88]

Existem muitos algoritmos para testar se uma matriz quadrada é inversível e, se o for, computar a sua inversa. Um dos mais antigos, que ainda é de uso comum, é a eliminação de Gauss.[89]

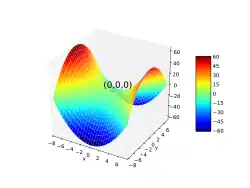

Matriz definida

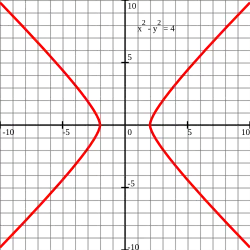

| Matriz definida positiva | Matriz indefinida |

|---|---|

Pontos tais que (Elipse) |

Pontos tais que (Hipérbole) |

Uma matriz real simétrica A é chamada definida positiva se a forma quadrática associada tiver um valor positivo para todo vetor não nulo x em . Se f(x) produzir apenas valores negativos, então A é definida negativa; se f produzir valores tanto negativos quanto positivos, então A é indefinida.[90] Se a forma quadrática f produzir apenas valores não-negativos (positivos ou zero), a matriz simétrica é chamada de semidefinida positiva (ou se apenas valores não-positivos, então semidefinida negativa); consequentemente a matriz é indefinida exatamente quando não é nem semidefinida positiva nem semidefinida negativa.[91]

Uma matriz simétrica é definida positiva se, e somente se, todos os seus autovalores forem positivos, ou seja, a matriz é semidefinida positiva e é inversível.[92] A tabela à direita mostra duas possibilidades para matrizes 2 × 2. Os autovalores de uma matriz diagonal são simplesmente as entradas ao longo da diagonal,[93] e por isso, nestes exemplos, os autovalores podem ser lidos diretamente a partir das próprias matrizes. A primeira matriz possui dois autovalores que são ambos positivos, enquanto que a segunda possui um que é positivo e outro que é negativo.

Permitir como entrada dois vetores diferentes produz, em vez disso, a forma bilinear associada a A:[94]

No caso de matrizes complexas, aplicam-se a mesma terminologia e resultados, com matriz simétrica, forma quadrática, forma bilinear e transposta xT substituídos, respetivamente, por matriz hermitiana, forma hermitiana, forma sesquilinear e transposta conjugada xH.[95]

Matriz ortogonal

Uma matriz ortogonal é uma matriz quadrada com entradas reais cujas colunas e linhas são vetores unitários ortogonais (isto é, vetores ortonormais).[96] Equivalentemente, uma matriz A é ortogonal se a sua transposta for igual à sua inversa: o que implica onde In é a matriz identidade de tamanho n.[97]

Uma matriz ortogonal A é necessariamente inversível (com a inversa A−1 = AT), unitária (A−1 = A*), e normal (A*A = AA*). O determinante de qualquer matriz ortogonal é +1 ou −1. Uma matriz ortogonal especial é uma matriz ortogonal com determinante +1. Como uma transformação linear, toda a matriz ortogonal com determinante +1 é uma rotação pura sem reflexão, ou seja, a transformação preserva a orientação da estrutura transformada, enquanto que toda a matriz ortogonal com determinante −1 inverte a orientação, isto é, é uma composição de uma reflexão pura e uma rotação (possivelmente nula). As matrizes identidade têm determinante 1 e são rotações puras por um ângulo zero.[98]

O análogo complexo de uma matriz ortogonal é uma matriz unitária.[99]

Principais operações

Traço

O traço, tr(A) de uma matriz quadrada A é a soma das suas entradas diagonais. Embora a multiplicação de matrizes não seja comutativa como mencionado acima, o traço do produto de duas matrizes é independente da ordem dos fatores:[100] Isto é imediato a partir da definição da multiplicação de matrizes:[101] Resulta que o traço do produto de mais de duas matrizes é independente das permutações cíclicas das matrizes; no entanto, isso não se aplica, em geral, a permutações arbitrárias. Por exemplo, tr(ABC) ≠ tr(BAC), em geral.[102] Além disso, o traço de uma matriz é igual ao da sua transposta,[103] isto é,

Determinante

O determinante de uma matriz quadrada A (denotado por det(A) ou ) é um número que codifica certas propriedades da matriz. Uma matriz é inversível se e somente se o seu determinante for não nulo.[104] O seu valor absoluto é igual à área (em ) ou volume (em ) da imagem do quadrado (ou cubo) unitário, enquanto o seu sinal corresponde à orientação da aplicação linear correspondente: o determinante é positivo se, e somente se, a orientação for preservada.[105]

O determinante de matrizes 2 × 2 é dado por[106] O determinante de matrizes 3 × 3 envolve seis termos (regra de Sarrus). A mais extensa fórmula de Leibniz generaliza estas duas fórmulas para todas as dimensões.[107]

O determinante de um produto de matrizes quadradas é igual ao produto dos seus determinantes: ou usando uma notação alternativa:[108] Adicionar um múltiplo de qualquer linha a outra linha, ou um múltiplo de qualquer coluna a outra coluna, não altera o determinante. Intercambiar duas linhas ou duas colunas afeta o determinante multiplicando-o por −1.[109] Usando estas operações, qualquer matriz pode ser transformada numa matriz triangular inferior (ou superior), e para tais matrizes, o determinante é igual ao produto das entradas na diagonal principal; isto fornece um método para calcular o determinante de qualquer matriz. Finalmente, a expansão de Laplace expressa o determinante em termos de menores, ou seja, determinantes de matrizes menores.[110] Esta expansão pode ser usada para uma definição recursiva de determinantes (tomando como caso base o determinante de uma matriz 1 × 1, que é a sua única entrada, ou mesmo o determinante de uma matriz 0 × 0, que é 1), que pode ser visto como equivalente à fórmula de Leibniz. Os determinantes podem ser usados para resolver sistemas lineares usando a Regra de Cramer, onde a divisão dos determinantes de duas matrizes quadradas relacionadas é igual ao valor de cada uma das variáveis do sistema.[111]

Autovalores e autovetores

Um número e um vetor não nulo que satisfaçam são chamados de autovalor e autovetor de , respetivamente.[112][113] O número é um autovalor de uma matriz se, e somente se, a matriz não for inversível, o que é logicamente equivalente a[114] O polinômio numa indeterminada dado pela avaliação do determinante é chamado de polinômio característico de . É um polinômio mônico de grau . Portanto, a equação polinomial possui no máximo soluções diferentes, isto é, autovalores da matriz.[115] Eles podem ser complexos mesmo que as entradas de sejam reais.[116] De acordo com o teorema de Cayley-Hamilton, , ou seja, o resultado da substituição da própria matriz no seu polinômio característico produz a matriz nula.[117]

Aspectos computacionais

Os cálculos matriciais podem frequentemente ser realizados com diferentes técnicas. Muitos problemas podem ser resolvidos tanto por algoritmos diretos quanto por abordagens iterativas. Por exemplo, os autovetores de uma matriz quadrada podem ser obtidos encontrando uma sequência de vetores xn que convergem para um autovetor quando n tende ao infinito.[118]

Para escolher o algoritmo mais apropriado para cada problema específico, é importante determinar tanto a eficácia quanto a precisão de todos os algoritmos disponíveis. O domínio que estuda estes assuntos é chamado de álgebra linear numérica.[119] Tal como noutras situações numéricas, dois aspetos principais são a complexidade dos algoritmos e a sua estabilidade numérica.

Determinar a complexidade de um algoritmo significa encontrar limites superiores ou estimativas de quantas operações elementares, tais como adições e multiplicações de escalares, são necessárias para executar algum algoritmo, por exemplo, a multiplicação de matrizes. Calcular o produto matricial de duas matrizes n-por-n usando a definição dada acima requer n3 multiplicações, uma vez que para qualquer uma das n2 entradas do produto, são necessárias n multiplicações. O algoritmo de Strassen supera este algoritmo "ingênuo"; ele precisa apenas de n2.807 multiplicações.[120] Algoritmos de multiplicação de matrizes teoricamente mais rápidos, mas impraticáveis, foram desenvolvidos,[121] assim como acelerações para este problema usando algoritmos paralelos ou sistemas de computação distribuída como o MapReduce.[122]

Em muitas situações práticas, são conhecidas informações adicionais sobre as matrizes envolvidas. Um caso importante diz respeito às matrizes esparsas, ou seja, matrizes cujas entradas são maioritariamente zero. Existem algoritmos especificamente adaptados para, por exemplo, resolver sistemas lineares Ax = b para matrizes esparsas A, tal como o método dos gradientes conjugados.[123]

Um algoritmo é, grosso modo, numericamente estável se pequenos desvios nos valores de entrada não levarem a grandes desvios no resultado. Por exemplo, pode-se calcular a inversa de uma matriz computando a sua matriz adjunta: No entanto, isto pode levar a erros de arredondamento significativos se o determinante da matriz for muito pequeno. A norma de uma matriz pode ser usada para capturar o condicionamento de problemas algébricos lineares, tais como a computação da inversa de uma matriz.[124]

Decomposição

Existem vários métodos para transformar matrizes numa forma mais facilmente acessível. Eles são geralmente referidos como técnicas de decomposição de matrizes ou fatoração de matrizes. Estas técnicas são de interesse porque podem facilitar as computações.

A decomposição LU fatora matrizes como um produto de matrizes triangulares inferior (L) e superior (U).[125] Uma vez que esta decomposição é calculada, sistemas lineares podem ser resolvidos de forma mais eficiente por uma técnica simples chamada substituição progressiva e regressiva. Da mesma forma, as inversas de matrizes triangulares são algoritmicamente mais fáceis de calcular. A eliminação de Gauss é um algoritmo semelhante; ela transforma qualquer matriz na forma escalonada.[126] Ambos os métodos procedem multiplicando a matriz por matrizes elementares adequadas, que correspondem a permutar linhas ou colunas e adicionar múltiplos de uma linha a outra linha. A decomposição em valores singulares (SVD) expressa qualquer matriz A como um produto UDV∗, onde U e V são matrizes unitárias e D é uma matriz diagonal.[127]

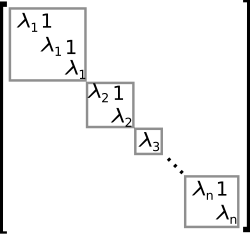

A decomposição em autovalores ou diagonalização expressa A como um produto VDV−1, onde D é uma matriz diagonal e V é uma matriz inversível adequada.[128] Se A puder ser escrita nesta forma, é chamada de matriz diagonalizável. Mais genericamente, e aplicável a todas as matrizes, a decomposição de Jordan transforma uma matriz na forma normal de Jordan, ou seja, matrizes cujas únicas entradas não-nulas são os autovalores λ1 a λn de A, colocados na diagonal principal, e possivelmente entradas iguais a um diretamente acima da diagonal principal, como mostrado à direita.[129] Dada a decomposição em autovalores, a n-ésima potência de A (isto é, a multiplicação de matrizes iterada n vezes) pode ser calculada através de e a potência de uma matriz diagonal pode ser calculada tomando as potências correspondentes das entradas diagonais, o que é muito mais fácil do que fazer a exponenciação para A em vez disso. Isto pode ser usado para computar a exponencial de matrizes eA, uma necessidade que surge frequentemente na resolução de equações diferenciais lineares, logaritmos de matrizes e raízes quadradas de matrizes.[130] Para evitar situações numericamente mal condicionadas, outros algoritmos, tais como a decomposição de Schur, podem ser empregues.[131]

Aspetos algébricos abstratos e generalizações

As matrizes podem ser generalizadas de diferentes formas. A álgebra abstrata utiliza matrizes com entradas em corpos mais gerais ou mesmo em anéis, enquanto a álgebra linear codifica as propriedades das matrizes na noção de aplicações lineares. É possível considerar matrizes com infinitas colunas e linhas. Outra extensão são os tensores, que podem ser vistos como arranjos de números de dimensões superiores, em contraste com os vetores, que podem frequentemente ser compreendidos como sequências de números, ao passo que as matrizes são arranjos de números retangulares ou bidimensionais.[132] As matrizes, sujeitas a certos requisitos, tendem a formar grupos conhecidos como grupos de matrizes.[133] Da mesma forma, sob certas condições, as matrizes formam anéis conhecidos como anéis de matrizes.[134] Embora o produto de matrizes não seja em geral comutativo, certas matrizes formam corpos por vezes chamados de corpos de matrizes.[135] (No entanto, o termo "corpo de matrizes" é ambíguo, referindo-se também a certas formas de campos físicos que mapeiam continuamente os pontos de algum espaço para matrizes.[136]) Em geral, matrizes sobre qualquer anel e a sua multiplicação podem ser representadas como as setas e a composição de setas numa categoria, a categoria das matrizes sobre esse anel. Os objetos desta categoria são números naturais, representando as dimensões das matrizes.[137]

Matrizes com entradas num corpo ou anel

Este artigo foca-se em matrizes cujas entradas são números reais ou complexos. No entanto, as matrizes podem ser consideradas com tipos de entradas muito mais gerais do que números reais ou complexos. Como um primeiro passo de generalização, qualquer corpo, isto é, um conjunto onde as operações de adição, subtração, multiplicação e divisão estão definidas e bem-comportadas, pode ser usado em vez de ou , por exemplo, números racionais ou corpos finitos. Por exemplo, a teoria de códigos faz uso de matrizes sobre corpos finitos.[138] Onde quer que os autovalores sejam considerados, como estes são raízes de um polinômio, eles podem existir apenas num corpo maior do que o das entradas da matriz. Por exemplo, podem ser complexos no caso de uma matriz com entradas reais. A possibilidade de reinterpretar as entradas de uma matriz como elementos de um corpo maior (por exemplo, para ver uma matriz real como uma matriz complexa cujas entradas calham de ser todas reais) permite então considerar que cada matriz quadrada possui um conjunto completo de autovalores.[139] Em alternativa, pode-se considerar desde o início apenas matrizes com entradas num corpo algebricamente fechado, como .[140]

Matrizes cujas entradas são polinômios,[141] e, mais genericamente, matrizes com entradas num anel R são amplamente utilizadas na matemática.[23] Os anéis são uma noção mais geral do que os corpos na medida em que uma operação de divisão não precisa de existir. As mesmíssimas operações de adição e multiplicação de matrizes estendem-se também a este contexto. O conjunto M(n, R) (também denotado Mn(R)[37]) de todas as matrizes quadradas n × n sobre R é um anel chamado de anel de matrizes, isomorfo ao anel de endomorfismos do R-módulo à esquerda .[142] Se o anel R for comutativo, ou seja, a sua multiplicação é comutativa, então o anel M(n, R) é também uma álgebra associativa sobre R. O determinante de matrizes quadradas sobre um anel comutativo R ainda pode ser definido usando a fórmula de Leibniz; uma tal matriz é inversível se e somente se o seu determinante for inversível em R, generalizando a situação sobre um corpo F, onde todo elemento não nulo é inversível.[143] Matrizes sobre superanéis são chamadas de supermatrizes.[144]

As matrizes nem sempre têm todas as suas entradas no mesmo anel — ou sequer num anel qualquer. Um caso especial mas comum são as matrizes em blocos, que podem ser consideradas como matrizes cujas próprias entradas são matrizes. As entradas não precisam de ser matrizes quadradas e, portanto, não precisam de ser membros de nenhum anel; mas para as multiplicar, os seus tamanhos devem satisfazer certas condições: cada par de submatrizes que são multiplicadas na formação do produto global deve ter tamanhos compatíveis.[145]

Relação com as aplicações lineares

Aplicações lineares são equivalentes a matrizes m × n, conforme descrito acima. Mais geralmente, qualquer aplicação linear f : V → W entre espaços vetoriais de dimensão finita pode ser descrita por uma matriz A = (aij), após a escolha de bases v1, ..., vn de V, e w1, ..., wm de W (de forma que n é a dimensão de V e m é a dimensão de W), de tal modo que Por outras palavras, a coluna j de A expressa a imagem de vj em termos dos vetores da base wi de W; assim, esta relação determina univocamente as entradas da matriz A. A matriz depende da escolha das bases: diferentes escolhas de bases dão origem a matrizes diferentes, mas equivalentes.[146] Muitas das noções concretas acima podem ser reinterpretadas a esta luz, por exemplo, a matriz transposta AT descreve a transposta de uma aplicação linear dada por A, no que diz respeito às bases duais.[147]

Estas propriedades podem ser reformuladas mais naturalmente: a categoria das matrizes com entradas num corpo com a multiplicação como composição é equivalente à categoria de espaços vetoriais de dimensão finita e aplicações lineares sobre este corpo.[148]

Mais geralmente, o conjunto de matrizes m × n pode ser usado para representar as aplicações R-lineares entre os módulos livres e para um anel arbitrário R com unidade. Quando n = m, a composição destas aplicações é possível, e isto dá origem ao anel de matrizes de matrizes n × n representando o anel de endomorfismos de .[149]

Grupos de matrizes

Um grupo é uma estrutura matemática que consiste num conjunto de objetos juntamente com uma operação binária, isto é, uma operação que combina quaisquer dois objetos para formar um terceiro, sujeita a certos requisitos.[150] Um grupo no qual os objetos são matrizes inversíveis e a operação de grupo é a multiplicação de matrizes é chamado de grupo de matrizes de grau .[151] Todo este grupo de matrizes é um subgrupo de (ou seja, um grupo menor contido dentro de) o grupo de todas as matrizes inversíveis, o grupo linear geral de grau .[152]

Qualquer propriedade de matrizes quadradas que seja preservada sob produtos e inversas de matrizes pode ser usada para definir um grupo de matrizes. Por exemplo, o conjunto de todas as matrizes cujo determinante é 1 forma um grupo chamado o grupo linear especial de grau .[153] O conjunto de matrizes ortogonais, determinado pela condição forma o grupo ortogonal.[154] Toda matriz ortogonal tem um determinante 1 ou −1. As matrizes ortogonais com determinante 1 formam um grupo chamado o grupo ortogonal especial.[155]

Todo grupo finito é isomorfo a um grupo de matrizes, como se pode ver considerando a representação regular do grupo simétrico.[156] Grupos gerais podem ser estudados usando grupos de matrizes, que são comparativamente bem compreendidos, usando a teoria de representação.[157]

Matrizes infinitas

Também é possível considerar matrizes com infinitas linhas e colunas.[158] As operações básicas introduzidas acima são definidas da mesma forma neste caso. A multiplicação de matrizes, no entanto, e todas as operações que dela derivam são significativas apenas quando restritas a certas matrizes, uma vez que a soma que figura na definição acima do produto matricial conterá uma infinidade de parcelas.[159] Uma forma fácil de contornar esta questão é restringir a matrizes finitárias cujas linhas (ou colunas) contêm todas apenas um número finito de termos não-nulos.[160] Tal como no caso finito (ver acima), onde as matrizes descrevem aplicações lineares, as matrizes infinitas podem ser usadas para descrever operadores em espaços de Hilbert, onde surgem questões de convergência e continuidade. Contudo, o ponto de vista explícito das matrizes tende a ofuscar a questão,[161] sendo antes utilizadas as ferramentas abstratas e mais poderosas da análise funcional, relacionando matrizes com aplicações lineares (como no caso finito acima), mas impondo restrições adicionais de convergência e continuidade.

Matriz vazia

Uma matriz vazia é uma matriz na qual o número de linhas ou colunas (ou ambos) é zero.[162][30] As matrizes vazias podem ser um caso base útil para certas construções recursivas,[163] e podem ajudar a lidar com aplicações envolvendo o espaço vetorial trivial.[164] Por exemplo, se A for uma matriz 3 × 0 e B for uma matriz 0 × 3, então AB é a matriz nula 3 × 3 correspondente à aplicação nula de um espaço de 3 dimensões V nele próprio, enquanto que BA é uma matriz 0 × 0. Não existe uma notação comum para matrizes vazias, mas a maioria dos sistemas de computação algébrica permite criá-las e computar com elas.[165] O determinante da matriz 0 × 0 é convencionalmente definido como 1, consistente com o produto vazio que ocorre na fórmula de Leibniz para o determinante.[166] Este valor também é necessário para manter a consistência com o caso 2 × 2 da identidade de Desnanot-Jacobi que relaciona determinantes aos determinantes de matrizes menores.[167]

Matrizes com entradas num semianel

Um semianel é semelhante a um anel, mas os elementos não precisam de ter inversos aditivos, portanto, não se pode fazer subtrações livremente nele. A definição de adição e multiplicação de matrizes com entradas num anel aplica-se a matrizes com entradas num semianel sem modificações. Matrizes de tamanho fixo com entradas num semianel formam um monoide comutativo sob a adição.[168] Matrizes quadradas de tamanho fixo com entradas num semianel formam um semianel sob a adição e a multiplicação.[168]

O determinante de uma matriz quadrada n × n com entradas num semianel comutativo não pode ser definido em geral porque a definição envolveria inversos aditivos dos elementos do semianel. O que desempenha esse papel, em vez disso, é o par de determinantes positivo e negativo

onde as somas são tomadas sobre permutações pares e permutações ímpares, respetivamente.[169][170]

Matrizes com entradas numa categoria

Matrizes e a sua multiplicação podem ser definidas com entradas que são objetos de uma categoria equipada com um "produto tensorial" semelhante à multiplicação num anel, tendo coprodutos semelhantes à adição num anel, sendo que o primeiro é distributivo sobre o segundo.[171] No entanto, a multiplicação assim definida pode ser associativa apenas num sentido mais fraco que o habitual. Estas fazem parte de uma estrutura maior chamada bicategoria de matrizes. Segue-se a descrição completa do resumo acima para os leitores interessados.

Seja uma categoria monoidal que satisfaz as duas seguintes condições:

- Todos os (pequenos) coprodutos existem; em particular, seja um objeto inicial.

- O funtor é distributivo sobre os coprodutos; isto é, para todo objeto e uma família de objetos em , os -morfismos canónicos são isomorfismos. Em particular, os morfismos canónicos e são isomorfismos.

Então, a bicategoria de -matrizes é definida da seguinte forma:[171]

- Os objetos são os conjuntos.

- Um 1-morfismo é uma aplicação ; isto é simplesmente uma matriz sobre .

- A composição dos 1-morfismos e , que pode ser entendida como a multiplicação de matrizes, é

- O 1-morfismo identidade em é

- Um 2-morfismo entre os 1-morfismos é uma família de -morfismos . A definição de composição vertical e horizontal dos 2-morfismos é natural: a composição vertical é a composição componente a componente de -morfismos; a composição horizontal é a que deriva da funtorialidade de e da propriedade universal dos coprodutos.

Em geral, a bicategoria de matrizes não precisa de ser uma 2-categoria estrita. Por exemplo, a composição de 1-morfismos pode não ser associativa no sentido estrito usual, mas apenas até um isomorfismo coerente.

Aplicações

Existem inúmeras aplicações de matrizes, tanto na matemática quanto noutras ciências. Algumas delas apenas tiram proveito da representação compacta de um conjunto de números numa matriz. Por exemplo, a mineração de texto e a compilação automatizada de tesauros fazem uso de matrizes documento-termo (document-term matrices), tais como a tf-idf, para rastrear frequências de certas palavras em vários documentos.[172]

Números complexos podem ser representados por matrizes reais particulares 2 × 2 através de sob as quais a adição e a multiplicação de números complexos e matrizes correspondem entre si. Por exemplo, matrizes de rotação 2 × 2 representam a multiplicação por um número complexo de valor absoluto 1, como acima. Uma interpretação semelhante é possível para os quatérnios[173] e as álgebras de Clifford em geral.[174]

Na teoria dos jogos e na economia, a matriz de ganhos (payoff matrix) codifica o ganho para dois jogadores, dependendo de qual de um determinado conjunto (finito) de estratégias os jogadores escolhem.[175] O resultado esperado do jogo, quando ambos os jogadores jogam estratégias mistas, é obtido multiplicando esta matriz em ambos os lados por vetores que representam as estratégias.[176] O teorema minimax, central na teoria dos jogos, está intimamente relacionado com a teoria da dualidade dos programas lineares, que são frequentemente formulados em termos de produtos matriz-vetor.[177]

Técnicas antigas de criptografia, como a Cifra de Hill, também usavam matrizes. No entanto, devido à natureza linear das matrizes, estes códigos são comparativamente fáceis de quebrar.[178] A computação gráfica usa matrizes para representar objetos; para calcular transformações de objetos usando matrizes de rotação afins para realizar tarefas como projetar um objeto tridimensional numa tela bidimensional, correspondendo a uma observação teórica de câmara; e para aplicar convoluções de imagem como nitidez, desfoque, deteção de bordas e muito mais.[179] Matrizes sobre um anel de polinômios são importantes no estudo da teoria de controle.[180]

A química faz uso de matrizes de várias formas, particularmente desde a utilização da teoria quântica para discutir a ligação molecular e a espectroscopia. Exemplos são a matriz de sobreposição e a matriz de Fock usadas na resolução das equações de Roothaan para obter os orbitais moleculares do método de Hartree-Fock.[181]

Teoria dos grafos

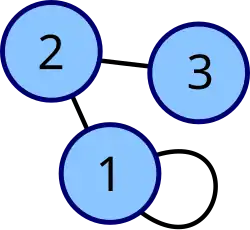

A matriz de adjacência de um grafo finito é uma noção básica da teoria dos grafos.[182] Regista quais os vértices do grafo que estão conectados por uma aresta. Matrizes contendo apenas dois valores diferentes (1 e 0 significando, por exemplo, "sim" e "não", respetivamente) são chamadas de matrizes lógicas. A matriz de distâncias (ou de custos) contém informações sobre as distâncias das arestas.[183] Estes conceitos podem ser aplicados a websites conectados por hiperligações,[184] ou a cidades conectadas por estradas, etc., caso em que (a não ser que a rede de conexão seja extremamente densa) as matrizes tendem a ser esparsas, isto é, contêm poucas entradas não nulas. Portanto, algoritmos de matrizes especificamente adaptados podem ser usados na teoria de redes.[185]

Análise e geometria

A matriz hessiana de uma função diferenciável consiste nas segundas derivadas de ƒ em relação às várias direções de coordenadas, ou seja,[186]

Ela codifica informações sobre o comportamento local de crescimento da função: dado um ponto crítico x = (x1, ..., xn), ou seja, um ponto onde as primeiras derivadas parciais de f se anulam, a função possui um mínimo local se a matriz hessiana for definida positiva. A programação quadrática pode ser usada para encontrar mínimos ou máximos globais de funções quadráticas intimamente relacionadas com as associadas a matrizes (ver acima).[187]

Outra matriz frequentemente usada em situações geométricas é a matriz jacobiana de uma aplicação diferenciável . Se f1, ..., fm denotarem as componentes de f, então a matriz jacobiana é definida como[188] Se n > m, e se o posto da matriz jacobiana atingir o seu valor máximo m, f é localmente inversível nesse ponto, pelo teorema da função implícita.[189]

As equações diferenciais parciais podem ser classificadas considerando a matriz de coeficientes dos operadores diferenciais de maior ordem da equação. Para equações diferenciais parciais elípticas esta matriz é definida positiva, o que tem uma influência decisiva no conjunto de possíveis soluções da equação em questão.[190]

O método dos elementos finitos é um método numérico importante para resolver equações diferenciais parciais, amplamente aplicado na simulação de sistemas físicos complexos. Tenta aproximar a solução de alguma equação por funções lineares por partes, onde as partes são escolhidas em relação a uma grade suficientemente fina, o que, por sua vez, pode ser reescrito como uma equação matricial.[191]

Teoria das probabilidades e estatística

Matrizes estocásticas são matrizes quadradas cujas linhas são vetores de probabilidade, ou seja, cujas entradas são não-negativas e somam um. As matrizes estocásticas são usadas para definir cadeias de Markov com um número finito de estados.[192] Uma linha da matriz estocástica fornece a distribuição de probabilidade para a próxima posição de alguma partícula atualmente no estado que corresponde à linha. As propriedades da cadeia de Markov — como os estados absorventes, isto é, estados que qualquer partícula alcança eventualmente — podem ser lidas nos autovetores das matrizes de transição.[193]

A estatística também faz uso de matrizes de muitas formas diferentes.[194] A estatística descritiva preocupa-se em descrever conjuntos de dados, que podem ser frequentemente representados como matrizes de dados, as quais podem então ser sujeitas a técnicas de redução de dimensionalidade. A matriz de covariância codifica a variância mútua de várias variáveis aleatórias.[195] Outra técnica que usa matrizes são os mínimos quadrados lineares, um método que aproxima um conjunto finito de pares (x1, y1), (x2, y2), ..., (xN, yN), por uma função linear que pode ser formulada em termos de matrizes, relacionada com a decomposição em valores singulares das matrizes.[196]

Matrizes aleatórias são matrizes cujas entradas são números aleatórios, sujeitas a distribuições de probabilidade adequadas, tal como a distribuição normal matricial. Além da teoria das probabilidades, elas são aplicadas em domínios que vão desde a teoria dos números até à física.[197][198]

Mecânica quântica e física de partículas

O primeiro modelo da mecânica quântica (Heisenberg, 1925) usou matrizes de dimensão infinita para definir os operadores que assumiram o papel de variáveis como a posição, o momento e a energia da física clássica.[199] (Isto é por vezes referido como mecânica matricial.[200]) As matrizes, tanto de dimensão finita como infinita, têm sido empregues para muitos propósitos na mecânica quântica. Um exemplo particular é a matriz de densidade, uma ferramenta usada para calcular as probabilidades dos resultados de medições realizadas em sistemas físicos.[201][202]

As transformações lineares e as simetrias associadas desempenham um papel central na física moderna. Por exemplo, as partículas elementares na teoria quântica de campos são classificadas como representações do grupo de Lorentz da relatividade especial e, mais especificamente, pelo seu comportamento sob o grupo de spin. Representações concretas envolvendo as matrizes de Pauli e matrizes gama mais gerais são uma parte integral da descrição física dos férmions, que se comportam como espinorres.[203] Para os três quarks mais leves, existe uma representação na teoria de grupos envolvendo o grupo unitário especial SU(3); para os seus cálculos, os físicos usam uma representação matricial conveniente conhecida como as matrizes de Gell-Mann, que também são usadas para o grupo de calibre SU(3) que forma a base da descrição moderna das interações nucleares fortes, a cromodinâmica quântica. A matriz de Cabibbo-Kobayashi-Maskawa, por sua vez, expressa o facto de que os estados básicos dos quarks que são importantes para as interações fracas não são os mesmos, mas estão linearmente relacionados com os estados básicos dos quarks que definem partículas com massas específicas e distintas.[204]

Outra matriz serve como ferramenta-chave para descrever os testes de espalhamento que formam a pedra angular da física experimental de partículas: reações de colisão, como as que ocorrem em aceleradores de partículas, onde partículas que não interagem dirigem-se umas contra as outras e colidem numa pequena zona de interação, com um novo conjunto de partículas que não interagem como resultado, podem ser descritas como o produto escalar dos estados das partículas emergentes e uma combinação linear dos estados das partículas incidentes. A combinação linear é dada por uma matriz conhecida como matriz S, que codifica todas as informações sobre as possíveis interações entre as partículas.[205]

Modos normais

Uma aplicação geral das matrizes na física é a descrição de sistemas harmônicos linearmente acoplados. As equações de movimento de tais sistemas podem ser descritas na forma matricial, com uma matriz de massa multiplicando uma velocidade generalizada para dar o termo cinético, e uma matriz de força multiplicando um vetor de deslocamento para caracterizar as interações. A melhor forma de obter soluções é determinar os autovetores do sistema, os seus modos normais, diagonalizando a equação matricial. Técnicas como esta são cruciais quando se trata da dinâmica interna de moléculas: as vibrações internas de sistemas que consistem em átomos componentes mutuamente ligados.[206] Elas também são necessárias para descrever vibrações mecânicas e oscilações em circuitos elétricos.[207]

Óptica geométrica

A óptica geométrica fornece ainda mais aplicações para as matrizes. Nesta teoria aproximativa, a natureza ondulatória da luz é negligenciada. O resultado é um modelo no qual os raios de luz são, de facto, raios geométricos. Se a deflexão dos raios de luz por elementos ópticos for pequena, a ação de uma lente ou elemento refletor num dado raio de luz pode ser expressa como a multiplicação de um vetor de duas componentes com uma matriz de dois por dois chamada de matriz de transferência de raios: as componentes do vetor são a inclinação do raio de luz e a sua distância em relação ao eixo óptico, enquanto a matriz codifica as propriedades do elemento óptico. Existem dois tipos de matrizes, a saber: uma matriz de refração que descreve a refração numa superfície de lente, e uma matriz de translação, que descreve a translação do plano de referência para a próxima superfície de refração, onde outra matriz de refração se aplica. O sistema óptico, consistindo numa combinação de lentes e elementos refletores, é simplesmente descrito pela matriz resultante do produto das matrizes dos componentes.[208]

O cálculo de Jones modela a polarização de uma fonte de luz como um vetor , e os efeitos de filtros ópticos neste vetor de polarização como uma matriz.[70]

Eletrônica

Circuitos eletrônicos que são compostos por componentes lineares (tais como resistores, indutores e capacitores) obedecem às leis de Kirchhoff, o que leva a um sistema de equações lineares que pode ser descrito com uma equação matricial que relaciona as correntes e tensões da fonte com as correntes e tensões resultantes em cada ponto do circuito, e onde as entradas da matriz são determinadas pelo circuito.[209]

Referências

- ↑ Shen, Crossley & Lun 1999 citado por Bretscher 2005, p. 1

- 1 2 3 4 5 Dossey (2002), pp. 564–565.

- ↑ Needham, Joseph; Wang Ling (1959). Science and Civilisation in China. III. Cambridge: Cambridge University Press. p. 117. ISBN 978-0-521-05801-8

- ↑ Dossey (2002), p. 564.

- ↑ Cramer (1750).

- ↑ Kosinski (2001).

- ↑ James Murray; Henry Bradley, eds. (1908). «Matrix». Matrix (em inglês). 6, pt. 2 (M–N). Oxford: Clarendon Press. p. 238

- ↑ O exemplo publicado mais antigo é J. J. Sylvester (1850) "Additions to the articles in the September number of this journal, 'On a new class of theorems,' and on Pascal's theorem," The London, Edinburgh, and Dublin Philosophical Magazine and Journal of Science, 37: 363-370. Da página 369: "Para este propósito, devemos começar, não com um quadrado, mas com um arranjo retangular de termos consistindo, suponhamos, em m linhas e n colunas. Isto não representa em si um determinante, mas é, por assim dizer, uma Matriz a partir da qual podemos formar vários sistemas de determinantes..."

- ↑ Sylvester (1904), p. 247, Artigo 37.

- ↑ Cayley (1858).

- ↑ Dieudonné (1978), Vol. 1, Cap. III, p. 96.

- 1 2 Knobloch (1994).

- ↑ Hawkins (1975).

- ↑ Kronecker 1897

- ↑ Weierstrass 1915, Vol. 3, pp. 271–286

- ↑ & Miller (1930).

- ↑ Bôcher (2004).

- ↑ Hawkins (1972).

- ↑ van der Waerden (2007), pp. 28–40.

- ↑ Peres (1993), pp. 79,106–107.

- ↑ Whitehead, Alfred North; e Russell, Bertrand (1913) Principia Mathematica to *56, Cambridge at the University Press, Cambridge UK (republicado em 1962) cf página 162ff.

- ↑ Tarski (1941), p. 40.

- 1 2 Lang (2002), Capítulo XIII.

- ↑ Fraleigh (1976), p. 209.

- ↑ Nering (1970), p. 37.

- 1 2 Brown (1991), p. 1.

- ↑ Golub & Van Loan (1996), p. 3.

- ↑ Horn & Johnson (1985), p. 5.

- 1 2 Gbur (2011), p. 89.

- 1 2 3 "A matrix having at least one dimension equal to zero is called an empty matrix", Estruturas de Dados do MATLAB Arquivado em 2009-12-28 no Wayback Machine

- ↑ Ramachandra Rao & Bhimasankaram (2000), p. 71.

- ↑ Hamilton (1987), p. 29.

- ↑ Gentle (1998), pp. 52–53.

- ↑ Bauchau & Craig (2009), p. 915.

- ↑ Johnston (2021), p. 21.

- ↑ Oualline (2003), Cap. 5.

- 1 2 Pop & Furdui (2017).

- ↑ Por exemplo, para , veja Mello (2017), p. 48; para , veja Axler (1997), p. 50.

- ↑ Brown (1991), Definição I.2.1 (adição), Definição I.2.4 (multiplicação por escalar) e Definição I.2.33 (transposta).

- ↑ Whitelaw (1991), p. 29.

- ↑ Brown (1991), Teorema I.2.6.

- ↑ Whitelaw (1991), p. 30.

- ↑ Maxwell (1969), p. 46.

- ↑ Lancaster & Tismenetsky (1985), pp. 6–7.

- ↑ Andrilli & Hecker (2022), p. 38, A transposta de uma matriz e as suas propriedades.

- 1 2 Lancaster & Tismenetsky (1985), p. 9.

- ↑ Brown (1991), Definição I.2.20.

- ↑ Brown (1991), Teorema I.2.24.

- ↑ Boas (2005), p. 117.

- ↑ Horn & Johnson (1985), Cap. 4 e 5.

- ↑ Van Loan (2000).

- ↑ Perrone (2024), p. 119–120.

- ↑ Lang (1986), p. 71.

- ↑ Watkins (2002), p. 102.

- ↑ Bronson (1970), p. 16.

- ↑ Kreyszig (1972), p. 220.

- 1 2 Protter & Morrey (1970), p. 869.

- ↑ Kreyszig (1972), pp. 241,244.

- ↑ Schneider & Barker (2012).

- ↑ Perlis (1991).

- ↑ Anton (2010).

- ↑ Horn, Roger A.; Johnson, Charles R. (2012), Matrix Analysis, ISBN 978-0-521-83940-2 2nd ed. , Cambridge University Press, p. 17.

- ↑ Brown (1991), I.2.21 e 22.

- ↑ Gbur (2011), p. 95.

- ↑ Ben-Israel & Greville (2003), pp. 1–2.

- ↑ Grossman (1994), pp. 494–495.

- ↑ Bierens (2004), p. 263.

- ↑ Johnston (2021), p. 56.

- ↑ Pettofrezzo (1978), p. 60.

- 1 2 3 Han, Kim & Noz (1997).

- ↑ Jeffrey (2010), p. 264.

- ↑ Greub (1975, p. 90). Note, no entanto, que Greub segue uma convenção transposta de representar uma transformação multiplicando um vetor linha por uma matriz, em vez de multiplicar uma matriz por um vetor coluna, levando à ordem inversa para as duas matrizes no produto que representa uma composição.

- ↑ Lang (1986), §VI.1.

- ↑ Brown (1991), Definição II.3.3.

- ↑ Greub (1975), Seção III.1.

- ↑ Brown (1991), Teorema II.3.22.

- ↑ Anton (2010), p. 27.

- ↑ Reyes (2025).

- ↑ Anton (2010), p. 68.

- ↑ Gbur (2011), p. 91.

- 1 2 Boas (2005), p. 118.

- ↑ Horn & Johnson (1985), §0.9.1 Matrizes diagonais.

- ↑ Boas (2005), p. 138.

- ↑ Horn & Johnson (1985), Teorema 2.5.6.

- ↑ Conway (1990), pp. 262–263.

- ↑ Brown (1991), Definição I.2.28.

- ↑ Brown (1991), Definição I.5.13.

- ↑ Anton (2010), p. 62.

- ↑ Gbur (2011), pp. 99–100.

- ↑ Horn & Johnson (1985), Capítulo 7.

- ↑ Anton (2010), Teorema 7.3.2.

- ↑ Horn & Johnson (1985), Teorema 7.2.1.

- ↑ Boas (2005), p. 150.

- ↑ Horn & Johnson (1985), p. 169, Exemplo 4.0.6.

- ↑ Lang (1986), Apêndice. Números complexos.

- ↑ Horn & Johnson (1985), pp. 66–67.

- ↑ Gbur (2011), pp. 102–103.

- ↑ Boas (2005), pp. 127,153–154.

- ↑ Boas (2005), p. 141.

- ↑ Horn & Johnson (1985), pp. 40,42.

- ↑ Lang (1986), p. 281.

- ↑ Tang (2006), p. 226.

- ↑ Bernstein (2009), p. 94.

- ↑ Horn & Johnson (1985), §0.5 Nonsingularity.

- ↑ Margalit & Rabinoff (2019).

- ↑ «Matrix | mathematics». Encyclopædia Britannica. Consultado em 19 de agosto de 2020

- ↑ Brown (1991), Definição III.2.1.

- ↑ Brown (1991), Teorema III.2.12.

- ↑ Brown (1991), Corolário III.2.16.

- ↑ Mirsky (1990), Teorema 1.4.1.

- ↑ Brown (1991), Teorema III.3.18.

- ↑ Eigen (auto) significa "próprio" em alemão e em neerlandês. Veja o Wikcionário.

- ↑ Brown (1991), Definição III.4.1.

- ↑ Brown (1991), Definição III.4.9.

- ↑ Brown (1991), Corolário III.4.10.

- ↑ Anton (2010), pp. 317–319.

- ↑ Bernstein (2009), p. 265.

- ↑ Householder (1975), Cap. 7.

- ↑ Bau III & Trefethen (1997).

- ↑ Golub & Van Loan (1996), Algoritmo 1.3.1.

- ↑ Vassilevska Williams et al. (2024).

- ↑ Misra, Bhattacharya & Ghosh (2022).

- ↑ Golub & Van Loan (1996), Capítulos 9 e 10, esp. seção 10.2.

- ↑ Golub & Van Loan (1996), Capítulo 2.3.

- ↑ Press et al. (1992).

- ↑ Stoer & Bulirsch (2002), Seção 4.1.

- ↑ Gbur (2011), pp. 146–153.

- ↑ Horn & Johnson (1985), Teorema 2.5.4.

- ↑ Horn & Johnson (1985), Cap. 3.1, 3.2.

- ↑ Arnold (1992), Seções 14.5, 7, 8.

- ↑ Bronson (1989), Cap. 15.

- ↑ Coburn (1955), Cap. V.

- ↑ Tapp (2016).

- ↑ Lam (1999), pp. 461–470, Capítulo 7, §17 Anéis de Matrizes, §17A Caracterização e Exemplos.

- ↑ Hachenberger & Jungnickel (2020), p. 302, Definição 7.2.1.

- ↑ Ydri (2016).

- ↑ Riehl (2016), pp. 4-6.

- ↑ Roth (2006), p. 27.

- ↑ Chahal (2018), pp. 115–116.

- ↑ Meckes & Meckes (2018), pp. 360–361.

- ↑ Edwards (2004), p. 80.

- ↑ Lang (2002), p. 643, XVII.1.

- ↑ Lang (2002), Proposição XIII.4.16.

- ↑ Reichl (2004), Seção L.2.

- ↑ Jeffrey (2010), pp. 54ff, 3.7 Particionamento de matrizes.

- ↑ Greub (1975), Seção III.3.

- ↑ Greub (1975), Seção III.3.13.

- ↑ Perrone (2024), pp. 99-100.

- ↑ Hungerford (1980), pp. 328–335, VII.1: Matrizes e aplicações.

- ↑ Horn & Johnson (1985), p. 69.

- ↑ Baker (2003), Def. 1.30.

- ↑ Cameron (2014).

- ↑ Baker (2003), Teorema 1.2.

- ↑ Artin (1991), Capítulo 4.5.

- ↑ Serre (2007), p. 20.

- ↑ Rowen (2008), p. 198, Exemplo 19.2.

- ↑ Consulte qualquer referência em teoria de representação ou representação de grupo.

- ↑ Consulte o verbete "Matriz" em Itô 1987.

- ↑ Boos (2000), pp. 34–39, 2.2 Lidando com matrizes infinitas.

- ↑ Grillet (2007), p. 334.

- ↑ "Pouco da teoria de matrizes se transpõe para os espaços de dimensão infinita, e o que transita não é tão útil, mas por vezes ajuda." Halmos 1982, p. 23, Capítulo 5.

- ↑ "Empty Matrix: A matrix is empty if either its row or column dimension is zero", Glossário Arquivado em 2009-04-29 no Wayback Machine, Guia de Utilizador do O-Matrix v6

- ↑ Coleman & Van Loan (1988), p. 213.

- ↑ Hazewinkel & Gubareni (2017), p. 151.

- ↑ A notação de matriz vazia é usada de forma diferente de algumas fontes, como (Bernstein 2009, p. 90), que usa , assemelhando-se à matriz nula; (Hazewinkel & Gubareni 2017, p. 151) usa .

- ↑ West (2020), p. 750.

- 1 2 Farid, Khan & Wang (2013), 2087.

- ↑ Reutenauer & Straubing (1984), 351.

- ↑ Ghosh (1996), 222.

- 1 2 Carboni, Kasangian & Walters (1987), 137.

- ↑ Manning & Schütze (1999), Seção 15.3.4.

- ↑ Ward (1997), Cap. 2.8.

- ↑ Abłamowicz (2000), p. 436.

- ↑ Fudenberg & Tirole (1983), Seção 1.1.1.

- ↑ McHugh (2025), p. 390, 11.2.3 O ganho esperado como um produto vetor-matriz-vetor.

- ↑ Matoušek & Gärtner (2007), pp. 136–137.

- ↑ Stinson (2005), Cap. 1.1.5 e 1.2.4.

- ↑ ISRD Group (2005), Cap. 7.

- ↑ Bhaya & Kaszkurewicz (2006), p. 230.

- ↑ Jensen (1999), pp. 65–69.

- ↑ Godsil & Royle (2004), Cap. 8.1.

- ↑ Punnen & Gutin (2002).

- ↑ Zhang, Yu & Hou (2006), p. 7.

- ↑ Scott & Tůma (2023).

- ↑ Lang (1987), Cap. XVI.6.

- ↑ Nocedal & Wright (2006), Cap. 16.

- ↑ Lang (1987), Cap. XVI.1.

- ↑ Lang 1987, Cap. XVI.5. Para uma formulação mais avançada e geral, consulte Lang 1969, Cap. VI.2.

- ↑ Gilbarg & Trudinger (2001).

- ↑ Šolin 2005, Cap. 2.5. Ver também método da rigidez.

- ↑ Latouche & Ramaswami (1999).

- ↑ Mehata & Srinivasan (1978), Cap. 2.8.

- ↑ Healy, Michael (1986), Matrices for Statistics, ISBN 978-0-19-850702-4, Oxford University Press

- ↑ Krzanowski (1988), p. 60, Cap. 2.2.

- ↑ Krzanowski (1988), Cap. 4.1.

- ↑ Conrey 2007

- ↑ Zabrodin, Brézin & Kazakov et al. 2006

- ↑ Schiff (1968), Cap. 6.

- ↑ Peres (1993), p. 20.

- ↑ Bohm (2001), seções I.8, II.4, e II.8.

- ↑ Peres (1993), p. 73.

- ↑ Itzykson & Zuber (1980), Cap. 2.

- ↑ Burgess & Moore (2007), seção 1.6.3. (SU(3)), seção 2.4.3.2. (Matriz de Kobayashi-Maskawa).

- ↑ Weinberg (1995), Cap. 3.

- ↑ Wherrett (1987), parte II.

- ↑ Riley, Hobson & Bence (1997), 7.17.

- ↑ Guenther (1990), Cap. 5.

- ↑ Suresh Kumar (2009), pp. 747–749.

Bibliografia

- Callioli, Carlos A.; Domingues, Hygino H.; Costa, Roberto C. F. (1990). Álgebra Linear e Aplicações (PDF) 6ª ed. São Paulo: Atual. ISBN 9788570562975

Referências matemáticas

- Andrilli, Stephen; Hecker, David (2022), Elementary Linear Algebra, ISBN 9780323984263 6th ed. , Academic Press

- Anton, Howard (2010), Elementary Linear Algebra, ISBN 978-0-470-45821-1 10th ed. , John Wiley & Sons, p. 414

- Arnold, Vladimir I. (1992), Ordinary differential equations, ISBN 978-3-540-54813-3, traduzido por Cooke, Roger, Berlin, DE; New York, NY: Springer-Verlag

- Artin, Michael (1991), Algebra, ISBN 978-0-89871-510-1, Prentice Hall

- Axler, Sheldon (1997), Linear Algebra Done Right, ISBN 9780387982595, Undergraduate Texts in Mathematics 2nd ed. , Springer

- Baker, Andrew J. (2003), Matrix Groups: An Introduction to Lie Group Theory, ISBN 978-1-85233-470-3, Berlin, DE; New York, NY: Springer-Verlag

- Bau III, David; Trefethen, Lloyd N. (1997), Numerical linear algebra, ISBN 978-0-89871-361-9, Philadelphia, PA: Society for Industrial and Applied Mathematics

- Ben-Israel, Adi; Greville, Thomas Nall Eden (2003), Generalized Inverses: Theory and Applications, ISBN 978-0-387-00293-4 2nd ed. , New York, NY: Springer, doi:10.1007/b97366

- Bernstein, Dennis S. (2009), Matrix mathematics: theory, facts, and formulas, ISBN 978-1-4008-3334-4 2nd ed. , Princeton, N.J: Princeton University Press

- Bhaya, Amit; Kaszkurewicz, Eugenius (2006), Control Perspectives on Numerical Algorithms and Matrix Problems, ISBN 9780898716023, Advances in Design and Control, 10, SIAM

- Bierens, Herman J. (2004), Introduction to the Mathematical and Statistical Foundations of Econometrics, ISBN 9780521542241, Cambridge University Press

- Boos, Johann (2000), Classical and Modern Methods in Summability, ISBN 9780198501657, Oxford mathematical monographs, Oxford University Press

- Bretscher, Otto (2005), Linear Algebra with Applications 3rd ed. , Prentice Hall

- Bronson, Richard (1970), Matrix Methods: An Introduction, New York: Academic Press, LCCN 70097490

- Bronson, Richard (1989), Schaum's outline of theory and problems of matrix operations, ISBN 978-0-07-007978-6, New York: McGraw–Hill

- Brown, William C. (1991), Matrices and vector spaces, ISBN 978-0-8247-8419-5, New York, NY: Marcel Dekker

- Brualdi, Richard A.; Carmona, Ángeles; van den Driessche, P.; Kirkland, Stephen; Stevanović, Dragan (2018), Encinas, Andrés M.; Mitjana, Margarida, eds., Combinatorial Matrix Theory, ISBN 978-3-319-70952-9, Advanced Courses in Mathematics. CRM Barcelona, Birkhäuser/Springer, Cham, MR 3791450, doi:10.1007/978-3-319-70953-6

- Cameron, Peter J. (2014), «Matrix groups» (PDF), in: Hogben, Leslie, Handbook of Linear Algebra, ISBN 978-1-4665-0728-9, Discrete Mathematics and its Applications (Boca Raton) 2nd ed. , CRC Press, Boca Raton, FL, MR 3013937

- Carboni, Aurelio; Kasangian, Stefano; Walters, Robert (1987), «An axiomatics for bicategories of modules», Journal of Pure and Applied Algebra, 45 (2): 127–141, MR 0889588, Zbl 0615.18006, doi:10.1016/0022-4049(87)90065-X

- Chahal, J. S. (2018), Fundamentals of Linear Algebra, ISBN 9780429758119, CRC Press

- Coburn, Nathaniel (1955), Vector and tensor analysis, New York, NY: Macmillan, OCLC 1029828

- Coleman, Thomas F.; Van Loan, Charles (1988), Handbook for Matrix Computations, ISBN 9780898712278, Frontiers in Applied Mathematics, 4, SIAM

- Conrey, J. Brian (2007), Ranks of elliptic curves and random matrix theory, ISBN 978-0-521-69964-8, Cambridge University Press

- Dossey, John A. (2002), Discrete Mathematics, ISBN 9780321079121 4th ed. , Addison Wesley

- Conway, John B. (1990), A Course in Functional Analysis, ISBN 0-387-97245-5, Graduate Texts in Mathematics, 96 2nd ed. , Springer

- Edwards, Harold M. (2004), Linear Algebra, ISBN 9780817643706, Springer Science & Business Media

- Farid, F. O.; Khan, Israr Ali; Wang, Qing-Wen (2013), «On matrices over an arbitrary semiring and their generalized inverses», Linear Algebra and its Applications, 439 (7): 2085–2105, MR 3090456, Zbl 1283.15016, doi:10.1016/j.laa.2013.06.002

- Fraleigh, John B. (1976), A First Course In Abstract Algebra, ISBN 0-201-01984-1 2nd ed. , Reading: Addison-Wesley

- Fudenberg, Drew; Tirole, Jean (1983), Game Theory, MIT Press

- Gentle, James E. (1998), Numerical Linear Algebra for Applications in Statistics, ISBN 9780387985428, Springer

- Ghosh, Shamik (1996), «Matrices over semirings», Information Sciences, 90 (1-4): 221–230, MR 1388422, Zbl 0884.15010, doi:10.1016/0020-0255(95)00283-9

- Gilbarg, David; Trudinger, Neil S. (2001), Elliptic partial differential equations of second order, ISBN 978-3-540-41160-4 2nd ed. , Berlin, DE; New York, NY: Springer-Verlag

- Godsil, Chris; Royle, Gordon (2004), Algebraic Graph Theory, ISBN 978-0-387-95220-8, Graduate Texts in Mathematics, 207, Berlin, DE; New York, NY: Springer-Verlag

- Golub, Gene H.; Van Loan, Charles F. (1996), Matrix Computations, ISBN 978-0-8018-5414-9 3rd ed. , Johns Hopkins

- Greub, Werner Hildbert (1975), Linear algebra, ISBN 978-0-387-90110-7, Graduate Texts in Mathematics, Berlin, DE; New York, NY: Springer-Verlag

- Grillet, Pierre Antoine (2007), Abstract Algebra, ISBN 9780387715681, Graduate Texts in Mathematics, 242 2nd ed. , Springer

- Hachenberger, Dirk; Jungnickel, Dieter (2020), Topics in Galois Fields, ISBN 978-3-030-60804-0, Algorithms and Computation in Mathematics, 29, Cham: Springer, MR 4233161, doi:10.1007/978-3-030-60806-4

- Halmos, Paul Richard (1982), A Hilbert space problem book, ISBN 978-0-387-90685-0, Graduate Texts in Mathematics, 19 2nd ed. , Berlin, DE; New York, NY: Springer-Verlag, MR 675952

- Grossman, Stanley I. (1994), Elementary Linear Algebra, ISBN 9780030973543 5th ed. , Saunders College Pub.

- Hamilton, A. G. (1987), A First Course in Linear Algebra: With Concurrent Examples, ISBN 9780521310413, Cambridge University Press

- Hazewinkel, Michiel; Gubareni, Nadiya M. (2017), Algebras, Rings and Modules, Volume 2: Non-commutative Algebras and Rings 2nd ed. , CRC Press

- Horn, Roger A.; Johnson, Charles R. (1985), Matrix Analysis, ISBN 978-0-521-38632-6, Cambridge University Press

- Householder, Alston S. (1975), The theory of matrices in numerical analysis, New York, NY: Dover Publications, MR 0378371

- Hungerford, Thomas W. (1980), Algebra, ISBN 0-387-90518-9, Graduate Texts in Mathematics, 73, Springer-Verlag, New York-Berlin, MR 600654

- ISRD Group (2005), Computer Graphics, ISBN 978-0-07-059376-3, Tata McGraw–Hill

- Itô, Kiyosi, ed. (1987), Encyclopedic dictionary of mathematics. Vol. I-IV, ISBN 978-0-262-09026-1 2nd ed. , MIT Press, MR 901762

- Jeffrey, Alan (2010), Matrix Operations for Engineers and Scientists: An Essential Guide in Linear Algebra, ISBN 9789048192748, Springer

- Johnston, Nathaniel (2021), Introduction to Linear and Matrix Algebra, ISBN 9783030528119, Springer Nature

- Kreyszig, Erwin (1972), Advanced Engineering Mathematics, ISBN 0-471-50728-8 3rd ed. , New York: Wiley.

- Krzanowski, Wojtek J. (1988), Principles of multivariate analysis, ISBN 978-0-19-852211-9, Oxford Statistical Science Series, 3, The Clarendon Press Oxford University Press, MR 969370

- Lam, T. Y. (1999), Lectures on Modules and Rings, ISBN 0-387-98428-3, Graduate Texts in Mathematics, 189, Springer-Verlag, New York, MR 1653294, doi:10.1007/978-1-4612-0525-8

- Lancaster, Peter; Tismenetsky, Miron (1985), The Theory of Matrices: With Applications, ISBN 9780080519081 2nd ed. , Elsevier

- Lang, Serge (1969), Analysis II, Addison-Wesley

- Lang, Serge (1986), Introduction to Linear Algebra, ISBN 9781461210702 2nd ed. , Springer

- Lang, Serge (1987), Calculus of several variables, ISBN 978-0-387-96405-8 3rd ed. , Berlin, DE; New York, NY: Springer-Verlag

- Predefinição:Lang Algebra

- Latouche, Guy; Ramaswami, Vaidyanathan (1999), Introduction to matrix analytic methods in stochastic modeling, ISBN 978-0-89871-425-8 1st ed. , Philadelphia, PA: Society for Industrial and Applied Mathematics

- Manning, Christopher D.; Schütze, Hinrich (1999), Foundations of statistical natural language processing, ISBN 978-0-262-13360-9, MIT Press

- Margalit, Dan; Rabinoff, Joseph (2019), «Determinants and Volumes», Georgia Institute of Technology, Interactive Linear Algebra, consultado em 10 de maio de 2025

- Matoušek, Jiří; Gärtner, Bernd (2007), Understanding and Using Linear Programming, ISBN 9783540307174, Springer Science & Business Media

- Maxwell, E. A. (1969), Algebraic Structure and Matrices, Being Part II of Advanced Algebra, Cambridge University Press

- McHugh, Andrew (2025), Finite Mathematics: An Introduction with Applications in Business, Social Sciences, and Music, ISBN 9780443290954, Academic Press

- Meckes, Elizabeth S.; Meckes, Mark W. (2018), Linear Algebra, ISBN 9781316836026, Cambridge University Press