Autocodificador variacional

| Parte de uma série sobre |

| Aprendizado de máquina e mineração de dados |

|---|

|

Na aprendizagem de máquina, um autocodificador variacional (variational autoencoder ou VAE em inglês) é uma arquitetura de rede neural artificial introduzida por Diederik P. Kingma e Max Welling. [1] Faz parte das famílias de modelos gráficos probabilísticos e métodos bayesianos variacionais. [2]

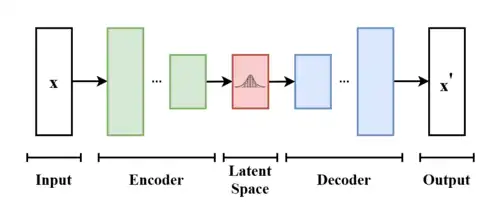

Além de serem vistos como uma arquitetura de rede neural autocodificadora, os autocodificadores variacionais também podem ser estudados dentro da formulação matemática de métodos bayesianos variacionais, conectando uma rede codificadora neural ao seu decodificador por meio de um espaço latente probabilístico (por exemplo, como uma distribuição gaussiana multivariada) que corresponde aos parâmetros de uma distribuição variacional.

Assim, o codificador mapeia cada ponto (como uma imagem) de um grande conjunto de dados complexos em uma distribuição dentro do espaço latente, em vez de um único ponto nesse espaço. O decodificador tem a função oposta, que é mapear do espaço latente para o espaço de entrada, novamente de acordo com uma distribuição (embora, na prática, o ruído raramente seja adicionado durante o estágio de decodificação). Ao mapear um ponto para uma distribuição em vez de um único ponto, a rede pode evitar o overfitting dos dados de treinamento. Ambas as redes são normalmente treinadas em conjunto com o uso do truque de reparametrização, embora a variância do modelo de ruído possa ser aprendida separadamente.

Embora este tipo de modelo tenha sido inicialmente concebido para aprendizagem não supervisionada, [3] [4] a sua eficácia foi comprovada para aprendizagem semi-supervisionada [5] [6] e aprendizagem supervisionada. [7]

Veja também

Referências

- ↑ Kingma, Diederik P.; Welling, Max (10 de dezembro de 2022). «Auto-Encoding Variational Bayes». arXiv:1312.6114

[stat.ML]

[stat.ML]

- ↑ Pinheiro Cinelli, Lucas; et al. (2021). «Variational Autoencoder». Variational Methods for Machine Learning with Applications to Deep Networks. [S.l.]: Springer. pp. 111–149. ISBN 978-3-030-70681-4. doi:10.1007/978-3-030-70679-1_5

- ↑ Dilokthanakul, Nat; Mediano, Pedro A. M. (13 de janeiro de 2017). «Deep Unsupervised Clustering with Gaussian Mixture Variational Autoencoders». arXiv:1611.02648

[cs.LG]

[cs.LG]

- ↑ Hsu, Wei-Ning; Zhang, Yu; Glass, James (dezembro de 2017). «Unsupervised domain adaptation for robust speech recognition via variational autoencoder-based data augmentation». 2017 IEEE Automatic Speech Recognition and Understanding Workshop (ASRU). [S.l.: s.n.] pp. 16–23. ISBN 978-1-5090-4788-8. arXiv:1707.06265

. doi:10.1109/ASRU.2017.8268911

. doi:10.1109/ASRU.2017.8268911

- ↑ Ehsan Abbasnejad, M.; Dick, Anthony; van den Hengel, Anton (2017). Infinite Variational Autoencoder for Semi-Supervised Learning. [S.l.: s.n.] pp. 5888–5897

- ↑ Xu, Weidi; Sun, Haoze; Deng, Chao; Tan, Ying (12 de fevereiro de 2017). «Variational Autoencoder for Semi-Supervised Text Classification». Proceedings of the AAAI Conference on Artificial Intelligence (em inglês). 31 (1). doi:10.1609/aaai.v31i1.10966

- ↑ Kameoka, Hirokazu; Li, Li; Inoue, Shota; Makino, Shoji (1 de setembro de 2019). «Supervised Determined Source Separation with Multichannel Variational Autoencoder». Neural Computation. 31 (9): 1891–1914. PMID 31335290. doi:10.1162/neco_a_01217