Máquina de vetores de relevância

| Parte de uma série sobre |

| Aprendizado de máquina e mineração de dados |

|---|

|

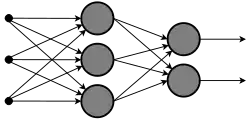

Na matemática, uma máquina de vetores de relevância (RVM) é uma técnica de aprendizado de máquina que usa a inferência bayesiana para obter soluções parcimoniosas para regressão e classificação de probabilidades. [1] Um procedimento de otimização guloso e, portanto, uma versão rápida foram posteriormente desenvolvidos. [2] [3] A RVM tem uma forma funcional idêntica à máquina de vetores de suporte, mas esta fornece uma classificação probabilística.

Na verdade, equivale a um modelo de processo gaussiano com função de covariância:

com sendo a função kernel (geralmente gaussiana), são as variâncias do prior no vetor de peso , e são os vetores de entrada do conjunto de treinamento. [4]

Comparada à das máquinas de vetores de suporte (SVM), a formulação bayesiana da RVM evita o conjunto dos parâmetros livres da SVM (que geralmente requer pós-otimizações baseadas na validação cruzada). No entanto, as RVMs utilizam um método de aprendizado semelhante à maximização de expectativas (EM) e, portanto, correm o risco de mínimos locais. Isso é diferente dos algoritmos padrão baseados em otimização mínima sequencial (SMO) empregados pelas SVMs, que garantem a busca de um ótimo global (do problema convexo).

A máquina de vetores de relevância foi patenteada nos Estados Unidos pela Microsoft onde expirou em 4 de setembro de 2019. [5]

Referências

- ↑ Tipping, Michael E. (2001). «Sparse Bayesian Learning and the Relevance Vector Machine». Journal of Machine Learning Research. 1: 211–244

- ↑ Tipping, Michael; Faul, Anita (2003). «Fast Marginal Likelihood Maximisation for Sparse Bayesian Models». Proceedings of the Ninth International Workshop on Artificial Intelligence and Statistics: 276–283. Consultado em 21 de novembro de 2024

- ↑ Faul, Anita; Tipping, Michael (2001). «Analysis of Sparse Bayesian Learning» (PDF). Advances in Neural Information Processing Systems. Consultado em 21 de novembro de 2024

- ↑ Candela, Joaquin Quiñonero. «Sparse Probabilistic Linear Models and the RVM». Learning with Uncertainty - Gaussian Processes and Relevance Vector Machines (PDF) (Ph.D.)

- ↑ US 6633857, Michael E. Tipping