Attention Is All You Need

“Attention Is All You Need” [1] é um artigo científico de 2017[2][3] sobre aprendizado de máquina, escrito por oito cientistas que trabalham no Google. O artigo propõe uma nova arquitetura de aprendizado profundo conhecida como transformer, com base no mecanismo de atenção proposto em 2014 por Bahdanau et al.[4] É considerado um artigo fundamental[5] na inteligência artificial moderna e um dos principais contribuidores para o boom da IA, com o modelo transformer proposto pelo artigo se tornando a arquitetura principal de uma ampla variedade de IA, como grandes modelos de linguagem. Na época, o foco da pesquisa era melhorar as técnicas Seq2seq para tradução automática, mas os autores vão mais longe no artigo, prevendo o potencial da técnica para outras tarefas, como responder a perguntas e o que hoje é conhecido como IA generativa multimodal.[1]

O título do artigo é uma referência à canção "All You Need Is Love" dos Beatles.[6] O nome “Transformer”, por sua vez, foi escolhido porque Jakob Uszkoreit, um dos autores do artigo, gostou da sonoridade da palavra.[7]

Uma primeira versão do artigo havia sido nomeada "Transformers: Iterative Self-Attention and Processing for Various Tasks" e incluía uma ilustração de seis personagens da franquia Transformers. A equipe foi nomeada como "Team Transformer".[6]

Alguns exemplos iniciais nos quais a equipe testou sua arquitetura Transformer incluíram tradução do inglês para o alemão, geração de artigos para a Wikipédia sobre "The Transformer" e análise sintática de arquivos. Isso convenceu a equipe de que o Transformer é um modelo de linguagem de propósito geral e não restrito a tradução. [7]

Desde 2025 o artigo foi citado mais de 173.000 vezes,[8] sendo um dos dez artigos científicos mais citados do século XXI.[9]

Autores

Os autores do artigo são: Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Aidan Gomez, Łukasz Kaiser e Illia Polosukhin. Todos os oito autores colaboraram igualmente na construção do artigo; a ordem listada foi aleatória. Um artigo da Wired destaca a diversidade do grupo:[6]

Seis dos oito autores nasceram fora dos Estados Unidos; os outros dois são filhos de alemães portadores de green card que estavam temporariamente na Califórnia e de um americano de primeira geração cuja família fugiu da perseguição, respectivamente.

Depois da publicação do artigo, cada um dos autores deixou o Google para se juntar a outras empresas ou fundar startups. Vários deles expressaram sentimentos de incapacidade de inovar e expandir o Transformer na direção que desejavam se tivessem permanecido no Google.[10]

Métodos discutidos e introduzidos

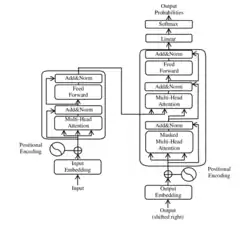

O artigo é mais conhecido pela introdução da arquitetura Transformer, que forma a arquitetura subjacente para a maioria das formas de Large Language Models (LLMs) modernos. Um dos principais motivos pelos quais a arquitetura é escolhida pela maioria dos LLMs modernos é a possibilidade de paralelização da arquitetura, diferentemente de suas predecessoras. Isso garante que as operações necessárias para o treinamento possam ser aceleradas através de GPUs, permitindo tempos de treinamento mais rápidos, e consequentemente o treinamento de modelos de tamanhos maiores.

Os seguintes mecanismos foram introduzidos pelo artigo como parte do desenvolvimento da arquitetura Transformer.

Atenção e autoatenção por produto escalar

O uso do mecanismo de atenção e autoatenção de produto escalar em vez de uma rede neural recorrente ou de uma memória de curto prazo longa (que dependem da recorrência) permite melhor desempenho. O artigo descreveu a atenção escalonada do produto escalar através da seguinte forma:

onde , , são respectivamente as matrizes de consulta (query), chave (key), valor (value) e é a dimensão dos valores.

Tendo em vista que o modelo depende de matrizes de Consulta, Chave e Valor que vêm da mesma fonte (ou seja, a sequência de entrada/janela de contexto), isso elimina a necessidade de RNNs, garantindo a possibilidade de paralelização da arquitetura. Isso difere da forma original do mecanismo de Atenção introduzido em 2014. Além disso, o artigo também discute o uso de um fator de escala adicional que se mostrou mais eficaz e eficiente em relação à dimensão dos vetores-chave (representados como e inicialmente definido como 64 no artigo) da maneira mostrada pela fórmula acima.

No contexto específico do uso do modelo para tradução em que o artigo se concentrou, as matrizes de Consulta e Chave são geralmente representadas em embeddings correspondentes ao idioma de origem, enquanto a matriz de Valor corresponde ao idioma de destino.

Atenção "multi-head"

No mecanismo de autoatenção, consultas (Q), chaves (K) e valores (V) são gerados de maneira dinâmica para cada sequência de entrada (tipicamente limitada pelo tamanho da janela de contexto), permitindo que o modelo foque em diferentes partes da sequência de entrada em diferentes etapas. A atenção "multi-head" aprimora esse processo ao introduzir múltiplas "cabeças" de atenção paralelas. Cada cabeça de atenção aprende diferentes projeções lineares das matrizes Q, K e V. Isso permite que o modelo capture diferentes aspectos dos relacionamentos entre as palavras na sequência simultaneamente, em vez de focar em um único aspecto.

Ao fazer isso, a atenção "multi-head" garante que os embeddings de entrada sejam atualizados a partir de um conjunto mais variado e diverso de perspectivas. Depois que as saídas de atenção de todas as cabeças são calculadas, elas são concatenadas e passadas por uma transformação linear final para gerar a saída.

Codificação posicional

Como o modelo Transformer não é um modelo seq2seq e não depende da sequência do texto para realizar a codificação (encoding) e decodificação (decoding), o artigo se baseou no uso de funções de onda seno e cosseno para codificar a posição do token no embedding. Os métodos apresentados no artigo são os seguintes:

onde , , correspondem à posição da palavra, ao índice de dimensão atual e à dimensão do modelo, respectivamente. A função seno é usada para índices pares de incorporação, enquanto a função cosseno é usada para índices ímpares. O resultante embedding é então adicionada à palavra na posição correspondente em relação à janela de contexto atual. O artigo comenta especificamente por que esse método foi escolhido, descrevendo:

“Escolhemos a versão sinusoidal porque ela pode permitir que o modelo extrapole para comprimentos de sequência maiores do que os encontrados durante o treinamento.” [1]

Parâmetros técnicos

Treinamento

Embora o foco principal do artigo na época fosse melhorar a tradução automática, o artigo também discutiu o uso da arquitetura no English Constituency Parsing, tanto com conjuntos de dados limitados quanto com conjuntos de grande porte, alcançando uma pontuação alta sem ajuste fino específico para a tarefa, indicando a natureza promissora do modelo para uso em uma ampla variedade de tarefas seq2seq de propósito geral.

Conjunto de dados

O modelo de tradução do inglês para o alemão foi treinado no conjunto de dados inglês-alemão do WMT (Workshop on Statistical Machine Translation) de 2014, composto por quase 4,5 milhões de frases derivadas de palestras do TED Talks e artigos de notícias de alta qualidade. Um modelo de tradução separado foi treinado no conjunto de dados inglês-francês do WMT de 2014, muito maior, composto por 36 milhões de frases. Ambos os conjuntos de dados foram codificados com codificação de pares de bytes.

Hardware

Os modelos foram treinados usando 8 GPUs NVIDIA P100. Os modelos base foram treinados para 100.000 etapas e os modelos de grande escala foram treinados para 300.000 etapas — cada etapa levando cerca de 0,4 segundos para ser concluído para os modelos base e 1,0 segundo para os modelos de grande escala. O modelo base treinou por um total de 12 horas, e o modelo grande treinou por um total de 3,5 dias. Tanto o modelo básico quanto o grande superam o modelo de última geração de 2017 em inglês-alemão e inglês-francês, ao mesmo tempo em que alcançam o menor custo de treinamento comparativamente.[1] O custo estimado de computação foi de 0,089 petaFLOP-dias.[11]

Hiperparâmetros e regularização

Para o modelo Transformer de 100 milhões de parâmetros proposto, os autores aumentaram a taxa de aprendizado linearmente para as primeiras 4.000 etapas (aquecimento) e a diminuíram proporcionalmente à raiz quadrada inversa do número da etapa atual. Camadas de eliminação foram aplicadas à saída de cada subcamada antes da normalização, das somas dos embeddings e das codificações posicionais. A taxa de evasão foi definida como 0,1. A suavização de rótulos foi aplicada com um valor de 0,1, o que "melhora a precisão e a pontuação BLEU".[1]

Referências

- ↑ a b c d e Vaswani, Ashish; Shazeer, Noam; Parmar, Niki; Uszkoreit, Jakob; Jones, Llion; Gomez, Aidan N; Kaiser, Łukasz; Polosukhin, Illia (dezembro de 2017). I. Guyon and U. Von Luxburg and S. Bengio and H. Wallach and R. Fergus and S. Vishwanathan and R. Garnett, ed. 31st Conference on Neural Information Processing Systems (NIPS). Advances in Neural Information Processing Systems. 30. Curran Associates, Inc. arXiv:1706.03762

- ↑ Love, Julia (10 de julho de 2023). «AI Researcher Who Helped Write Landmark Paper Is Leaving Google». Bloomberg News. Consultado em 1 de abril de 2024

- ↑ Goldman, Sharon (20 de março de 2024). «'Attention is All You Need' creators look beyond Transformers for AI at Nvidia GTC: 'The world needs something better'». VentureBeat. Consultado em 1 de abril de 2024

- ↑ Bahdanau, Dzmitry; Cho, Kyunghyun (19 de maio de 2016). «Neural Machine Translation by Jointly Learning to Align and Translate». arXiv:1409.0473

[cs.CL]

[cs.CL]

- ↑ Shinde, Gitanjali; Wasatkar, Namrata; Mahalle, Parikshit (6 de junho de 2024). Data-Centric Artificial Intelligence for Multidisciplinary Applications. [S.l.]: CRC Press. ISBN 9781040031131

- ↑ a b c Levy, Steven. «8 Google Employees Invented Modern AI. Here's the Inside Story». Wired (em inglês). ISSN 1059-1028. Consultado em 20 de março de 2024

- ↑ a b Marche, Stephen (23 de agosto de 2024). «Was Linguistic A.I. Created by Accident?». The New Yorker (em inglês). ISSN 0028-792X. Consultado em 24 de agosto de 2024

- ↑ «Meet the $4 Billion AI Superstars That Google Lost». Bloomberg. 13 de julho de 2023 – via www.bloomberg.com

- ↑ «Exclusive: the most-cited papers of the twenty-first century». Nature. 15 de abril de 2025. Consultado em 18 de abril de 2025

- ↑ Murgia, Madhumita (23 de julho de 2023). «Transformers: the Google scientists who pioneered an AI revolution». Financial Times. Consultado em 22 de março de 2025

- ↑ «AI and compute». openai.com (em inglês). 9 de junho de 2022. Consultado em 29 de abril de 2025

Ligações externas

- Uszkoreit, Jakob (31 de agosto de 2017). «Transformer: A Novel Neural Network Architecture for Language Understanding». research.google (em inglês). Consultado em 9 de agosto de 2024. Post no blog do Google Research.