Processamento da linguagem no cérebro

Material copiado desta fonte, disponível sob a Creative Commons Atribuição 4.0 Internacional.

Material copiado desta fonte, disponível sob a Creative Commons Atribuição 4.0 Internacional. Em Psicolinguística, processamento de linguagem refere-se à maneira como os seres humanos usam palavras para comunicar ideias e sentimentos, e como tais comunicações são processadas e compreendidas (processados). O processamento de linguagem é considerado uma habilidade exclusivamente humana, não produzida com o mesmo entendimento gramatical ou sistematicidade mesmo nos parentes primatas mais próximos dos humanos.[1]

Ao longo do século XX, o modelo dominante[2] para o processamento de linguagem no cérebro foi o modelo Geschwind–Lichteim–Wernicke, baseado principalmente na análise de pacientes com lesão cerebral. No entanto, devido a avanços em gravações intra-corticais eletrofisiológicas em cérebros de macacos e humanos, bem como em técnicas não invasivas como fMRI, PET, MEG e EEG, revelou-se uma via auditiva dupla[3][4] e desenvolveu-se um modelo de dois fluxos. De acordo com esse modelo, há duas vias que conectam o córtex auditivo ao lobo frontal, cada qual responsável por diferentes funções linguísticas. A via do fluxo ventral auditivo é responsável pelo reconhecimento de sons, sendo conhecida como via auditiva do “o quê”. O fluxo dorsal auditivo tanto em humanos quanto em primatas não humanos é responsável pela localização de sons, sendo chamado de via auditiva do “onde”. Nos humanos, essa via (especialmente no hemisfério esquerdo) também é responsável pela produção da fala, repetição de fala, leitura labial e pela memória de trabalho fonológica e memória de longo prazo fonológica. De acordo com o modelo “do onde para o quê” da evolução da linguagem,[5][6] o motivo pelo qual o ADS apresenta uma gama tão ampla de funções é que cada uma delas indica um estágio diferente na evolução da linguagem.

A divisão dos dois fluxos ocorre inicialmente no nervo auditivo, onde o ramo anterior entra no núcleo coclear anterior do tronco encefálico, dando origem ao fluxo ventral auditivo. O ramo posterior entra no núcleo coclear dorsal e posteroventral, dando origem ao fluxo dorsal auditivo.[7]:8

O processamento de linguagem também pode ocorrer em línguas de sinais ou em conteúdo escrito.

Modelos iniciais de neurolinguística

Ao longo do século XX, o conhecimento sobre o processamento de linguagem no cérebro foi dominado pelo modelo Wernicke–Lichteim–Geschwind.[8][2][9] Esse modelo baseia-se em pesquisas com indivíduos com lesão cerebral que apresentavam diversos distúrbios relacionados à linguagem. De acordo com ele, as palavras são percebidas por um centro especializado de recepção de palavras (Área de Wernicke) localizado na junção temporoparietal esquerda. Essa região projeta-se para um centro de produção de palavras (Área de Broca) localizado no giro frontal inferior esquerdo. Como quase toda a entrada de linguagem era pensada como passando pela área de Wernicke e toda a saída pela área de Broca, tornou-se extremamente difícil definir as propriedades básicas de cada região. Essa falta de definição clara da contribuição das áreas de Wernicke e Broca para a linguagem humana dificultou a identificação de seus homólogos em outros primatas.[10] Com o advento da fMRI e sua aplicação em mapeamentos de lesões, foi demonstrado que esse modelo se baseava em correlações incorretas entre sintomas e lesões.[11][12][13][14][15][16][17] A refutação de tal modelo influente e dominante abriu caminho para novos modelos de processamento de linguagem no cérebro.

Modelos atuais de neurolinguística

Anatomia

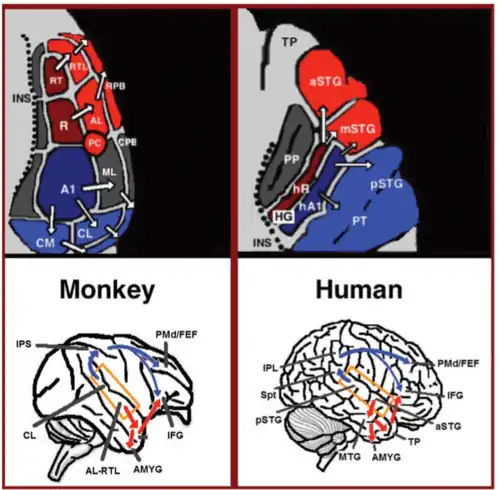

Nas últimas duas décadas, ocorreram avanços significativos na compreensão do processamento neural de sons em primatas. Inicialmente por meio de registros de atividade neural no córtex auditivo de macacos[18][19] e posteriormente elucidados por meio de colorações histológicas[20][21][22] e estudos de fMRI,[23] foram identificados três campos auditivos no córtex auditivo primário e nove campos auditivos associativos que o cercam (Figura 1, canto superior esquerdo). Estudos de marcação anatômica e lesões indicaram uma separação entre campos auditivos anteriores e posteriores: campos auditivos primários anteriores (áreas R-RT) projetam-se para campos auditivos associativos anteriores (áreas AL-RTL), enquanto o campo auditivo primário posterior (área A1) projeta-se para campos auditivos associativos posteriores (áreas CL-CM).[20][24][25][26] Evidências recentes indicam homologia entre os campos auditivos de humanos e macacos. Em humanos, colorações histológicas revelaram dois campos auditivos distintos na região primária do giro de Heschl,[27][28] e m mapeamentos tonotópicos de alta resolução por fMRI comparou-se a organização tonotópica humana à do macaco, estabelecendo correspondência entre o campo primário anterior humano (hR) e a área R do macaco, e entre o campo primário posterior humano (hA1) e a área A1 do macaco.[29][30][31][32][33] Registros intra-corticais no córtex auditivo humano mostraram padrões de conectividade semelhantes aos do macaco: área anterior do giro de Heschl (hR) projeta-se principalmente para a porção médio-anterior do giro temporal superior (mSTG–aSTG), e a área posterior de Heschl (hA1) projeta-se para a porção posterior do giro temporal superior (pSTG) e para o planum temporale (área PT; Figura 1, canto superior direito).[34][35] Em concordância, estudo de fMRI com paciente portador de agnosia auditiva apontou redução de ativação bilateral em hR e aSTG, com ativação preservada em mSTG–pSTG.[36][37]

A jusante do córtex auditivo, estudos de marcação anatômica em macacos delinearam projeções dos campos auditivos associativos anteriores (áreas AL–RTL) para córtices pré-frontais ventrais e premotores no giro frontal inferior (IFG)[38][39] e a amígdala.[40] Estudos de gravação cortical e de imagem funcional em macacos também mostraram que a informação acústica flui do córtex auditivo anterior para o polo temporal (TP) e então para o IFG.[41][42][43][44][45][46] Essa via é conhecida como fluxo ventral auditivo (AVS; Figura 1, setas vermelhas inferiores, canto esquerdo). Em contraste, estudos de marcação mostraram que campos auditivos posteriores (áreas CL–CM) projetam-se principalmente para córtices pré-frontais dorsolaterais e premotores, com algumas projeções terminando no IFG.[47][39] Gravações corticais e estudos de marcação anatômica em macacos mostraram que esse fluxo segue dos campos auditivos posteriores até o lobo frontal por uma estação de retransmissão no sulco intraparietal (IPS).[48][49][50][51][52][53] Essa via é chamada de fluxo dorsal auditivo (ADS; Figura 1, setas azuis inferiores, canto esquerdo). Comparações das vias de substância branca envolvidas na comunicação em humanos e macacos por meio de imagiologia por difusão indicam conexões semelhantes para AVS e ADS em ambas as espécies (Macaco,[52] Humano[54][55][56][57][58][59]). Em humanos, mostrou-se que pSTG projeta-se para o lobo parietal (junção temporal-parietal-silviana–ILP), e dali para córtices pré-frontais dorsolaterais e premotores (Figura 1, setas azuis inferiores, canto direito), e que aSTG projeta-se para o polo temporal anterior (giro temporal médio–polo temporal) e dali para o IFG (Figura 1, setas vermelhas inferiores, canto direito).

Fluxo ventral auditivo

O fluxo ventral auditivo (AVS) conecta o Córtex auditivo ao giro temporal médio e ao polo temporal, que por sua vez conectam-se ao giro frontal inferior. Essa via é responsável pelo reconhecimento de sons, sendo chamada de via auditiva do “quê”. As funções do AVS incluem:

Reconhecimento de sons

Evidências convergentes indicam que o AVS está envolvido no reconhecimento de objetos auditivos. No nível do córtex auditivo primário, gravações em macacos mostraram maior porcentagem de neurônios seletivos para sequências melódicas aprendidas na área R do que em A1,[60] e estudo em humanos mostrou maior seletividade para sílabas ouvidas na Heschl anterior (hR) do que na posterior (hA1).[61] Em campos auditivos associativos, estudos em macacos e humanos relataram que a fronteira entre campos auditivos anteriores e posteriores (Figura 1—área PC em macacos e mSTG em humanos) processa atributos de altura tonal necessários ao reconhecimento de objetos auditivos.[18][41][19][62] Estudos de imagem funcional e gravações intracorticais também mostraram seletividade do aSTG para vocalizações de espécies específicas e vozes individuais em macacos e humanos,[63][64][43] e sua participação no reconhecimento de vozes humanas.[42] Estudos de fMRI em humanos correlacionaram atividade no mSTG–aSTG com a separação de objetos auditivos de ruído de fundo[65][66] e com o reconhecimento de palavras faladas,[67][68][69][70][71][72][73] vozes,[74] melodias,[75][76] sons ambientais,[77][78][79] e sons comunicativos não verbais.[80] Uma meta-análise de estudos de fMRI[81] demonstrou dissociação funcional entre o mSTG (processamento de fonemas) e o aSTG (processamento de unidades maiores, como palavras). Registro intracortical no pSTG e aSTG esquerdos mostrou maior atividade no aSTG quando a paciente ouvia sua língua nativa em comparação com língua estrangeira.[82] A estimulação elétrica do aSTG dessa paciente resultou em prejuízo na percepção da fala,[83][84] corroborando a especialização lateral do AVS para fala em relação à música. Paciente com agnosia auditiva devido a lesão no tronco encefálico mostrou redução de ativação em hR e aSTG bilateral ao ouvir palavras e sons ambientais.[36] Gravações no córtex auditivo anterior de macacos durante manutenção de sons em memória de trabalho,[46] e efeitos de lesões induzidas nessa região sobre a recordação em memória de trabalho,[85][86][87] implicam o AVS na manutenção de objetos auditivos na memória de trabalho. Em humanos, mSTG–aSTG mostrou-se ativo durante ensaio de sílabas ouvidas por MEG[88] e por fMRI.[89] Esse estudo mostrou que a memória de trabalho no AVS é para propriedades acústicas de palavras faladas e é independente da memória de trabalho no ADS, que media a fala interna. Estudos em macacos sugerem que, ao contrário dos humanos, o AVS é a principal loja de memória de trabalho em audição.[90]

Em humanos, a jusante do aSTG, acredita-se que o giro temporal médio e o polo temporal constituam o léxico semântico, repositório de longo prazo de representações áudio-visuais interconectadas por relações semânticas. Estudos de pacientes com lesão nessa região (por exemplo, Demência semântica ou encefalite por herpes simplex) relatam incapacidade de descrever objetos visuais e auditivos e tendência a cometer erros semânticos na nomeação (semiafrasia semântica).[91][92] Semiafrasias semânticas também foram observadas em pacientes afásicos com lesão no giro temporal médio–polo temporal esquerdo[14][93] e após estimulação elétrica nessa região ou viações em fibras de substância branca subjacentes.[94][95] Duas meta-análises da literatura de fMRI também relataram ativação consistente do giro temporal médio anterior e do polo temporal durante análise semântica de fala e texto;[67][96] e gravações intracorticais correlacionaram disparos neurais no giro temporal médio com a compreensão de sentenças inteligíveis.[97]

Compreensão de sentenças

Além de extrair significado de sons, a região MTG-TP do VSA parece ter um papel na compreensão de sentenças, possivelmente ao fundir conceitos (por exemplo, fundindo os conceitos “azul” e “camisa” para criar o conceito de “camisa azul”). O papel do MTG na extração de significado de sentenças foi demonstrado em estudos de imageamento funcional que relatam maior ativação no MTG anterior quando sentenças gramaticais são contrastadas com listas de palavras, sentenças em idioma estrangeiro ou sem sentido, sentenças embaralhadas, sentenças com violações semânticas ou sintáticas e sequências semelhantes a sentenças de sons ambientais.[98][99][100][101][102][103][104][105] Um estudo de ressonância magnética funcional[106] em que os participantes foram instruídos a ler uma história correlacionou atividade no MTG anterior com a quantidade de conteúdo semântico e sintático de cada sentença. Um estudo de EEG[107] que contrastou atividade cortical durante a leitura de sentenças com e sem violações sintáticas em participantes saudáveis e pacientes com danos no MTG-TP concluiu que o MTG-TP em ambos os hemisférios participa da fase automática (baseada em regras) da análise sintática (componente ELAN) e que o MTG-TP esquerdo também está envolvido em uma fase controlada posterior da análise sintática (componente P600). Pacientes com danos na região MTG-TP também foram relatados com compreensão de sentenças prejudicada.[14][108][109] Veja revisão[110] para mais informações sobre este tópico.

Bilateralidade

Em contradição com o modelo de Wernicke–Lichtheim–Geschwind, que supõe que o reconhecimento de sons ocorre exclusivamente no hemisfério esquerdo, estudos que examinaram as propriedades de cada hemisfério isoladamente por meio de anestesia hemisférica unilateral (procedimento Wada[111]) ou gravações intracorticais de cada hemisfério[97] forneceram evidências de que o reconhecimento de sons é processado bilateralmente. Além disso, um estudo que instruiu pacientes com hemisférios desconectados (pacientes de cérebro dividido) a associar palavras faladas a palavras escritas apresentadas nos hemicampos direito ou esquerdo relatou vocabulário no hemisfério direito quase equivalente em tamanho ao do hemisfério esquerdo.[112] Esse reconhecimento bilateral de sons é consistente com o fato de que lesão unilateral ao córtex auditivo raramente causa déficit de compreensão auditiva (agnosia auditiva), enquanto uma segunda lesão ao hemisfério remanescente pode resultar em déficit significativo anos depois.[113][114] Finalmente, como mencionado acima, uma varredura de ressonância magnética funcional de um paciente com agnosia auditiva demonstrou ativação reduzida bilateral nos córtices auditivos anteriores,[36] e estimulação eletrocortical bilateral nessas regiões em ambos os hemisférios resultou em reconhecimento de fala prejudicado.[82]

Via dorsal auditiva

A via dorsal auditiva conecta o córtex auditivo ao lobo parietal, que por sua vez se conecta ao giro frontal inferior. Em humanos e não-humanos primatas, essa via é responsável pela localização de sons, sendo conhecida como via “onde” auditiva. Em humanos, essa via (especialmente no hemisfério esquerdo) também é responsável pela produção da fala, repetição da fala, leitura labial e pela memória de trabalho e de longo prazo fonológica.

Produção da fala

Estudos em humanos demonstraram o papel da VDA na produção da fala, especialmente na expressão vocal dos nomes de objetos. Por exemplo, em uma série de estudos em que fibras subcorticais foram diretamente estimuladas,[95] interferência no giro temporal superior posterior esquerdo (pSTG) e no lobículo parietal inferior resultou em erros na nomeação de objetos, e interferência no giro frontal inferior resultou em parada da fala. Estimulação magnética transcraniana (TMS) no pSTG e no giro frontal inferior de participantes saudáveis também produziu erros de fala e parada da fala, respectivamente.[115][116] Um estudo relatou ainda que a estimulação elétrica do lobículo parietal inferior esquerdo fez com que pacientes acreditassem ter falado quando não o fizeram, e que a estimulação do giro frontal inferior provocou movimentos inconscientes dos lábios.[117] A contribuição da VDA à articulação dos nomes de objetos pode depender do recebimento de aferências do léxico semântico do VSA, conforme um estudo de gravação intracortical que relatou ativação no MTG posterior antes da ativação na região Spt-lobículo parietal inferior quando pacientes nomeavam objetos em imagens.[118] Estudos de estimulação elétrica intracortical também relataram que interferência no MTG posterior foi correlacionada com nomeação de objetos prejudicada.[119][83]

Estudos de lesão em pacientes pós-AVC usando mapeamento sintoma-desconexão multivariado mostraram que escores mais baixos em tarefas de produção de fala estão associados a lesões e anomalias no lobículo parietal inferior esquerdo e no lobo frontal, reforçando o papel da via dorsal na produção da fala.[120]

Imitação vocal

Embora a percepção de sons seja atribuída principalmente ao VSA, a VDA associa-se a vários aspectos da percepção da fala. Por exemplo, em uma meta-análise de estudos de ressonância magnética funcional[121] em que a percepção auditiva de fonemas foi contrastada com sons semelhantes, os autores concluíram que a atenção a fonemas correlaciona-se com forte ativação na região pSTG-pSTS. Um estudo de gravação intracortical em que participantes identificaram sílabas correlacionou a audição de cada sílaba com seu padrão de ativação na pSTG.[122] O envolvimento da VDA na percepção e produção de fala foi esclarecido em estudos de imageamento funcional que compararam percepção de fala com produção de fala overt ou covert.[123][124][125] Esses estudos demonstraram que o pSTS é ativo apenas durante a percepção de fala, enquanto a área Spt é ativa tanto na percepção quanto na produção de fala. Os autores concluíram que o pSTS projeta-se para a área Spt, que converte o input auditivo em movimentos articulatórios.[126][127] Resultados semelhantes foram obtidos em um estudo em que lobos temporal e parietal foram estimulados eletricamente, relatando que a estimulação do pSTG interfere na compreensão de sentenças e a do lobículo parietal inferior interfere na vocalização dos nomes de objetos.[84] Os autores também observaram que a estimulação na área Spt e no lobículo parietal inferior induz interferência em tarefas tanto de nomeação de objetos quanto de compreensão de fala. O papel da VDA na repetição de fala é congruente com estudos de imageamento funcional que localizaram ativação em regiões da VDA durante tarefas de repetição de fala.[128][129][130] Um estudo de gravação intracortical que registrou atividade nos lobos temporal, parietal e frontal também relatou ativação em pSTG, Spt, lobículo parietal inferior e giro frontal inferior quando repetição de fala foi contrastada com percepção de fala.[131] Estudos neuropsicológicos identificaram que indivíduos com déficit de repetição de fala, mas compreensão preservada (i.e., afasia de condução), apresentam dano circunscrito à área Spt-IPL[132][133][134][135][136][137][138] ou dano às projeções que emanam dessa área e se dirigem ao lobo frontal[139][140][141][142] Estudos também relataram déficit transitório de repetição de fala em pacientes após estimulação elétrica intracortical direta nessa mesma região.[11][143][144] Estudos longitudinais com crianças correlacionaram a aprendizagem de vocabulário em idioma estrangeiro com a capacidade de repetir palavras sem sentido.[145][146]

Monitoramento da fala

Além de repetir e produzir fala, a VDA parece ter um papel no monitoramento da qualidade da fala produzida. Evidências neuroanatômicas sugerem que a VDA dispõe de conexões descendentes do giro frontal inferior para a pSTG que transmitem informações sobre a atividade motora (descargas corolárias) no aparelho vocal (boca, língua, pregas vocais). Esse feedback marca o som percebido durante a produção como autogerado e pode ser usado para ajustar o aparelho vocal para aumentar a semelhança entre o som percebido e o emitido. Evidências dessas conexões descendentes foram apresentadas por um estudo que estimulou eletricamente o giro frontal inferior durante operações cirúrgicas e relatou propagação de ativação para a região pSTG-pSTS-Spt.[147] Um estudo[148] comparou a capacidade de pacientes afásicos com danos no lobo frontal, parietal ou temporal de articular rapidamente sequências de sílabas e constatou que danos no lobo frontal interferiam na articulação de sílabas idênticas ("Bababa") e não idênticas ("Badaga"), enquanto pacientes com danos nos lobos temporal ou parietal eram prejudicados apenas na segunda tarefa, indicando déficit de monitoramento. Demonstrando o papel das conexões descendentes da VDA no monitoramento, um estudo de ressonância magnética funcional instruiu participantes a falar normalmente ou ao ouvir uma versão modificada de sua própria voz (primeiro formante atrasado) e relatou aumento de ativação na pSTG ao ouvir a voz distorcida.[149] Um estudo intracortical que contrastou percepção e repetição de fala relatou que, além da ativação no lobículo parietal inferior e giro frontal inferior, a repetição de fala é caracterizada por ativação mais forte na pSTG do que durante a percepção.[131]

Integração de fonemas com movimentos labiais

Embora a percepção de sons seja atribuída principalmente ao VSA, a VDA associa-se a vários aspectos da percepção da fala. Em uma meta-análise de estudos de ressonância magnética funcional[121] em que a percepção auditiva de fonemas foi contrastada com sons semelhantes, concluiu-se que atenção a fonemas correlaciona-se com forte ativação na região pSTG-pSTS. Um estudo intracortical correlacionou a audição de sílabas com padrões de ativação na pSTG.[150] Estudos atribuíram a integração de fonemas e seus movimentos labiais correspondentes (visemas) ao pSTS da VDA. Por exemplo, um estudo de ressonância magnética funcional[151] correlacionou ativação no pSTS com o efeito McGurk. Outro estudo demonstrou que estimulação magnética nessa área perturba o efeito McGurk.[152] A associação do pSTS com integração áudio-visual de fala também foi demonstrada em estudo que apresentou imagens de rostos e palavras faladas de qualidade variável, relatando que o pSTS seleciona o aumento combinado da clareza de rostos e palavras faladas.[153] Outro estudo de ressonância magnética funcional[154] detectou compartimentos seletivos à fala no pSTS. Em outro estudo[155] que contrastou fala audiovisual congruente com incongruente, também houve ativação no pSTS. Para revisão adicional, veja.[156] Pesquisas empíricas demonstraram que movimentos labiais visuais melhoram o processamento da fala pela via dorsal auditiva em condições de ruído. Estudos recentes[157] mostraram que regiões da via dorsal, incluindo áreas motoras frontais de fala e o giro supramarginal, apresentam representações neurais de sons da fala aprimoradas quando movimentos labiais visuais estão disponíveis.

Memória de longo prazo fonológica

Evidências indicam que os humanos possuem, além de um armazenamento de longo prazo para significados de palavras no MTG-TP do VSA (o léxico semântico), um armazenamento de longo prazo para nomes de objetos na região Spt-IPL da VDA (o léxico fonológico). Por exemplo, estudos[158][159] com pacientes lesionados no VSA (MTG) ou na VDA (IPL) relataram que lesão no MTG leva a identificação incorreta de objetos (por ex., chamar “cabra” de “ovelha”, paraphasia semântica), enquanto lesão no IPL faz com que o objeto seja corretamente identificado, mas seu nome seja pronunciado incorretamente (por ex., dizer “gof” em vez de “goat”, paraphasia fonêmica). Erros semânticos também surgem durante estimulação elétrica intracortical do MTG, e erros fonêmicos ocorrem durante estimulação do pSTG, Spt e IPL.[84][160][95] Apoio adicional veio de estudo de MEG que localizou atividade no IPL durante a aprendizagem e recordação de nomes de objetos.[161] Um estudo de interferência magnética no IPL mostrou que participantes respondiam corretamente a características de objetos, mas eram prejudicados ao determinar se o nome continha duas ou três sílabas.[162] Recuperação de anomia correlacionou-se com mudanças na ativação do IPL em estudo de MEG.[163] Estudos comparativos mostraram que bilíngues possuem maior densidade cortical no IPL, mas não no MTG, em relação a monolíngues, consistente com a existência de um léxico fonológico maior em bilíngues.[164][165] A densidade cortical no IPL de monolíngues também correlaciona-se com tamanho do vocabulário.[166][167] A dissociação funcional do VSA e da VDA em tarefas de nomeação é apoiada por evidências de leitura mostrando que erros semânticos correlacionam-se com MTG comprometido e erros fonêmicos com IPL comprometido. A análise semântica de texto foi vinculada ao giro temporal inferior e MTG, e a análise fonológica de texto ao pSTG-Spt-IPL.[168][169][170]

Memória de trabalho fonológica

Memória de trabalho é frequentemente definida como a ativação temporária das representações armazenadas em longo prazo usadas para a fala (representações fonológicas). Esse compartilhamento de recursos entre memória de trabalho e fala é evidenciado pelo achado[171][172] de que falar durante a repetição reduz significativamente o número de itens lembráveis (supressão articulatória). O envolvimento do léxico fonológico na memória de trabalho também é evidenciado pela tendência de mais erros ao recordar listas de palavras fonologicamente similares em comparação a dissimilares (efeito de similaridade fonológica).[171] Estudos mostraram que erros de fala durante a leitura são semelhantes aos cometidos ao recordar palavras fonologicamente similares da memória de trabalho.[173] Pacientes com lesão no IPL exibem erros de produção de fala e memória de trabalho prejudicada.[174][175][176][177] A visão de que a memória de trabalho verbal resulta da ativação temporária de representações fonológicas na VDA é compatível com modelos que descrevem a memória de trabalho como a combinação da atenção ativa e da ativação temporária de representações na memória de longo prazo.[172][178][179][180] Argumenta-se que o papel da VDA no ensaio de listas de palavras explica sua ativação durante a compreensão de sentenças.[181] Para revisão sobre o papel da VDA na memória de trabalho, veja.[182] Estudos mostraram que o desempenho em tarefas de memória de trabalho fonológica correlaciona-se com propriedades do ramo dorsal esquerdo do fascículo arqueado, que conecta regiões temporais posteriores de linguagem a áreas de atenção no giro frontal médio. O fascículo arqueado é uma via de substância branca com dois ramos: um ventral ligando a área de Wernicke à área de Broca e um dorsal ligando a região temporal posterior ao giro frontal médio; este último é crucial para processos de memória de trabalho fonológica.[183]

Teorias linguísticas

A pesquisa em processamento de linguagem fundamenta teorias de linguagem. A principal questão teórica é se estruturas linguísticas derivam de estruturas cerebrais ou vice-versa. Modelos externalistas, como o estruturalismo de Ferdinand de Saussure, defendem que a linguagem, como fenômeno social, é externa ao cérebro. O indivíduo recebe o sistema linguístico do ambiente, e a língua molda seu cérebro.[184]

Essa ideia é contradita por modelos internalistas, incluindo a gramática gerativa transformacional de Noam Chomsky, a linguística cognitiva de George Lakoff e a hipótese de eficiência de John A. Hawkins. Segundo Chomsky, a linguagem é adquirida a partir de uma estrutura cerebral inata, independentemente do significado.[185] Lakoff argumenta que a linguagem emerge dos sistemas sensoriais.[186] Hawkins hipotetiza que padrões prevalentes entre línguas baseiam-se nas preferências naturais de processamento do cérebro.[187]

Modelos inspirados pela memética de Richard Dawkins, como a gramática de construções e a linguística baseada no uso, propõem um modelo bidirecional em que o cérebro molda a linguagem e a linguagem molda o cérebro.[188][189]

Evidências de estudos de neuroimagem apontam para a posição externalista. Estudos de potencial relacionado a evento (ERP) sugerem que o processamento de linguagem baseia-se na interação de sintaxe e semântica, sem apoio a estruturas gramaticais inatas.[190][191] Estudos de ressonância magnética sugerem que características estruturais da primeira língua moldam o conectoma de processamento do cérebro.[192] Pesquisas de processamento não encontraram apoio à ideia inversa de que estruturas sintáticas refletem as preferências naturais de processamento do cérebro entre línguas.[193]

A evolução da linguagem

O fluxo dorsal auditivo também possui funções não relacionadas à linguagem, como localização de sons[194][195][196][197][198] e orientação dos movimentos oculares.[199][200] Estudos recentes também indicam um papel do fluxo dorsal auditivo na localização de membros da família/tribo, pois um estudo[201] que registrou atividade no córtex de um paciente epiléptico relatou que a região pSTG, mas não a aSTG, é seletiva à presença de novos falantes. Um estudo por fMRI[202] com fetos no terceiro trimestre também demonstrou que a área Spt é mais seletiva à fala feminina do que a tons puros, e que uma subseção de Spt é seletiva à fala da própria mãe em contraste com vozes femininas desconhecidas.

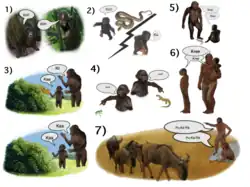

Atualmente, desconhece-se por que tantas funções são atribuídas ao fluxo dorsal auditivo. Uma tentativa de unificar essas funções em um único arcabouço foi realizada no modelo 'De onde para o quê' da evolução da linguagem.[203][204] De acordo com esse modelo, cada função do fluxo dorsal auditivo indica uma fase intermediária diferente na evolução da linguagem. Os papéis da localização de sons e da integração de localização sonora com vozes e objetos auditivos são interpretados como evidência de que a origem da fala se dá pela troca de chamadas de contato (chamadas usadas para reportar localização em casos de separação) entre mães e filhotes. O papel do fluxo dorsal auditivo na percepção e produção de entonações é interpretado como evidência de que a fala começou modificando as chamadas de contato com entonações, possivelmente para distinguir chamadas de alarme de chamadas seguras. O papel do fluxo dorsal auditivo na codificação dos nomes de objetos (memória de longo prazo fonológica) é interpretado como evidência da transição gradual de modificar chamadas com entonações para o controle vocal completo. O papel do fluxo dorsal auditivo na integração de movimentos labiais com fonemas e na repetição de fala é interpretado como evidência de que as palavras faladas foram aprendidas por bebês imitando as vocalizações dos pais, inicialmente imitando os movimentos dos lábios. O papel do fluxo dorsal auditivo na memória de trabalho fonológica é interpretado como evidência de que as palavras aprendidas por imitação permaneciam ativas no fluxo dorsal auditivo mesmo quando não eram pronunciadas. Isso resultou em indivíduos capazes de ensaiar uma lista de vocalizações, o que possibilitou a produção de palavras com várias sílabas. Desenvolvimentos posteriores no fluxo dorsal auditivo permitiram o ensaio de listas de palavras, fornecendo a infraestrutura para a comunicação em sentenças.

Linguagem de sinais no cérebro

Pesquisas neurocientíficas forneceram uma compreensão científica de como a linguagem de sinais é processada no cérebro.[205] Por meio de análises de lesões e neuroimagem, neurocientistas descobriram que, seja linguagem falada ou de sinais, os cérebros humanos processam a linguagem de modo semelhante em termos das áreas envolvidas no processamento.[205] Análises de lesões são usadas para examinar as consequências de danos em regiões cerebrais específicas envolvidas na linguagem, enquanto a neuroimagem explora as regiões ativadas no processamento da linguagem.[205]

Hipóteses anteriores sugeriam que danos à área de Broca ou à área de Wernicke não afetavam a percepção da língua de sinais; no entanto, esse não é o caso. Estudos mostraram que danos a essas áreas resultam em erros e/ou repetições na línguagem de sinais, de forma similar ao que ocorre na linguagem falada.[205] Em ambos os tipos de linguagem, os danos ocorrem predominantemente no hemisfério esquerdo do cérebro, em vez do direito, área geralmente associada às artes.

Observam-se padrões claros na utilização e processamento da linguagem. Na língua de sinais, a área de Broca é ativada, enquanto o processamento emprega a área de Wernicke de maneira semelhante ao da fala.[205]

Existem outras hipóteses sobre a lateralização dos dois hemisférios. Especificamente, pensava-se que o hemisfério direito contribuía para a comunicação global de uma linguagem, enquanto o hemisfério esquerdo seria dominante na geração local da linguagem.[206] Por meio de pesquisas em afasias, observou-se que pacientes com lesão no hemisfério direito (RHD) apresentavam dificuldade em manter a parte espacial dos sinais, confundindo sinais semelhantes em locais diferentes, o que é necessário para uma comunicação adequada.[206] Já pacientes com lesão no hemisfério esquerdo (LHD) apresentaram resultados semelhantes aos de pacientes ouvintes com afasia. Além disso, outros estudos enfatizam que a linguagem de sinais é processada bilateralmente, mas são necessárias mais pesquisas para confirmar essa hipótese.[206]

Escrita no cérebro

Existe um corpo de pesquisa relativamente pequeno sobre a neurologia da leitura e da escrita.[207] A maioria dos estudos realizados trata mais da leitura do que da escrita ou da ortografia, e a maioria focaliza exclusivamente a língua inglesa.[208] A ortografia do inglês é menos transparente do que a de outras línguas que usam o alfabeto latino.[207] Outra dificuldade é que alguns estudos focam na ortografia de palavras em inglês e omitem os poucos caracteres logográficos presentes no sistema de escrita.[207]

Em termos de ortografia, as palavras em inglês podem ser divididas em três categorias – regulares, irregulares e “palavras nonce” ou “não-palavras”. Palavras regulares são aquelas em que há uma correspondência regular de um para um entre grafema e fonema na escrita. Palavras irregulares são aquelas em que tal correspondência não existe. Não-palavras são aquelas que exibem a ortografia esperada de palavras regulares, mas não têm significado, como palavras nonce e onomatopeias.[207]

Uma questão no estudo cognitivo e neurológico da leitura e da escrita em inglês é se um modelo de via única ou um modelo de vias duplas descreve melhor como falantes alfabetizados são capazes de ler e escrever todas as três categorias de palavras em inglês de acordo com padrões ortográficos aceitos. Modelos de via única postulam que a memória lexical armazena todas as grafias das palavras para recuperação em um único processo. Modelos de vias duplas postulam que a memória lexical é empregada para processar palavras irregulares e regulares de alta frequência, enquanto palavras regulares de baixa frequência e não-palavras são processadas usando um conjunto sublexical de regras fonológicas.[207]

O modelo de via única para a leitura recebeu apoio em estudos de modelagem computacional, que sugerem que os leitores identificam palavras por suas semelhanças ortográficas com palavras fonologicamente semelhantes.[207] No entanto, estudos cognitivos e de lesão tendem a favorecer o modelo de vias duplas. Estudos cognitivos de ortografia em crianças e adultos sugerem que os ortógrafos empregam regras fonológicas na escrita de palavras regulares e não-palavras, enquanto a memória lexical é acessada para escrever palavras irregulares e palavras de alta frequência de todos os tipos.[207] De modo semelhante, estudos de lesão indicam que a memória lexical é usada para armazenar palavras irregulares e certas palavras regulares, enquanto regras fonológicas são usadas para soletrar não-palavras.[207]

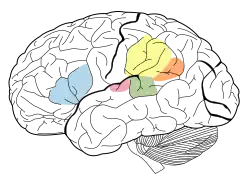

Mais recentemente, estudos de neuroimagem utilizando tomografia por emissão de pósitrons e fMRI sugeriram um modelo equilibrado em que a leitura de todos os tipos de palavras começa na área de forma visual de palavras, mas subsequentemente se divide em rotas diferentes dependendo de o acesso à memória lexical ou a informação semântica ser necessário (o que seria esperado em palavras irregulares sob um modelo de vias duplas).[207] Um estudo de fMRI de 2007 descobriu que sujeitos solicitados a produzir palavras regulares em uma tarefa de ortografia exibiram maior ativação no STG, área usada para processamento fonológico, enquanto a escrita de palavras irregulares gerou maior ativação em áreas usadas para memória lexical e processamento semântico, como o IFG e o SMG e em ambos os hemisférios do MTG.[207] A escrita de não-palavras acessou membros de ambas as vias, como o STG e o MTG bilateral e o ITG.[207] De forma significativa, constatou-se que a escrita também induz ativação em áreas como o gírus fusiforme e o SMG que são importantes na leitura, sugerindo que um caminho similar é usado para leitura e escrita.[207]

Ver também

- Linguagem de sinais

- Fonologia

- Área de Brodmann

- Audiologia computacional

- Ciência cognitiva

- Dispraxia verbal do desenvolvimento

- FOXP2

- Neurobiologia

- Neurolinguística

- Neuropsicologia

- Neurociência

- Origem da linguagem

Referências

- ↑ Seidenberg MS, Petitto LA (1987). «Communication, symbolic communication, and language: Comment on Savage-Rumbaugh, McDonald, Sevcik, Hopkins, and Rupert (1986)». Journal of Experimental Psychology: General. 116 (3): 279–287. doi:10.1037/0096-3445.116.3.279

- ↑ a b Geschwind N (junho–falhou de undefined). «Disconnexion syndromes in animals and man. I». review. Brain. 88 (2): 237–94. PMID 5318481. doi:10.1093/brain/88.2.237

Verifique data em:

Verifique data em: |data=(ajuda) - ↑ Hickok G, Poeppel D (maio 2007). «The cortical organization of speech processing». review. Nature Reviews. Neuroscience. 8 (5): 393–402. PMID 17431404. doi:10.1038/nrn2113

- ↑ Gow DW (junho–falhou de undefined). «The cortical organization of lexical knowledge: a dual lexicon model of spoken language processing». review. Brain and Language. 121 (3): 273–88. PMC 3348354

. PMID 22498237. doi:10.1016/j.bandl.2012.03.005 Verifique data em:

. PMID 22498237. doi:10.1016/j.bandl.2012.03.005 Verifique data em: |data=(ajuda) - ↑ Poliva O (20 de setembro de 2017). «From where to what: a neuroanatomically based evolutionary model of the emergence of speech in humans». review. F1000Research. 4. 67 páginas. PMC 5600004

. PMID 28928931. doi:10.12688/f1000research.6175.3

. PMID 28928931. doi:10.12688/f1000research.6175.3

Material copiado desta fonte, disponível sob a Creative Commons Atribuição 4.0 Internacional.

Material copiado desta fonte, disponível sob a Creative Commons Atribuição 4.0 Internacional.

- ↑ Poliva O (2016). «From Mimicry to Language: A Neuroanatomically Based Evolutionary Model of the Emergence of Vocal Language». review. Frontiers in Neuroscience. 10. 307 páginas. PMC 4928493

. PMID 27445676. doi:10.3389/fnins.2016.00307

. PMID 27445676. doi:10.3389/fnins.2016.00307

Material copiado desta fonte, disponível sob a Creative Commons Atribuição 4.0 Internacional.

Material copiado desta fonte, disponível sob a Creative Commons Atribuição 4.0 Internacional.

- ↑ Pickles JO (2015). «Chapter 1: Auditory pathways: anatomy and physiology». In: Aminoff MJ, Boller F, Swaab DF. Handbook of Clinical Neurology. review. 129. [S.l.: s.n.] pp. 3–25. ISBN 978-0-444-62630-1. PMID 25726260. doi:10.1016/B978-0-444-62630-1.00001-9

- ↑ Lichteim L (1 de janeiro de 1885). «On Aphasia». Brain. 7 (4): 433–484. doi:10.1093/brain/7.4.433. hdl:11858/00-001M-0000-002C-5780-B

- ↑ Wernicke C (1974). Der aphasische Symptomenkomplex. [S.l.]: Springer Berlin Heidelberg. pp. 1–70. ISBN 978-3-540-06905-8

- ↑ Aboitiz F, García VR (dezembro 1997). «The evolutionary origin of the language areas in the human brain. A neuroanatomical perspective». Brain Research. Brain Research Reviews. 25 (3): 381–96. PMID 9495565. doi:10.1016/s0165-0173(97)00053-2

- ↑ a b Anderson JM, Gilmore R, Roper S, Crosson B, Bauer RM, Nadeau S, Beversdorf DQ, Cibula J, Rogish M, Kortencamp S, Hughes JD, Gonzalez Rothi LJ, Heilman KM (outubro 1999). «Conduction aphasia and the arcuate fasciculus: A reexamination of the Wernicke–Geschwind model». Brain and Language. 70 (1): 1–12. PMID 10534369. doi:10.1006/brln.1999.2135

- ↑ DeWitt I, Rauschecker JP (novembro 2013). «Wernicke's area revisited: parallel streams and word processing». Brain and Language. 127 (2): 181–91. PMC 4098851

. PMID 24404576. doi:10.1016/j.bandl.2013.09.014

. PMID 24404576. doi:10.1016/j.bandl.2013.09.014

- ↑ Dronkers NF (janeiro 2000). «The pursuit of brain-language relationships». Brain and Language. 71 (1): 59–61. PMID 10716807. doi:10.1006/brln.1999.2212

- ↑ a b c Dronkers NF, Wilkins DP, Van Valin RD, Redfern BB, Jaeger JJ (maio 2004). «Lesion analysis of the brain areas involved in language comprehension». Cognition. 92 (1–2): 145–77. PMID 15037129. doi:10.1016/j.cognition.2003.11.002. hdl:11858/00-001M-0000-0012-6912-A

- ↑ Mesulam MM, Thompson CK, Weintraub S, Rogalski EJ (agosto 2015). «The Wernicke conundrum and the anatomy of language comprehension in primary progressive aphasia». Brain. 138 (Pt 8): 2423–37. PMC 4805066

. PMID 26112340. doi:10.1093/brain/awv154

. PMID 26112340. doi:10.1093/brain/awv154

- ↑ Poeppel D, Emmorey K, Hickok G, Pylkkänen L (outubro 2012). «Towards a new neurobiology of language». The Journal of Neuroscience. 32 (41): 14125–31. PMC 3495005

. PMID 23055482. doi:10.1523/jneurosci.3244-12.2012 Erro no estilo Vancouver: wikilink (ajuda)

. PMID 23055482. doi:10.1523/jneurosci.3244-12.2012 Erro no estilo Vancouver: wikilink (ajuda)

- ↑ Vignolo LA, Boccardi E, Caverni L (março 1986). «Unexpected CT-scan findings in global aphasia». Cortex; A Journal Devoted to the Study of the Nervous System and Behavior. 22 (1): 55–69. PMID 2423296. doi:10.1016/s0010-9452(86)80032-6

- ↑ a b Bendor D, Wang X (agosto 2006). «Cortical representations of pitch in monkeys and humans». Current Opinion in Neurobiology. 16 (4): 391–9. PMC 4325365

. PMID 16842992. doi:10.1016/j.conb.2006.07.001

. PMID 16842992. doi:10.1016/j.conb.2006.07.001

- ↑ a b Rauschecker JP, Tian B, Hauser M (abril 1995). «Processing of complex sounds in the macaque nonprimary auditory cortex». Science. 268 (5207): 111–4. Bibcode:1995Sci...268..111R. PMID 7701330. doi:10.1126/science.7701330

- ↑ a b de la Mothe LA, Blumell S, Kajikawa Y, Hackett TA (maio 2006). «Cortical connections of the auditory cortex in marmoset monkeys: core and medial belt regions». The Journal of Comparative Neurology. 496 (1): 27–71. PMID 16528722. doi:10.1002/cne.20923

- ↑ de la Mothe LA, Blumell S, Kajikawa Y, Hackett TA (maio 2012). «Cortical connections of auditory cortex in marmoset monkeys: lateral belt and parabelt regions». Anatomical Record. 295 (5): 800–21. PMC 3379817

. PMID 22461313. doi:10.1002/ar.22451

. PMID 22461313. doi:10.1002/ar.22451

- ↑ Kaas JH, Hackett TA (outubro 2000). «Subdivisions of auditory cortex and processing streams in primates». Proceedings of the National Academy of Sciences of the United States of America. 97 (22): 11793–9. Bibcode:2000PNAS...9711793K. PMC 34351

. PMID 11050211. doi:10.1073/pnas.97.22.11793

. PMID 11050211. doi:10.1073/pnas.97.22.11793

- ↑ Petkov CI, Kayser C, Augath M, Logothetis NK (julho 2006). «Functional imaging reveals numerous fields in the monkey auditory cortex». PLOS Biology. 4 (7): e215. PMC 1479693

. PMID 16774452. doi:10.1371/journal.pbio.0040215

. PMID 16774452. doi:10.1371/journal.pbio.0040215

- ↑ Morel A, Garraghty PE, Kaas JH (setembro 1993). «Tonotopic organization, architectonic fields, and connections of auditory cortex in macaque monkeys». The Journal of Comparative Neurology. 335 (3): 437–59. PMID 7693772. doi:10.1002/cne.903350312

- ↑ Rauschecker JP, Tian B (outubro 2000). «Mechanisms and streams for processing of "what" and "where" in auditory cortex». Proceedings of the National Academy of Sciences of the United States of America. 97 (22): 11800–6. Bibcode:2000PNAS...9711800R. PMC 34352

. PMID 11050212. doi:10.1073/pnas.97.22.11800

. PMID 11050212. doi:10.1073/pnas.97.22.11800

- ↑ Rauschecker JP, Tian B, Pons T, Mishkin M (maio 1997). «Serial and parallel processing in rhesus monkey auditory cortex». The Journal of Comparative Neurology. 382 (1): 89–103. PMID 9136813. doi:10.1002/(sici)1096-9861(19970526)382:1<89::aid-cne6>3.3.co;2-y

- ↑ Sweet RA, Dorph-Petersen KA, Lewis DA (outubro 2005). «Mapping auditory core, lateral belt, and parabelt cortices in the human superior temporal gyrus». The Journal of Comparative Neurology. 491 (3): 270–89. PMID 16134138. doi:10.1002/cne.20702

- ↑ Wallace MN, Johnston PW, Palmer AR (abril 2002). «Histochemical identification of cortical areas in the auditory region of the human brain». Experimental Brain Research. 143 (4): 499–508. PMID 11914796. doi:10.1007/s00221-002-1014-z

- ↑ Da Costa S, van der Zwaag W, Marques JP, Frackowiak RS, Clarke S, Saenz M (outubro 2011). «Human primary auditory cortex follows the shape of Heschl's gyrus». The Journal of Neuroscience. 31 (40): 14067–75. PMC 6623669

. PMID 21976491. doi:10.1523/jneurosci.2000-11.2011

. PMID 21976491. doi:10.1523/jneurosci.2000-11.2011

- ↑ Humphries C, Liebenthal E, Binder JR (abril 2010). «Tonotopic organization of human auditory cortex». NeuroImage. 50 (3): 1202–11. PMC 2830355

. PMID 20096790. doi:10.1016/j.neuroimage.2010.01.046

. PMID 20096790. doi:10.1016/j.neuroimage.2010.01.046

- ↑ Langers DR, van Dijk P (setembro 2012). «Mapping the tonotopic organization in human auditory cortex with minimally salient acoustic stimulation». Cerebral Cortex. 22 (9): 2024–38. PMC 3412441

. PMID 21980020. doi:10.1093/cercor/bhr282

. PMID 21980020. doi:10.1093/cercor/bhr282

- ↑ Striem-Amit E, Hertz U, Amedi A (março 2011). «Extensive cochleotopic mapping of human auditory cortical fields obtained with phase-encoding fMRI». PLOS ONE. 6 (3): e17832. Bibcode:2011PLoSO...617832S. PMC 3063163

. PMID 21448274. doi:10.1371/journal.pone.0017832

. PMID 21448274. doi:10.1371/journal.pone.0017832

- ↑ Woods DL, Herron TJ, Cate AD, Yund EW, Stecker GC, Rinne T, Kang X (2010). «Functional properties of human auditory cortical fields». Frontiers in Systems Neuroscience. 4. 155 páginas. PMC 3001989

. PMID 21160558. doi:10.3389/fnsys.2010.00155

. PMID 21160558. doi:10.3389/fnsys.2010.00155

- ↑ Gourévitch B, Le Bouquin Jeannès R, Faucon G, Liégeois-Chauvel C (março 2008). «Temporal envelope processing in the human auditory cortex: response and interconnections of auditory cortical areas» (PDF). Hearing Research. 237 (1–2): 1–18. PMID 18255243. doi:10.1016/j.heares.2007.12.003

- ↑ Guéguin M, Le Bouquin-Jeannès R, Faucon G, Chauvel P, Liégeois-Chauvel C (February 2007). «Evidence of functional connectivity between auditory cortical areas revealed by amplitude modulation sound processing». Cerebral Cortex. 17 (2): 304–13. PMC 2111045

. PMID 16514106. doi:10.1093/cercor/bhj148 Verifique data em:

. PMID 16514106. doi:10.1093/cercor/bhj148 Verifique data em: |data=(ajuda) - ↑ a b c Poliva O, Bestelmeyer PE, Hall M, Bultitude JH, Koller K, Rafal RD (setembro 2015). «Functional Mapping of the Human Auditory Cortex: fMRI Investigation of a Patient with Auditory Agnosia from Trauma to the Inferior Colliculus» (PDF). Cognitive and Behavioral Neurology. 28 (3): 160–80. PMID 26413744. doi:10.1097/wnn.0000000000000072

- ↑ Chang EF, Edwards E, Nagarajan SS, Fogelson N, Dalal SS, Canolty RT, Kirsch HE, Barbaro NM, Knight RT (junho–falhou de undefined). «Cortical spatio-temporal dynamics underlying phonological target detection in humans». Journal of Cognitive Neuroscience. 23 (6): 1437–46. PMC 3895406

. PMID 20465359. doi:10.1162/jocn.2010.21466 Verifique data em:

. PMID 20465359. doi:10.1162/jocn.2010.21466 Verifique data em: |data=(ajuda) - ↑ Muñoz M, Mishkin M, Saunders RC (setembro 2009). «Resection of the medial temporal lobe disconnects the rostral superior temporal gyrus from some of its projection targets in the frontal lobe and thalamus». Cerebral Cortex. 19 (9): 2114–30. PMC 2722427

. PMID 19150921. doi:10.1093/cercor/bhn236

. PMID 19150921. doi:10.1093/cercor/bhn236

- ↑ a b Romanski LM, Bates JF, Goldman-Rakic PS (janeiro 1999). «Auditory belt and parabelt projections to the prefrontal cortex in the rhesus monkey». The Journal of Comparative Neurology. 403 (2): 141–57. PMID 9886040. doi:10.1002/(sici)1096-9861(19990111)403:2<141::aid-cne1>3.0.co;2-v

- ↑ Tanaka D (junho–falhou de undefined). «Thalamic projections of the dorsomedial prefrontal cortex in the rhesus monkey (Macaca mulatta)». Brain Research. 110 (1): 21–38. PMID 819108. doi:10.1016/0006-8993(76)90206-7 Verifique data em:

|data=(ajuda) - ↑ a b Perrodin C, Kayser C, Logothetis NK, Petkov CI (agosto 2011). «Voice cells in the primate temporal lobe». Current Biology. 21 (16): 1408–15. Bibcode:2011CBio...21.1408P. PMC 3398143

. PMID 21835625. doi:10.1016/j.cub.2011.07.028

. PMID 21835625. doi:10.1016/j.cub.2011.07.028

- ↑ a b Petkov CI, Kayser C, Steudel T, Whittingstall K, Augath M, Logothetis NK (março 2008). «A voice region in the monkey brain». Nature Neuroscience. 11 (3): 367–74. PMID 18264095. doi:10.1038/nn2043

- ↑ a b Poremba A, Malloy M, Saunders RC, Carson RE, Herscovitch P, Mishkin M (janeiro 2004). «Species-specific calls evoke asymmetric activity in the monkey's temporal poles». Nature. 427 (6973): 448–51. Bibcode:2004Natur.427..448P. PMID 14749833. doi:10.1038/nature02268

- ↑ Romanski LM, Averbeck BB, Diltz M (February 2005). «Neural representation of vocalizations in the primate ventrolateral prefrontal cortex». Journal of Neurophysiology. 93 (2): 734–47. PMID 15371495. doi:10.1152/jn.00675.2004 Verifique data em:

|data=(ajuda) - ↑ Russ BE, Ackelson AL, Baker AE, Cohen YE (janeiro 2008). «Coding of auditory-stimulus identity in the auditory non-spatial processing stream». Journal of Neurophysiology. 99 (1): 87–95. PMC 4091985

. PMID 18003874. doi:10.1152/jn.01069.2007

. PMID 18003874. doi:10.1152/jn.01069.2007

- ↑ a b Tsunada J, Lee JH, Cohen YE (junho–falhou de undefined). «Representation of speech categories in the primate auditory cortex». Journal of Neurophysiology. 105 (6): 2634–46. PMC 3118748

. PMID 21346209. doi:10.1152/jn.00037.2011 Verifique data em:

. PMID 21346209. doi:10.1152/jn.00037.2011 Verifique data em: |data=(ajuda) - ↑ Cusick CG, Seltzer B, Cola M, Griggs E (setembro 1995). «Chemoarchitectonics and corticocortical terminations within the superior temporal sulcus of the rhesus monkey: evidence for subdivisions of superior temporal polysensory cortex». The Journal of Comparative Neurology. 360 (3): 513–35. PMID 8543656. doi:10.1002/cne.903600312

- ↑ Cohen YE, Russ BE, Gifford GW, Kiringoda R, MacLean KA (dezembro 2004). «Selectivity for the spatial and nonspatial attributes of auditory stimuli in the ventrolateral prefrontal cortex». The Journal of Neuroscience. 24 (50): 11307–16. PMC 6730358

. PMID 15601937. doi:10.1523/jneurosci.3935-04.2004

. PMID 15601937. doi:10.1523/jneurosci.3935-04.2004

- ↑ Deacon TW (February 1992). «Cortical connections of the inferior arcuate sulcus cortex in the macaque brain». Brain Research. 573 (1): 8–26. ISSN 0006-8993. PMID 1374284. doi:10.1016/0006-8993(92)90109-m Verifique data em:

|data=(ajuda) - ↑ Lewis JW, Van Essen DC (dezembro 2000). «Corticocortical connections of visual, sensorimotor, and multimodal processing areas in the parietal lobe of the macaque monkey». The Journal of Comparative Neurology. 428 (1): 112–37. PMID 11058227. doi:10.1002/1096-9861(20001204)428:1<112::aid-cne8>3.0.co;2-9

- ↑ Roberts AC, Tomic DL, Parkinson CH, Roeling TA, Cutter DJ, Robbins TW, Everitt BJ (maio 2007). «Forebrain connectivity of the prefrontal cortex in the marmoset monkey (Callithrix jacchus): an anterograde and retrograde tract-tracing study». The Journal of Comparative Neurology. 502 (1): 86–112. PMID 17335041. doi:10.1002/cne.21300

- ↑ a b Schmahmann JD, Pandya DN, Wang R, Dai G, D'Arceuil HE, de Crespigny AJ, Wedeen VJ (março 2007). «Association fibre pathways of the brain: parallel observations from diffusion spectrum imaging and autoradiography». Brain. 130 (Pt 3): 630–53. PMID 17293361. doi:10.1093/brain/awl359

- ↑ Seltzer B, Pandya DN (julho 1984). «Further observations on parieto-temporal connections in the rhesus monkey». Experimental Brain Research. 55 (2): 301–12. PMID 6745368. doi:10.1007/bf00237280

- ↑ Catani M, Jones DK, ffytche DH (janeiro 2005). «Perisylvian language networks of the human brain». Annals of Neurology. 57 (1): 8–16. PMID 15597383. doi:10.1002/ana.20319

- ↑ Frey S, Campbell JS, Pike GB, Petrides M (novembro 2008). «Dissociating the human language pathways with high angular resolution diffusion fiber tractography». The Journal of Neuroscience. 28 (45): 11435–44. PMC 6671318

. PMID 18987180. doi:10.1523/jneurosci.2388-08.2008

. PMID 18987180. doi:10.1523/jneurosci.2388-08.2008

- ↑ Makris N, Papadimitriou GM, Kaiser JR, Sorg S, Kennedy DN, Pandya DN (abril 2009). «Delineation of the middle longitudinal fascicle in humans: a quantitative, in vivo, DT-MRI study». Cerebral Cortex. 19 (4): 777–85. PMC 2651473

. PMID 18669591. doi:10.1093/cercor/bhn124

. PMID 18669591. doi:10.1093/cercor/bhn124

- ↑ Menjot de Champfleur N, Lima Maldonado I, Moritz-Gasser S, Machi P, Le Bars E, Bonafé A, Duffau H (janeiro 2013). «Middle longitudinal fasciculus delineation within language pathways: a diffusion tensor imaging study in human». European Journal of Radiology. 82 (1): 151–7. PMID 23084876. doi:10.1016/j.ejrad.2012.05.034

- ↑ Turken AU, Dronkers NF (2011). «The neural architecture of the language comprehension network: converging evidence from lesion and connectivity analyses». Frontiers in Systems Neuroscience. 5. 1 páginas. PMC 3039157

. PMID 21347218. doi:10.3389/fnsys.2011.00001

. PMID 21347218. doi:10.3389/fnsys.2011.00001

- ↑ Saur D, Kreher BW, Schnell S, Kümmerer D, Kellmeyer P, Vry MS, Umarova R, Musso M, Glauche V, Abel S, Huber W, Rijntjes M, Hennig J, Weiller C (novembro 2008). «Ventral and dorsal pathways for language». Proceedings of the National Academy of Sciences of the United States of America. 105 (46): 18035–40. Bibcode:2008PNAS..10518035S. PMC 2584675

. PMID 19004769. doi:10.1073/pnas.0805234105

. PMID 19004769. doi:10.1073/pnas.0805234105

- ↑ Yin P, Mishkin M, Sutter M, Fritz JB (dezembro 2008). «Early stages of melody processing: stimulus-sequence and task-dependent neuronal activity in monkey auditory cortical fields A1 and R». Journal of Neurophysiology. 100 (6): 3009–29. PMC 2604844

. PMID 18842950. doi:10.1152/jn.00828.2007

. PMID 18842950. doi:10.1152/jn.00828.2007

- ↑ Steinschneider M, Volkov IO, Fishman YI, Oya H, Arezzo JC, Howard MA (February 2005). «Intracortical responses in human and monkey primary auditory cortex support a temporal processing mechanism for encoding of the voice onset time phonetic parameter». Cerebral Cortex. 15 (2): 170–86. PMID 15238437. doi:10.1093/cercor/bhh120

Verifique data em:

Verifique data em: |data=(ajuda) - ↑ Russ BE, Ackelson AL, Baker AE, Cohen YE (janeiro 2008). «Coding of auditory-stimulus identity in the auditory non-spatial processing stream». Journal of Neurophysiology. 99 (1): 87–95. PMC 4091985

. PMID 18003874. doi:10.1152/jn.01069.2007

. PMID 18003874. doi:10.1152/jn.01069.2007

- ↑ Joly O, Pallier C, Ramus F, Pressnitzer D, Vanduffel W, Orban GA (setembro 2012). «Processing of vocalizations in humans and monkeys: a comparative fMRI study» (PDF). NeuroImage. 62 (3): 1376–89. PMID 22659478. doi:10.1016/j.neuroimage.2012.05.070

- ↑ Petkov CI, Kayser C, Steudel T, Whittingstall K, Augath M, Logothetis NK (março 2008). «A voice region in the monkey brain». Nature Neuroscience. 11 (3): 367–74. PMID 18264095. doi:10.1038/nn2043

- ↑ Scheich H, Baumgart F, Gaschler-Markefski B, Tegeler C, Tempelmann C, Heinze HJ, Schindler F, Stiller D (February 1998). «Functional magnetic resonance imaging of a human auditory cortex area involved in foreground-background decomposition». The European Journal of Neuroscience. 10 (2): 803–9. PMID 9749748. doi:10.1046/j.1460-9568.1998.00086.x Verifique data em:

|data=(ajuda) - ↑ Zatorre RJ, Bouffard M, Belin P (abril 2004). «Sensitivity to auditory object features in human temporal neocortex». The Journal of Neuroscience. 24 (14): 3637–42. PMC 6729744

. PMID 15071112. doi:10.1523/jneurosci.5458-03.2004

. PMID 15071112. doi:10.1523/jneurosci.5458-03.2004

- ↑ a b Binder JR, Desai RH, Graves WW, Conant LL (dezembro 2009). «Where is the semantic system? A critical review and meta-analysis of 120 functional neuroimaging studies». Cerebral Cortex. 19 (12): 2767–96. PMC 2774390

. PMID 19329570. doi:10.1093/cercor/bhp055

. PMID 19329570. doi:10.1093/cercor/bhp055

- ↑ Davis MH, Johnsrude IS (abril 2003). «Hierarchical processing in spoken language comprehension». The Journal of Neuroscience. 23 (8): 3423–31. PMC 6742313

. PMID 12716950. doi:10.1523/jneurosci.23-08-03423.2003

. PMID 12716950. doi:10.1523/jneurosci.23-08-03423.2003

- ↑ Liebenthal E, Binder JR, Spitzer SM, Possing ET, Medler DA (outubro 2005). «Neural substrates of phonemic perception». Cerebral Cortex. 15 (10): 1621–31. PMID 15703256. doi:10.1093/cercor/bhi040

- ↑ Narain C, Scott SK, Wise RJ, Rosen S, Leff A, Iversen SD, Matthews PM (dezembro 2003). «Defining a left-lateralized response specific to intelligible speech using fMRI». Cerebral Cortex. 13 (12): 1362–8. PMID 14615301. doi:10.1093/cercor/bhg083

- ↑ Obleser J, Boecker H, Drzezga A, Haslinger B, Hennenlotter A, Roettinger M, Eulitz C, Rauschecker JP (julho 2006). «Vowel sound extraction in anterior superior temporal cortex». Human Brain Mapping. 27 (7): 562–71. PMC 6871493

. PMID 16281283. doi:10.1002/hbm.20201

. PMID 16281283. doi:10.1002/hbm.20201

- ↑ Obleser J, Zimmermann J, Van Meter J, Rauschecker JP (outubro 2007). «Multiple stages of auditory speech perception reflected in event-related FMRI». Cerebral Cortex. 17 (10): 2251–7. PMID 17150986. doi:10.1093/cercor/bhl133

- ↑ Scott SK, Blank CC, Rosen S, Wise RJ (dezembro 2000). «Identification of a pathway for intelligible speech in the left temporal lobe». Brain. 123 (12): 2400–6. PMC 5630088

. PMID 11099443. doi:10.1093/brain/123.12.2400

. PMID 11099443. doi:10.1093/brain/123.12.2400

- ↑ Belin P, Zatorre RJ (novembro 2003). «Adaptation to speaker's voice in right anterior temporal lobe». NeuroReport. 14 (16): 2105–2109. PMID 14600506. doi:10.1097/00001756-200311140-00019

- ↑ Benson RR, Whalen DH, Richardson M, Swainson B, Clark VP, Lai S, Liberman AM (setembro 2001). «Parametrically dissociating speech and nonspeech perception in the brain using fMRI». Brain and Language. 78 (3): 364–96. PMID 11703063. doi:10.1006/brln.2001.2484

- ↑ Leaver AM, Rauschecker JP (junho–falhou de undefined). «Cortical representation of natural complex sounds: effects of acoustic features and auditory object category». The Journal of Neuroscience. 30 (22): 7604–12. PMC 2930617

. PMID 20519535. doi:10.1523/jneurosci.0296-10.2010 Verifique data em:

. PMID 20519535. doi:10.1523/jneurosci.0296-10.2010 Verifique data em: |data=(ajuda) - ↑ Lewis JW, Phinney RE, Brefczynski-Lewis JA, DeYoe EA (agosto 2006). «Lefties get it "right" when hearing tool sounds». Journal of Cognitive Neuroscience. 18 (8): 1314–30. PMID 16859417. doi:10.1162/jocn.2006.18.8.1314

- ↑ Maeder PP, Meuli RA, Adriani M, Bellmann A, Fornari E, Thiran JP, Pittet A, Clarke S (outubro 2001). «Distinct pathways involved in sound recognition and localization: a human fMRI study» (PDF). NeuroImage. 14 (4): 802–16. PMID 11554799. doi:10.1006/nimg.2001.0888

- ↑ Viceic D, Fornari E, Thiran JP, Maeder PP, Meuli R, Adriani M, Clarke S (novembro 2006). «Human auditory belt areas specialized in sound recognition: a functional magnetic resonance imaging study» (PDF). NeuroReport. 17 (16): 1659–62. PMID 17047449. doi:10.1097/01.wnr.0000239962.75943.dd

- ↑ Shultz S, Vouloumanos A, Pelphrey K (maio 2012). «The superior temporal sulcus differentiates communicative and noncommunicative auditory signals». Journal of Cognitive Neuroscience. 24 (5): 1224–32. PMID 22360624. doi:10.1162/jocn_a_00208

- ↑ DeWitt I, Rauschecker JP (February 2012). «Phoneme and word recognition in the auditory ventral stream». Proceedings of the National Academy of Sciences of the United States of America. 109 (8): E505-14. Bibcode:2012PNAS..109E.505D. PMC 3286918

. PMID 22308358. doi:10.1073/pnas.1113427109

. PMID 22308358. doi:10.1073/pnas.1113427109 Verifique data em:

Verifique data em: |data=(ajuda) - ↑ a b Lachaux JP, Jerbi K, Bertrand O, Minotti L, Hoffmann D, Schoendorff B, Kahane P (outubro 2007). «A blueprint for real-time functional mapping via human intracranial recordings». PLOS ONE. 2 (10): e1094. Bibcode:2007PLoSO...2.1094L. PMC 2040217

. PMID 17971857. doi:10.1371/journal.pone.0001094

. PMID 17971857. doi:10.1371/journal.pone.0001094

- ↑ a b Matsumoto R, Imamura H, Inouchi M, Nakagawa T, Yokoyama Y, Matsuhashi M, Mikuni N, Miyamoto S, Fukuyama H, Takahashi R, Ikeda A (abril 2011). «Left anterior temporal cortex actively engages in speech perception: A direct cortical stimulation study». Neuropsychologia. 49 (5): 1350–1354. PMID 21251921. doi:10.1016/j.neuropsychologia.2011.01.023. hdl:2433/141342

- ↑ a b c Roux FE, Miskin K, Durand JB, Sacko O, Réhault E, Tanova R, Démonet JF (outubro 2015). «Electrostimulation mapping of comprehension of auditory and visual words». Cortex; A Journal Devoted to the Study of the Nervous System and Behavior. 71: 398–408. PMID 26332785. doi:10.1016/j.cortex.2015.07.001

- ↑ Fritz J, Mishkin M, Saunders RC (junho–falhou de undefined). «In search of an auditory engram». Proceedings of the National Academy of Sciences of the United States of America. 102 (26): 9359–64. Bibcode:2005PNAS..102.9359F. PMC 1166637

. PMID 15967995. doi:10.1073/pnas.0503998102

. PMID 15967995. doi:10.1073/pnas.0503998102 Verifique data em:

Verifique data em: |data=(ajuda) - ↑ Stepien LS, Cordeau JP, Rasmussen T (1960). «The effect of temporal lobe and hippocampal lesions on auditory and visual recent memory in monkeys». Brain. 83 (3): 470–489. ISSN 0006-8950. doi:10.1093/brain/83.3.470

- ↑ Strominger NL, Oesterreich RE, Neff WD (junho–falhou de undefined). «Sequential auditory and visual discriminations after temporal lobe ablation in monkeys». Physiology & Behavior. 24 (6): 1149–56. PMID 6774349. doi:10.1016/0031-9384(80)90062-1 Verifique data em:

|data=(ajuda) - ↑ Kaiser J, Ripper B, Birbaumer N, Lutzenberger W (outubro 2003). «Dynamics of gamma-band activity in human magnetoencephalogram during auditory pattern working memory». NeuroImage. 20 (2): 816–27. PMID 14568454. doi:10.1016/S1053-8119(03)00350-1

- ↑ Buchsbaum BR, Olsen RK, Koch P, Berman KF (novembro 2005). «Human dorsal and ventral auditory streams subserve rehearsal-based and echoic processes during verbal working memory». Neuron. 48 (4): 687–97. PMID 16301183. doi:10.1016/j.neuron.2005.09.029

- ↑ Scott BH, Mishkin M, Yin P (julho 2012). «Monkeys have a limited form of short-term memory in audition». Proceedings of the National Academy of Sciences of the United States of America. 109 (30): 12237–41. Bibcode:2012PNAS..10912237S. PMC 3409773

. PMID 22778411. doi:10.1073/pnas.1209685109

. PMID 22778411. doi:10.1073/pnas.1209685109

- ↑ Noppeney U, Patterson K, Tyler LK, Moss H, Stamatakis EA, Bright P, Mummery C, Price CJ (abril 2007). «Temporal lobe lesions and semantic impairment: a comparison of herpes simplex virus encephalitis and semantic dementia». Brain. 130 (Pt 4): 1138–47. PMID 17251241. doi:10.1093/brain/awl344

- ↑ Patterson K, Nestor PJ, Rogers TT (dezembro 2007). «Where do you know what you know? The representation of semantic knowledge in the human brain». Nature Reviews. Neuroscience. 8 (12): 976–87. PMID 18026167. doi:10.1038/nrn2277

- ↑ Schwartz MF, Kimberg DY, Walker GM, Faseyitan O, Brecher A, Dell GS, Coslett HB (dezembro 2009). «Anterior temporal involvement in semantic word retrieval: voxel-based lesion-symptom mapping evidence from aphasia». Brain. 132 (Pt 12): 3411–27. PMC 2792374

. PMID 19942676. doi:10.1093/brain/awp284

. PMID 19942676. doi:10.1093/brain/awp284

- ↑ Hamberger MJ, McClelland S, McKhann GM, Williams AC, Goodman RR (março 2007). «Distribution of auditory and visual naming sites in nonlesional temporal lobe epilepsy patients and patients with space-occupying temporal lobe lesions». Epilepsia. 48 (3): 531–8. PMID 17326797. doi:10.1111/j.1528-1167.2006.00955.x

- ↑ a b c Duffau H (março 2008). «The anatomo-functional connectivity of language revisited. New insights provided by electrostimulation and tractography». Neuropsychologia. 46 (4): 927–34. PMID 18093622. doi:10.1016/j.neuropsychologia.2007.10.025

- ↑ Vigneau M, Beaucousin V, Hervé PY, Duffau H, Crivello F, Houdé O, Mazoyer B, Tzourio-Mazoyer N (maio 2006). «Meta-analyzing left hemisphere language areas: phonology, semantics, and sentence processing». NeuroImage. 30 (4): 1414–32. PMID 16413796. doi:10.1016/j.neuroimage.2005.11.002

- ↑ a b Creutzfeldt O, Ojemann G, Lettich E (outubro 1989). «Neuronal activity in the human lateral temporal lobe. I. Responses to speech». Experimental Brain Research. 77 (3): 451–75. PMID 2806441. doi:10.1007/BF00249600. hdl:11858/00-001M-0000-002C-89EA-3

- ↑ Mazoyer BM, Tzourio N, Frak V, Syrota A, Murayama N, Levrier O, Salamon G, Dehaene S, Cohen L, Mehler J (outubro 1993). «The cortical representation of speech» (PDF). Journal of Cognitive Neuroscience. 5 (4): 467–79. PMID 23964919. doi:10.1162/jocn.1993.5.4.467

- ↑ Humphries C, Love T, Swinney D, Hickok G (outubro 2005). «Response of anterior temporal cortex to syntactic and prosodic manipulations during sentence processing». Human Brain Mapping. 26 (2): 128–38. PMC 6871757

. PMID 15895428. doi:10.1002/hbm.20148

. PMID 15895428. doi:10.1002/hbm.20148

- ↑ Humphries C, Willard K, Buchsbaum B, Hickok G (junho–falhou de undefined). «Role of anterior temporal cortex in auditory sentence comprehension: an fMRI study». NeuroReport. 12 (8): 1749–52. PMID 11409752. doi:10.1097/00001756-200106130-00046 Verifique data em:

|data=(ajuda) - ↑ Vandenberghe R, Nobre AC, Price CJ (maio 2002). «The response of left temporal cortex to sentences». Journal of Cognitive Neuroscience. 14 (4): 550–60. PMID 12126497. doi:10.1162/08989290260045800

- ↑ Friederici AD, Rüschemeyer SA, Hahne A, Fiebach CJ (February 2003). «The role of left inferior frontal and superior temporal cortex in sentence comprehension: localizing syntactic and semantic processes». Cerebral Cortex. 13 (2): 170–7. PMID 12507948. doi:10.1093/cercor/13.2.170

. hdl:11858/00-001M-0000-0010-E3AB-B

. hdl:11858/00-001M-0000-0010-E3AB-B Verifique data em:

Verifique data em: |data=(ajuda) - ↑ Xu J, Kemeny S, Park G, Frattali C, Braun A (2005). «Language in context: emergent features of word, sentence, and narrative comprehension». NeuroImage. 25 (3): 1002–15. PMID 15809000. doi:10.1016/j.neuroimage.2004.12.013

- ↑ Rogalsky C, Hickok G (abril 2009). «Selective attention to semantic and syntactic features modulates sentence processing networks in anterior temporal cortex». Cerebral Cortex. 19 (4): 786–96. PMC 2651476

. PMID 18669589. doi:10.1093/cercor/bhn126

. PMID 18669589. doi:10.1093/cercor/bhn126

- ↑ Pallier C, Devauchelle AD, Dehaene S (February 2011). «Cortical representation of the constituent structure of sentences». Proceedings of the National Academy of Sciences of the United States of America. 108 (6): 2522–7. PMC 3038732

. PMID 21224415. doi:10.1073/pnas.1018711108

. PMID 21224415. doi:10.1073/pnas.1018711108 Verifique data em:

Verifique data em: |data=(ajuda) - ↑ Brennan J, Nir Y, Hasson U, Malach R, Heeger DJ, Pylkkänen L (February 2012). «Syntactic structure building in the anterior temporal lobe during natural story listening». Brain and Language. 120 (2): 163–73. PMC 2947556

. PMID 20472279. doi:10.1016/j.bandl.2010.04.002 Erro no estilo Vancouver: wikilink (ajuda); Verifique data em:

. PMID 20472279. doi:10.1016/j.bandl.2010.04.002 Erro no estilo Vancouver: wikilink (ajuda); Verifique data em: |data=(ajuda) - ↑ Kotz SA, von Cramon DY, Friederici AD (outubro 2003). «Differentiation of syntactic processes in the left and right anterior temporal lobe: Event-related brain potential evidence from lesion patients». Brain and Language. 87 (1): 135–136. doi:10.1016/s0093-934x(03)00236-0

- ↑ Martin RC, Shelton JR, Yaffee LS (February 1994). «Language processing and working memory: Neuropsychological evidence for separate phonological and semantic capacities.». Journal of Memory and Language. 33 (1): 83–111. doi:10.1006/jmla.1994.1005 Verifique data em:

|data=(ajuda) - ↑ Magnusdottir S, Fillmore P, den Ouden DB, Hjaltason H, Rorden C, Kjartansson O, Bonilha L, Fridriksson J (outubro 2013). «Damage to left anterior temporal cortex predicts impairment of complex syntactic processing: a lesion-symptom mapping study». Human Brain Mapping. 34 (10): 2715–23. PMC 6869931

. PMID 22522937. doi:10.1002/hbm.22096

. PMID 22522937. doi:10.1002/hbm.22096

- ↑ Bornkessel-Schlesewsky I, Schlesewsky M, Small SL, Rauschecker JP (março 2015). «Neurobiological roots of language in primate audition: common computational properties». Trends in Cognitive Sciences. 19 (3): 142–50. PMC 4348204

. PMID 25600585. doi:10.1016/j.tics.2014.12.008

. PMID 25600585. doi:10.1016/j.tics.2014.12.008

- ↑ Hickok G, Okada K, Barr W, Pa J, Rogalsky C, Donnelly K, Barde L, Grant A (dezembro 2008). «Bilateral capacity for speech sound processing in auditory comprehension: evidence from Wada procedures». Brain and Language. 107 (3): 179–84. PMC 2644214

. PMID 18976806. doi:10.1016/j.bandl.2008.09.006

. PMID 18976806. doi:10.1016/j.bandl.2008.09.006

- ↑ Zaidel E (setembro 1976). «Auditory Vocabulary of the Right Hemisphere Following Brain Bisection or Hemidecortication». Cortex. 12 (3): 191–211. ISSN 0010-9452. PMID 1000988. doi:10.1016/s0010-9452(76)80001-9

- ↑ Poeppel D (outubro 2001). «Pure word deafness and the bilateral processing of the speech code». Cognitive Science. 25 (5): 679–693. doi:10.1016/s0364-0213(01)00050-7

- ↑ Ulrich G (maio 1978). «Interhemispheric functional relationships in auditory agnosia. An analysis of the preconditions and a conceptual model». Brain and Language. 5 (3): 286–300. PMID 656899. doi:10.1016/0093-934x(78)90027-5

- ↑ Stewart L, Walsh V, Frith U, Rothwell JC (março 2001). «TMS produces two dissociable types of speech disruption» (PDF). NeuroImage. 13 (3): 472–8. PMID 11170812. doi:10.1006/nimg.2000.0701

- ↑ Acheson DJ, Hamidi M, Binder JR, Postle BR (junho–falhou de undefined). «A common neural substrate for language production and verbal working memory». Journal of Cognitive Neuroscience. 23 (6): 1358–67. PMC 3053417

. PMID 20617889. doi:10.1162/jocn.2010.21519 Verifique data em:

. PMID 20617889. doi:10.1162/jocn.2010.21519 Verifique data em: |data=(ajuda) - ↑ Desmurget M, Reilly KT, Richard N, Szathmari A, Mottolese C, Sirigu A (maio 2009). «Movement intention after parietal cortex stimulation in humans». Science. 324 (5928): 811–3. Bibcode:2009Sci...324..811D. PMID 19423830. doi:10.1126/science.1169896

- ↑ Edwards E, Nagarajan SS, Dalal SS, Canolty RT, Kirsch HE, Barbaro NM, Knight RT (março 2010). «Spatiotemporal imaging of cortical activation during verb generation and picture naming». NeuroImage. 50 (1): 291–301. PMC 2957470

. PMID 20026224. doi:10.1016/j.neuroimage.2009.12.035

. PMID 20026224. doi:10.1016/j.neuroimage.2009.12.035

- ↑ Boatman D, Gordon B, Hart J, Selnes O, Miglioretti D, Lenz F (agosto 2000). «Transcortical sensory aphasia: revisited and revised». Brain. 123 (8): 1634–42. PMID 10908193. doi:10.1093/brain/123.8.1634

Erro no estilo Vancouver: wikilink (ajuda)

Erro no estilo Vancouver: wikilink (ajuda)

- ↑ Jiang, Yaya; Gong, Gaolang (23 de janeiro de 2024). «Common and distinct patterns underlying different linguistic tasks: multivariate disconnectome symptom mapping in poststroke patients». Cerebral Cortex (em inglês). 34 (2). ISSN 1047-3211. PMID 38265297. doi:10.1093/cercor/bhae008

- ↑ a b Turkeltaub PE, Coslett HB (julho 2010). «Localization of sublexical speech perception components». Brain and Language. 114 (1): 1–15. PMC 2914564

. PMID 20413149. doi:10.1016/j.bandl.2010.03.008

. PMID 20413149. doi:10.1016/j.bandl.2010.03.008

- ↑ Chang EF, Rieger JW, Johnson K, Berger MS, Barbaro NM, Knight RT (novembro 2010). «Categorical speech representation in human superior temporal gyrus». Nature Neuroscience (em inglês). 13 (11): 1428–32. PMC 2967728

. PMID 20890293. doi:10.1038/nn.2641

. PMID 20890293. doi:10.1038/nn.2641

- ↑ Buchsbaum BR, Hickok G, Humphries C (setembro 2001). «Role of left posterior superior temporal gyrus in phonological processing for speech perception and production». Cognitive Science. 25 (5): 663–678. ISSN 0364-0213. doi:10.1207/s15516709cog2505_2

- ↑ Wise RJ, Scott SK, Blank SC, Mummery CJ, Murphy K, Warburton EA (janeiro 2001). «Separate neural subsystems within 'Wernicke's area'». Brain. 124 (Pt 1): 83–95. PMID 11133789. doi:10.1093/brain/124.1.83

- ↑ Hickok G, Buchsbaum B, Humphries C, Muftuler T (julho 2003). «Auditory-motor interaction revealed by fMRI: speech, music, and working memory in area Spt». Journal of Cognitive Neuroscience. 15 (5): 673–82. PMID 12965041. doi:10.1162/089892903322307393

- ↑ Warren JE, Wise RJ, Warren JD (dezembro 2005). «Sounds do-able: auditory-motor transformations and the posterior temporal plane». Trends in Neurosciences. 28 (12): 636–43. PMID 16216346. doi:10.1016/j.tins.2005.09.010

- ↑ Hickok G, Poeppel D (maio 2007). «The cortical organization of speech processing». Nature Reviews. Neuroscience. 8 (5): 393–402. PMID 17431404. doi:10.1038/nrn2113

- ↑ Karbe H, Herholz K, Weber-Luxenburger G, Ghaemi M, Heiss WD (junho–falhou de undefined). «Cerebral networks and functional brain asymmetry: evidence from regional metabolic changes during word repetition». Brain and Language. 63 (1): 108–21. PMID 9642023. doi:10.1006/brln.1997.1937 Verifique data em:

|data=(ajuda) - ↑ Giraud AL, Price CJ (agosto 2001). «The constraints functional neuroimaging places on classical models of auditory word processing» (PDF). Journal of Cognitive Neuroscience. 13 (6): 754–65. PMID 11564320. doi:10.1162/08989290152541421

- ↑ Graves WW, Grabowski TJ, Mehta S, Gupta P (setembro 2008). «The left posterior superior temporal gyrus participates specifically in accessing lexical phonology». Journal of Cognitive Neuroscience. 20 (9): 1698–710. PMC 2570618

. PMID 18345989. doi:10.1162/jocn.2008.20113

. PMID 18345989. doi:10.1162/jocn.2008.20113

- ↑ a b Towle VL, Yoon HA, Castelle M, Edgar JC, Biassou NM, Frim DM, Spire JP, Kohrman MH (agosto 2008). «ECoG gamma activity during a language task: differentiating expressive and receptive speech areas». Brain. 131 (Pt 8): 2013–27. PMC 2724904

. PMID 18669510. doi:10.1093/brain/awn147

. PMID 18669510. doi:10.1093/brain/awn147

- ↑ Selnes OA, Knopman DS, Niccum N, Rubens AB (junho–falhou de undefined). «The critical role of Wernicke's area in sentence repetition». Annals of Neurology. 17 (6): 549–57. PMID 4026225. doi:10.1002/ana.410170604 Verifique data em:

|data=(ajuda) - ↑ Axer H, von Keyserlingk AG, Berks G, von Keyserlingk DG (março 2001). «Supra- and infrasylvian conduction aphasia». Brain and Language. 76 (3): 317–31. PMID 11247647. doi:10.1006/brln.2000.2425

- ↑ Bartha L, Benke T (abril 2003). «Acute conduction aphasia: an analysis of 20 cases». Brain and Language. 85 (1): 93–108. PMID 12681350. doi:10.1016/s0093-934x(02)00502-3

- ↑ Baldo JV, Katseff S, Dronkers NF (março 2012). «Brain Regions Underlying Repetition and Auditory-Verbal Short-term Memory Deficits in Aphasia: Evidence from Voxel-based Lesion Symptom Mapping». Aphasiology. 26 (3–4): 338–354. PMC 4070523

. PMID 24976669. doi:10.1080/02687038.2011.602391

. PMID 24976669. doi:10.1080/02687038.2011.602391

- ↑ Baldo JV, Klostermann EC, Dronkers NF (maio 2008). «It's either a cook or a baker: patients with conduction aphasia get the gist but lose the trace». Brain and Language. 105 (2): 134–40. PMID 18243294. doi:10.1016/j.bandl.2007.12.007

- ↑ Fridriksson J, Kjartansson O, Morgan PS, Hjaltason H, Magnusdottir S, Bonilha L, Rorden C (agosto 2010). «Impaired speech repetition and left parietal lobe damage». The Journal of Neuroscience. 30 (33): 11057–61. PMC 2936270

. PMID 20720112. doi:10.1523/jneurosci.1120-10.2010

. PMID 20720112. doi:10.1523/jneurosci.1120-10.2010

- ↑ Buchsbaum BR, Baldo J, Okada K, Berman KF, Dronkers N, D'Esposito M, Hickok G (dezembro 2011). «Conduction aphasia, sensory-motor integration, and phonological short-term memory - an aggregate analysis of lesion and fMRI data». Brain and Language. 119 (3): 119–28. PMC 3090694

. PMID 21256582. doi:10.1016/j.bandl.2010.12.001

. PMID 21256582. doi:10.1016/j.bandl.2010.12.001

- ↑ Yamada K, Nagakane Y, Mizuno T, Hosomi A, Nakagawa M, Nishimura T (março 2007). «MR tractography depicting damage to the arcuate fasciculus in a patient with conduction aphasia». Neurology. 68 (10). 789 páginas. PMID 17339591. doi:10.1212/01.wnl.0000256348.65744.b2

- ↑ Breier JI, Hasan KM, Zhang W, Men D, Papanicolaou AC (março 2008). «Language dysfunction after stroke and damage to white matter tracts evaluated using diffusion tensor imaging». AJNR. American Journal of Neuroradiology. 29 (3): 483–7. PMC 3073452

. PMID 18039757. doi:10.3174/ajnr.A0846

. PMID 18039757. doi:10.3174/ajnr.A0846

- ↑ Zhang Y, Wang C, Zhao X, Chen H, Han Z, Wang Y (setembro 2010). «Diffusion tensor imaging depicting damage to the arcuate fasciculus in patients with conduction aphasia: a study of the Wernicke–Geschwind model». Neurological Research. 32 (7): 775–8. PMID 19825277. doi:10.1179/016164109x12478302362653

- ↑ Jones OP, Prejawa S, Hope TM, Oberhuber M, Seghier ML, Leff AP, Green DW, Price CJ (2014). «Sensory-to-motor integration during auditory repetition: a combined fMRI and lesion study». Frontiers in Human Neuroscience. 8. 24 páginas. PMC 3908611

. PMID 24550807. doi:10.3389/fnhum.2014.00024

. PMID 24550807. doi:10.3389/fnhum.2014.00024

- ↑ Quigg M, Fountain NB (março 1999). «Conduction aphasia elicited by stimulation of the left posterior superior temporal gyrus». Journal of Neurology, Neurosurgery, and Psychiatry. 66 (3): 393–6. PMC 1736266

. PMID 10084542. doi:10.1136/jnnp.66.3.393

. PMID 10084542. doi:10.1136/jnnp.66.3.393

- ↑ Quigg M, Geldmacher DS, Elias WJ (maio 2006). «Conduction aphasia as a function of the dominant posterior perisylvian cortex. Report of two cases». Journal of Neurosurgery (em inglês). 104 (5): 845–8. PMID 16703895. doi:10.3171/jns.2006.104.5.845