Limite de Chernoff

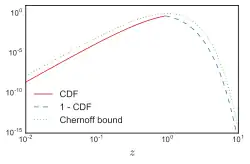

Na teoria das probabilidades, um limite de Chernoff é um limite superior exponencialmente decrescente para a cauda de uma variável aleatória, baseado em sua função geradora de momentos [en]. O mínimo de todos esses limites exponenciais forma o limite de Chernoff-Cramér, que pode decair mais rapidamente que exponencialmente (por exemplo, subgaussiano [en]).[1][2] É particularmente útil para somas de variáveis aleatórias independentes, como somas de variáveis de Bernoulli.[3][4]

O limite é comumente nomeado em homenagem a Herman Chernoff, que descreveu o método em um artigo de 1952,[5] embora Chernoff tenha atribuído o conceito a Herman Rubin.[6] Em 1938, Harald Cramér publicou um conceito quase idêntico, agora conhecido como teorema de Cramér [en].

O limite de Chernoff é mais preciso que os limites de cauda baseados no primeiro ou segundo momento, como a desigualdade de Markov [en] ou a desigualdade de Chebyshev, que fornecem apenas limites de decaimento polinomial. No entanto, quando aplicado a somas, o limite de Chernoff exige que as variáveis aleatórias sejam independentes, uma condição não necessária para as desigualdades de Markov ou Chebyshev.

O limite de Chernoff está relacionado às desigualdades de Bernstein [en]. Também é usado para provar a desigualdade de Hoeffding [en], a desigualdade de Bennett [en] e a desigualdade de McDiarmid [en].

Limites genéricos de Chernoff

O limite genérico de Chernoff para uma variável aleatória é obtido aplicando a desigualdade de Markov a (por isso, às vezes é chamado de "limite de Markov exponencial" ou "limite de momentos exponenciais").

Para , isso fornece um limite para a cauda direita [en] de em termos de sua função geradora de momentos [en] :

Como esse limite é válido para todo , podemos tomar o ínfimo:

Realizando a mesma análise com , obtemos um limite semelhante para a cauda esquerda:

e

A quantidade pode ser expressa como o valor esperado , ou equivalentemente .

Propriedades

A função exponencial é convexa, então, pela desigualdade de Jensen, . Segue-se que o limite para a cauda direita é maior ou igual a um quando , sendo, portanto, trivial; da mesma forma, o limite para a cauda esquerda é trivial para . Assim, podemos combinar os dois ínfimos e definir o limite de Chernoff bilateral:

que fornece um limite superior para a função de distribuição acumulada dobrada de (dobrada na média, não na mediana).

O logaritmo do limite de Chernoff bilateral é conhecido como a função de taxa [en] (ou "transformada de Cramér") . É equivalente à transformada de Legendre–Fenchel [en], ou conjugado convexo, da função geradora de cumulantes , definida como:

A função geradora de momentos é logaritmicamente convexa [en], então, por uma propriedade do conjugado convexo, o limite de Chernoff deve ser logaritmicamente côncavo [en]. O limite de Chernoff atinge seu máximo na média, , e é invariante sob translação: .

O limite de Chernoff é exato se, e somente se, for uma massa concentrada única (distribuição degenerada [en]). O limite é apertado apenas nos extremos ou além de uma variável aleatória limitada, onde os ínfimos são atingidos para infinito. Para variáveis aleatórias ilimitadas, o limite não é apertado em nenhum ponto, embora seja assintoticamente apertado até fatores subexponenciais ("exponencialmente apertado"). Momentos individuais podem fornecer limites mais apertados, ao custo de maior complexidade analítica.[7]

Na prática, o limite exato de Chernoff pode ser difícil de avaliar analiticamente, caso em que um limite superior adequado para a função geradora de momentos (ou cumulantes) pode ser usado (por exemplo, uma CGF subparabólica gerando um limite de Chernoff subgaussiano).

| Distribuição | ||||

|---|---|---|---|---|

| Distribuição normal | ||||

| Distribuição de Bernoulli(detalhada abaixo) | ||||

| Bernoulli padrão

(H é a função de entropia binária [en]) |

||||

| Distribuição de Rademacher [en] | ||||

| Distribuição gama | ||||

| Distribuição qui-quadrada | [8] | |||

| Distribuição de Poisson |

Limites inferiores a partir da FGM

Usando apenas a função geradora de momentos, um limite inferior para as probabilidades de cauda pode ser obtido aplicando a desigualdade de Paley–Zygmund [en] a , resultando em:

(um limite para a cauda esquerda é obtido para ). Diferentemente do limite de Chernoff, esse resultado não é exponencialmente apertado.

Theodosopoulos[9] construiu um limite inferior mais apertado baseado na FGM usando um procedimento de inclinação exponencial [en].

Para distribuições específicas (como a binomial), limites inferiores da mesma ordem exponencial do limite de Chernoff estão frequentemente disponíveis.

Somas de variáveis aleatórias independentes

Quando X é a soma de n variáveis aleatórias independentes X1, ..., Xn, a função geradora de momentos de X é o produto das funções geradoras de momentos individuais, resultando em:

-

(1)

e:

Limites específicos de Chernoff são obtidos calculando a função geradora de momentos para instâncias específicas das variáveis aleatórias .

Quando as variáveis aleatórias também são identicamente distribuídas (iid), o limite de Chernoff para a soma reduz-se a uma simples reescala do limite de Chernoff de uma única variável. Ou seja, o limite de Chernoff para a média de n variáveis iid é equivalente à n-ésima potência do limite de Chernoff de uma única variável (veja teorema de Cramér [en]).

Somas de variáveis aleatórias independentes limitadas

Os limites de Chernoff também podem ser aplicados a somas gerais de variáveis aleatórias independentes e limitadas, independentemente de sua distribuição; isso é conhecido como desigualdade de Hoeffding [en]. A prova segue uma abordagem semelhante aos outros limites de Chernoff, mas aplicando o lema de Hoeffding [en] para limitar as funções geradoras de momentos.

- Suponha que X1, ..., Xn sejam variáveis aleatórias independentes tomando valores em [a,b]. Seja X sua soma e μ = E[X] o valor esperado da soma. Então, para qualquer ,

Somas de variáveis aleatórias de Bernoulli independentes

Os limites nas seções seguintes para variáveis de Bernoulli são derivados usando que, para uma variável de Bernoulli com probabilidade p de ser igual a 1,

Pode-se encontrar várias formas de limites de Chernoff: a forma aditiva original (que fornece um limite para o erro absoluto) ou a forma multiplicativa mais prática (que limita o erro relativo à média).

Forma multiplicativa (erro relativo)

Limite de Chernoff multiplicativo. Suponha que X1, ..., Xn sejam variáveis aleatórias independentes tomando valores em {0, 1}. Seja X sua soma e μ = E[X] o valor esperado da soma. Então, para qualquer δ > 0,

Uma estratégia de prova semelhante pode ser usada para mostrar que, para 0 < δ < 1,

A fórmula acima é frequentemente difícil de usar na prática, então os seguintes limites mais soltos, mas mais convenientes,[10] são frequentemente usados, que seguem da desigualdade da lista de desigualdades logarítmicas:

Note que os limites são triviais para .

Além disso, com base na expansão de Taylor para a função W de Lambert,[11]

Forma aditiva (erro absoluto)

O seguinte teorema é devido a Wassily Hoeffding[12] e, portanto, é chamado de teorema de Chernoff–Hoeffding.

- Teorema de Chernoff–Hoeffding. Suponha que X1, ..., Xn sejam variáveis aleatórias i.i.d. tomando valores em {0, 1}. Seja p = E[X1] e ε > 0.

- onde

- é a divergência de Kullback–Leibler entre variáveis aleatórias de Bernoulli com parâmetros x e y, respectivamente. Se p ≥ 1/2, então , o que implica

Um limite mais simples segue relaxando o teorema usando D(p + ε || p) ≥ 2ε2, que decorre da convexidade de D(p + ε || p) e do fato de que

Esse resultado é um caso especial da desigualdade de Hoeffding. Às vezes, os limites

que são mais fortes para p < 1/8, também são usados.

Aplicações

Os limites de Chernoff têm aplicações úteis em balanceamento de conjuntos [en] e roteamento de pacotes em redes esparsas [en].

O problema de balanceamento de conjuntos surge ao projetar experimentos estatísticos. Tipicamente, ao projetar um experimento estatístico, dadas as características de cada participante, precisamos saber como dividir os participantes em dois grupos disjuntos de modo que cada característica seja aproximadamente equilibrada entre os dois grupos.[13]

Os limites de Chernoff também são usados para obter limites apertados para problemas de roteamento de permutação, que reduzem o congestionamento de rede [en] ao rotear pacotes em redes esparsas.[13]

Os limites de Chernoff são utilizados na teoria do aprendizado computacional para provar que um algoritmo de aprendizado é provavelmente aproximadamente correto [en], ou seja, com alta probabilidade, o algoritmo tem pequeno erro em um conjunto de dados de treinamento suficientemente grande.[14]

Os limites de Chernoff podem ser usados efetivamente para avaliar o "nível de robustez" de uma aplicação/algoritmo ao explorar seu espaço de perturbação com randomização.[15] O uso do limite de Chernoff permite abandonar a forte—e majoritariamente irrealista—hipótese de pequena perturbação (a magnitude da perturbação é pequena). O nível de robustez pode ser usado para validar ou rejeitar uma escolha algorítmica específica, uma implementação de hardware ou a adequação de uma solução cujos parâmetros estruturais são afetados por incertezas.

Um uso simples e comum dos limites de Chernoff é para "reforçar" algoritmos randomizados. Se um algoritmo produz uma estimativa que é a resposta desejada com probabilidade p > 1/2, pode-se obter uma taxa de sucesso maior executando o algoritmo vezes e retornando a estimativa produzida por mais de n/2 execuções do algoritmo. (Não pode haver mais de uma estimativa.) Assumindo que essas execuções do algoritmo são independentes, a probabilidade de que mais de n/2 das estimativas estejam corretas é igual à probabilidade de que a soma de variáveis aleatórias de Bernoulli independentes Xk que são 1 com probabilidade p seja maior que n/2. Isso pode ser mostrado como sendo pelo menos via o limite de Chernoff multiplicativo (Corolário 13.3 nas notas de aula de Sinclair, μ = np).:[16]

Limite de Chernoff para matrizes

Rudolf Ahlswede e Andreas Winter introduziram um limite de Chernoff para variáveis aleatórias com valores matriciais.[17] A seguinte versão da desigualdade pode ser encontrada no trabalho de Tropp.[18]

Seja M1, ..., Mt variáveis aleatórias independentes com valores matriciais tais que e . Denote por a norma de operador da matriz . Se for válido quase certamente para todo , então, para todo ε > 0,

Leonard E. Parker Jr.

Note que, para concluir que o desvio de 0 é limitado por ε com alta probabilidade, precisamos escolher um número de amostras proporcional ao logaritmo de . Em geral, infelizmente, uma dependência em é inevitável: considere, por exemplo, uma matriz de sinal aleatório diagonal de dimensão . A norma de operador da soma de t amostras independentes é precisamente o desvio máximo entre d caminhadas aleatórias independentes de comprimento t. Para alcançar um limite fixo no desvio máximo com probabilidade constante, é fácil ver que t deve crescer logaritmicamente com d neste cenário.[19]

Teorema sem dependência nas dimensões

Seja 0 < ε < 1 e M uma matriz simétrica real aleatória com e quase certamente. Suponha que cada elemento no suporte de M tenha no máximo posto r. Defina

Se for válido quase certamente, então

onde M1, ..., Mt são cópias i.i.d. de M.

Variante de amostragem

A seguinte variante do limite de Chernoff pode ser usada para limitar a probabilidade de que uma maioria em uma população se torne uma minoria em uma amostra, ou vice-versa.[20]

Suponha que haja uma população geral A e uma subpopulação B ⊆ A. Marque o tamanho relativo da subpopulação (|B|/|A|) por r.

Suponha que escolhamos um inteiro k e uma amostra aleatória S ⊂ A de tamanho k. Marque o tamanho relativo da subpopulação na amostra (|B∩S|/|S|) por rS.

Então, para toda fração d ∈ [0,1]:

Em particular, se B for uma maioria em A (ou seja, r > 0.5), podemos limitar a probabilidade de que B permaneça maioria em S (rS > 0.5) tomando: d = 1 − 1/(2r):[21]

Esse limite não é, de forma alguma, apertado. Por exemplo, quando r = 0.5, obtemos um limite trivial Prob > 0.

Provas

Forma multiplicativa

Seguindo as condições do limite de Chernoff multiplicativo, sejam X1, ..., Xn variáveis aleatórias de Bernoulli independentes, cuja soma é X, cada uma com probabilidade pi de ser igual a 1. Para uma variável de Bernoulli:

Assim, usando (1) com para qualquer e onde ,

Se simplesmente definirmos t = log(1 + δ) de modo que t > 0 para δ > 0, podemos substituir e encontrar

Isso prova o resultado desejado.

Teorema de Chernoff–Hoeffding (forma aditiva)

Seja q = p + ε. Tomando a = nq em (1), obtemos:

Agora, sabendo que Pr(Xi = 1) = p, Pr(Xi = 0) = 1 − p, temos

Portanto, podemos calcular facilmente o ínfimo usando cálculo:

Igualando a equação a zero e resolvendo, temos

de modo que

Assim,

Como q = p + ε > p, vemos que t > 0, então nosso limite é satisfeito em t. Tendo resolvido para t, podemos substituir nas equações acima para encontrar que

Agora temos o resultado desejado, que

Para completar a prova para o caso simétrico, simplesmente definimos a variável aleatória Yi = 1 − Xi, aplicamos a mesma prova e a substituímos em nosso limite.

Referências

- ↑ Boucheron, Stéphane (2013). Concentration Inequalities: a Nonasymptotic Theory of Independence. Gábor Lugosi, Pascal Massart. Oxford: Oxford University Press. p. 21. ISBN 978-0-19-953525-5. OCLC 837517674

- ↑ Wainwright, M. (22 de Janeiro de 2015). «Basic tail and concentration bounds» (PDF). Cópia arquivada (PDF) em 8 de Maio de 2016

- ↑ Vershynin, Roman (2018). High-dimensional probability : an introduction with applications in data science. Cambridge, United Kingdom: [s.n.] p. 19. ISBN 978-1-108-41519-4. OCLC 1029247498

- ↑ Tropp, Joel A. (26 de Maio de 2015). «An Introduction to Matrix Concentration Inequalities». Foundations and Trends in Machine Learning (em inglês). 8 (1–2): 60. ISSN 1935-8237. arXiv:1501.01571

. doi:10.1561/2200000048

. doi:10.1561/2200000048

- ↑ Chernoff, Herman (1952). «A Measure of Asymptotic Efficiency for Tests of a Hypothesis Based on the sum of Observations». The Annals of Mathematical Statistics. 23 (4): 493–507. ISSN 0003-4851. JSTOR 2236576. doi:10.1214/aoms/1177729330

- ↑ Chernoff, Herman (2014). «A career in statistics». In: Lin, Xihong; Genest, Christian; Banks, David L.; Molenberghs, Geert; Scott, David W.; Wang, Jane-Ling. Past, Present, and Future of Statistics. [S.l.]: CRC Press. p. 35. ISBN 9781482204964. Cópia arquivada (PDF) em 11 de Fevereiro de 2015

- ↑ Philips, Thomas K.; Nelson, Randolph (1995). «The Moment Bound Is Tighter Than Chernoff's Bound for Positive Tail Probabilities». The American Statistician. 49 (2): 175–178. ISSN 0003-1305. JSTOR 2684633. doi:10.2307/2684633

- ↑ Ghosh, Malay (4 de Março de 2021). «Exponential Tail Bounds for Chisquared Random Variables». Journal of Statistical Theory and Practice (em inglês). 15 (2). 35 páginas. ISSN 1559-8616. doi:10.1007/s42519-020-00156-x

- ↑ Theodosopoulos, Ted (1 de Março de 2007). «A reversion of the Chernoff bound». Statistics & Probability Letters (em inglês). 77 (5): 558–565. ISSN 0167-7152. arXiv:math/0501360

. doi:10.1016/j.spl.2006.09.003

. doi:10.1016/j.spl.2006.09.003

- ↑ Mitzenmacher, Michael; Upfal, Eli (2005). Probability and Computing: Randomized Algorithms and Probabilistic Analysis. [S.l.]: Cambridge University Press. ISBN 978-0-521-83540-4

- ↑ Dillencourt, Michael; Goodrich, Michael; Mitzenmacher, Michael (2024). «Leveraging Parameterized Chernoff Bounds for Simplified Algorithm Analyses». Information Processing Letters. 187 (106516). doi:10.1016/j.ipl.2024.106516

- ↑ Hoeffding, W. (1963). «Probability Inequalities for Sums of Bounded Random Variables» (PDF). Journal of the American Statistical Association. 58 (301): 13–30. JSTOR 2282952. doi:10.2307/2282952

- ↑ a b Consulte esta seção do livro para mais informações sobre o problema.

- ↑ Kearns, M.; Vazirani, U. (1994). An Introduction to Computational Learning Theory. [S.l.]: MIT Press. Capítulo 9 (Apêndice), páginas 190–192. ISBN 0-262-11193-4

- ↑ Alippi, C. (2014). «Randomized Algorithms». Intelligence for Embedded Systems. [S.l.]: Springer. ISBN 978-3-319-05278-6

- ↑ Sinclair, Alistair (Outono de 2011). «Class notes for the course "Randomness and Computation"» (PDF). Consultado em 30 de Outubro de 2014. Cópia arquivada (PDF) em 31 de Outubro de 2014

- ↑ Ahlswede, R.; Winter, A. (2003). «Strong Converse for Identification via Quantum Channels». IEEE Transactions on Information Theory. 48 (3): 569–579. arXiv:quant-ph/0012127

. doi:10.1109/18.985947

. doi:10.1109/18.985947

- ↑ Tropp, J. «User-friendly tail bounds for sums of random matrices». Foundations of Computational Mathematics. 12 (4): 389–434. arXiv:1004.4389

. doi:10.1007/s10208-011-9099-z

. doi:10.1007/s10208-011-9099-z

- ↑ Magen, A.; Zouzias, A. (2011). «Low Rank Matrix-Valued Chernoff Bounds and Approximate Matrix Multiplication». arXiv:1005.2724

[cs.DM]

[cs.DM]

- ↑ Goldberg, A. V.; Hartline, J. D. (2001). «Competitive Auctions for Multiple Digital Goods». Algorithms — ESA 2001. Col: Lecture Notes in Computer Science. 2161. [S.l.: s.n.] 416 páginas. CiteSeerX 10.1.1.8.5115

. ISBN 978-3-540-42493-2. doi:10.1007/3-540-44676-1_35; lemma 6.1

. ISBN 978-3-540-42493-2. doi:10.1007/3-540-44676-1_35; lemma 6.1

- ↑ Veja os gráficos de: o limite como função de r quando k varia e o limite como função de k quando r varia.

Leitura adicional

- Chernoff, H. (1952). «A Measure of Asymptotic Efficiency for Tests of a Hypothesis Based on the sum of Observations». Annals of Mathematical Statistics. 23 (4): 493–507. JSTOR 2236576. MR 57518. Zbl 0048.11804. doi:10.1214/aoms/1177729330

- Chernoff, H. (1981). «A Note on an Inequality Involving the Normal Distribution». Annals of Probability. 9 (3): 533–535. JSTOR 2243541. MR 614640. Zbl 0457.60014. doi:10.1214/aop/1176994428

- Hagerup, T.; Rüb, C. (1990). «A guided tour of Chernoff bounds». Information Processing Letters. 33 (6). 305 páginas. doi:10.1016/0020-0190(90)90214-I

- Nielsen, F. (2011). «An Information-Geometric Characterization of Chernoff Information». IEEE Signal Processing Letters. 20 (3): 269–272. arXiv:1102.2684

. doi:10.1109/LSP.2013.2243726

. doi:10.1109/LSP.2013.2243726